當AI換臉變成犯罪幫兇,她們選擇集體宣戰

這個九宮格中,你能認出哪個是真人,哪個是AI生成的人嗎?

科仔在不知道答案的情況下,真是猶豫了很久,結果還是遺憾地幾乎錯過了所有的正確答案,並且讓科仔和朋友們忍不住「抽水」「這5和6有什麼區別嗎?」。

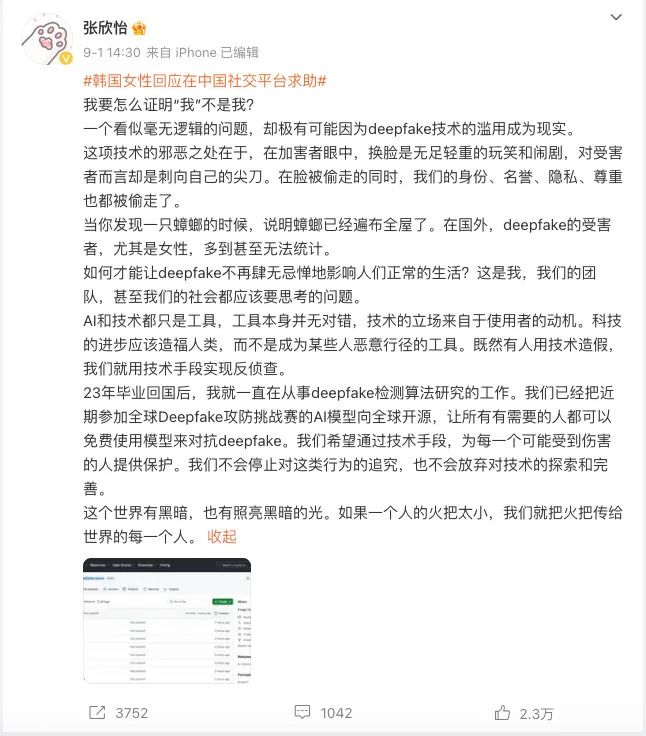

而這個考題並不是什麼惡搞的驗證碼測試,而是中國科學院女性算法工程師張欣怡發在微博上用於警示Deepfake的「高模擬性」的帖子。

前幾日,也就是這位女性算法工程師宣佈要將開源團隊多年的AI大模型成果來對抗Deepfake,消息一經釋出便獲得了大量關注,也是一舉衝上了國內外的熱搜。

這個大模型並不是「小打小鬧」,而是剛在世界級的外灘大會AI攻防挑戰賽中獲得了季軍的產品。在產品簡介中提到,這款大模型可以通過模擬人類的視覺能力,對圖像和影片中的色彩、紋理、光照、陰影等細微特徵進行深度分析,從而精準識別出由Deepfake技術偽造的內容。

Deepfake究竟為什麼成為全球性的「災難」?

最近,關於Deepfake最「熱門」案件就是南韓女性的一次「自救運動」。有多名南韓女性通過微博等中文社交平台發帖求助,希望引起更多人的關注和幫助。

而讓他們自發來到中國社交網站的起因是,在南韓,大量「深度偽造」圖像在Telegram等即時通訊平台上廣泛傳播,而這些圖像就是運用「Deepfake」技術進行換臉後,無關的女性的臉換到「成人」內容影片和圖片上。

這些圖像不僅侵犯了受害者的隱私和名譽,更對她們的心理造成了巨大傷害。

並且在《華爾街日報》的報告中指出,南韓是最容易遭受深度偽造犯罪的國家。報告發現,在兩個月內分析了來自十個深度偽造成人內容網站和影片共享平台上的近 96,000 個影片後,53% 出現在深度偽造成人影片中的形像是南韓歌手和演員。而這個計算被指出還不夠完全,因為沒有計算「普通」南韓女性出現的比例。

更令人擔憂的是,隨著技術的普及和門檻的降低,Deepfake犯罪呈現出低齡化的趨勢。越來越多的青少年成為了受害者或施害者。就比如下面的帖文中提到的,南韓高中的「Deepfake」情況,可見此類技術低齡化對於教育和未來的影響。

這些年紀尚小的高中生或許並不清楚自己的行為已經觸犯了法律,或許只是出於好奇和惡作劇的心態。然而,這種無知的行為卻給社會帶來了巨大的危害。

並且從上面的統計數據中可以發現,除了南韓的「Deepfake」成人內容案件以外,在美國、日本還有咱們國內,都頻繁發生各類利用「Deepfake」進行不法行為的案件。

就比如在下圖中的「年輕版馬斯克」直播,其實也是「Deepfake」幹的好事,他吸引了超8萬的用戶觀看並贈送刷屏禮物,但是鮮有人發現這並不是「真的」馬斯克。

除了國外的事件,「Deepfake」在國內也早就引起過各類風波。

在去年,「平安包頭」就曾公佈的一起案例:郭先生的朋友突然打來微信影片電話,說自己在外地投標,需要430萬的保證金,想借郭先生公司的賬戶走一下帳。

結果,跟他影片的,是用AI換了臉的騙子,佯裝成郭先生的朋友來騙錢。

連年青人都能一不小心就被「Deepfake」詐騙,缺乏辨別信息真偽的能力的老人和小孩怎麼辦呢?

一旦不法分子利用Deepfake技術偽造家人的照片或影片進行詐騙;或者偽造名人的言論對未成年人進行誤導。在侵犯受害者的權益的同時,更可能對他們的心理健康造成長期影響。

在這一起又一起「黑鏡式」驚悚的案例里,人們開始意識到,在Deepfake技術面前,公眾人物和普通老百姓都難以倖免於難。「眼見+耳聽」都已經不一定是事實的情況下,或許真的只有AI才能對抗AI。

張欣怡和中科院團隊的這一次開源行為,無疑是世界範圍內對抗「Deepfake」違法行為的一次集結號,呼籲更多人關注這一犯罪形式的同時也讓更多人關注到了世界其他科研工作者在「反Deepfake」上做出的貢獻。

比如在南韓女性微博求助後的一週,南韓媒體監管機構已經表示,Telegram已經按照其要求刪除了平台上部分「Deepfake」的承成人內容影片內容。並且Telegram還設立了與南韓當局的專門熱線,以便更好應對和解決類似問題。

比如在麻省理工媒體科學雜誌上刊登的一項研究中,研究者們已經建立了一個網站,可以直接上傳照片和影片並且簡易地識別AI生成影片和真實影片的區別。

除了這些例子,還有更多更多各行各業的才俊們也在加入這場世界級的「攻防戰」。

或許就像張欣怡在微博里說的那樣:

「這個世界有黑暗,也有照亮黑暗的光。如果一個人的火把太小,我們就把火把傳給世界的每一個人。」

本文來自微信公眾號「PConline太平洋科技」,作者:吳思奇,編輯:陳林燕、趙甜怡,36氪經授權發佈。