科技六巨頭共話AI之際,我們對智能體也有一些思考

創新的速度比以往任何時候都快,人工智能過去兩年所取得的進展,比前十年加起來還要多。

在西雅圖10月15日的聯想科技創新大會上,罕見地彙聚了當前矽谷芯片三巨頭,包括最近風頭正盛的英偉達CEO黃仁勳、AMD CEO蘇姿豐,以及英特爾CEO帕特·基辛格;另外,Meta CEO馬克·朱克伯格、微軟CEO薩提亞·納迪拉維杜華和高通CEO安蒙也通過遠程連線的方式參與到活動中來。

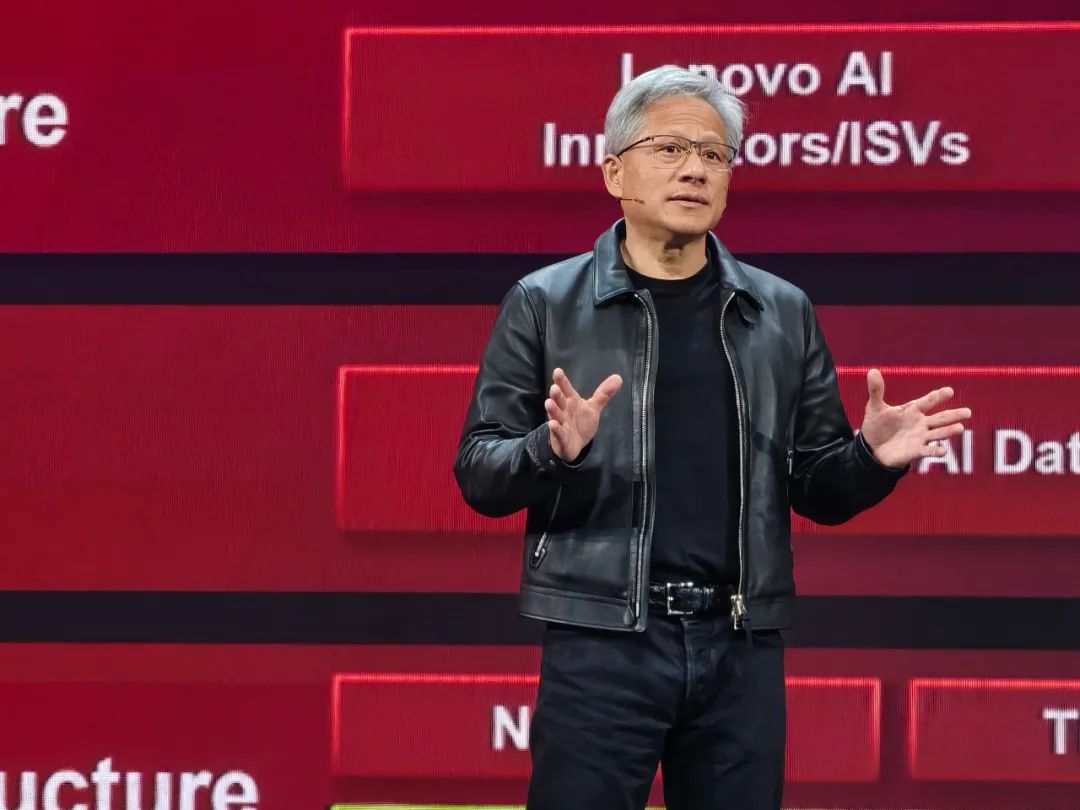

黃仁勳在聯想科技大會,圖源:聯想

黃仁勳在聯想科技大會,圖源:聯想英偉達CEO黃仁勳認為,這輪機器學習創造了最大的工業革命。黃仁勳描述了未來AI的兩大重要方向:智能體AI和實體AI。智能體AI是信息領域的機器人,而實體AI則是物理世界的機器人。他提出了未來會有數以百萬計的「小Jensen玩偶」(Toy Jensens),AI智能體,能夠協助企業和個人完成各類任務。

聯想集團董事長兼CEO楊元慶很早就提出了AI PC戰略,並在聯想筆記本電腦上植入了AI智能體AI Now,根據IDC的數據預測,到明年,AI PC就將佔據市場的一半份額。到2030年,這一比例將達到100%。楊元慶在會後採訪中提到:「AI PC是今天的主導者未必是明天的主導者,更不用說個人智能體變化就更大。可能今天的操作系統就會被顛覆掉,像Windows拿著鼠標在點icon去打開,打小叉叉去關閉,那些東西都已經不符合操作的習慣了。將來的操作系統、模型會整合,會有新的主導者出現。」

聯想集團董事長兼CEO 楊元慶,圖源:聯想

聯想集團董事長兼CEO 楊元慶,圖源:聯想另外,Meta創始人兼CEO馬克·朱克伯格在遠程連線中再次強調了開源打法以及Meta最近發佈的開源多模態模型。他提到聯想搭載在個人PC上的AI智能體AI Now正是基於Meta的模型創建的:「這也是我們開源 Llama 的一個重要原因,像聯想這樣的公司可以對大型語言模型進行微調,優化其在特定使用場景中的表現。」 他也更新了最近Meta的最新進展,比如發佈的開源多模態模型 Llama 3.2,以及發佈的110億和900億參數的模型,以及更小的、專為在設備上運行而優化的10億和30億參數的模型。

大會的另一大看點是英特爾與AMD這兩個糾纏了幾十年的芯片屆的宿敵,史無前例地宣佈合作,組建X86生態系統諮詢小組,確保互操作性和接口一致性,並為開發者提供標準的架構工具與指令集。

基辛格在活動上亮出了他與楊元慶年輕時候的照片,X86架構是英特爾與聯想幾十年合作的基石,並且認為他們面前將迎來X86架構最重要的創新時期之一。基辛格生動地說道:「為此,Lisa(蘇姿豐)和我達成了一致,我們真的認為現在是最佳時機,無論是Lisa還是我,還有什麼比聯想的舞台更適合宣佈這件事呢?」

基辛格展示他和楊元慶年輕時候的照片,圖源:聯想

基辛格展示他和楊元慶年輕時候的照片,圖源:聯想蘇姿豐也提到合作的基礎正是人工智能帶來的時代轉折點:「最令人驚歎的是,我們依然處於非常非常早期的階段,但我們所看到的是創新的速度比以往任何時候都快。坦率地說,我們可能在過去兩年所取得的進展,比前十年加起來還要多。」

蘇姿豐在聯想科技大會,圖源: 聯想

蘇姿豐在聯想科技大會,圖源: 聯想 在這次巨頭雲集的活動上,聯想展示了全面的人工智能解決方案、服務和設備組合,包括:推出面向企業的聯想Hybrid AI Advantage(混合式人工智能優勢集);與英偉達聯合開發的新一代聯想Neptune海神液冷服務器;最新ThinkPad X1 2合1 Aura Edition AI PC、聯想AI Now、聯想Learning Zone(AI學習)軟件平台;以及通過人工智能對社會影響的概念驗證。

聯想科技大會「AI觀察團」,圖源:聯想

聯想科技大會「AI觀察團」,圖源:聯想在這次大會活動前特別設立的直播間里,矽谷101創始人泓君主持了一場與矽星人&品玩的創始人駱軼航以及熱AI Next的主理人陳慶春關於當下人工智能如何落地的討論,一起組成了「AI觀察團」,聊了聊活動上熱議的AI智能體與聯想這次重點強調的無處不在的混合式AI。

以下是部分訪談精選

01 AI落地場景與混合式AI

泓君: 最近矽谷流傳著一個說法,說的是每次OpenAI模型升級,就會有創始人抱怨說,OpenAI把他們價值300萬美元的創業公司給整沒了,然後只給了他們一張價值500美元的OpenAI API接口優惠券。那麼,AI究竟應該如何落地呢?因為AI的繁榮最終依賴於大量的創業公司,它們能夠把AI做成,並且能夠有很好的生長。所以,你們認為AI熱潮是不是一場虛火,大家怎麼看?

駱軼航:這個段子聽上去很慘,但真是這樣嗎?我感覺現在矽谷 AI 創業公司,特別是針對具體場景的應用越來越多了。我見過為診所、寵物診所提供問診的 AI 工具,還有法律和保險類的工具,比如 Harvey 是最大的法律 AI 之一,還有一些編程輔助工具。

如果我們認為這個世界就是由 OpenAI 和其他公司構成的,那 OpenAI 的節奏慢了,但好像虛火就來了。如果我們認為這個 AI 生成的世界實際上是很多樣性的,它就不存在這個問題。

我還注意到一個數據。上週是舊金山 Tech Week,然後有一位Pitchbook的人做了一個分享,他說過去這 5 年,整個美國創業公司的平均估值是被拉低了,但是 2023 、24 年之後有所增長,那怎麼增長?靠AI 。這一波之前,可能是消費類、 Web 3 類的等公司被拉低了,這兩年增長靠的就是 AI 。很多 AI 創業公司,特別是那些專注於 B2B 的公司,早已關注 ARR(年度經常性收入)。我認為不虛的原因是因為大家在追求非常實際的東西。

同樣的,在中國,我也認為情況並不虛。儘管大家覺得有卡住的地方,但是最近一兩個月,AI 應用很能拿到錢了。比如躍然創新,就是將Mini Max音頻大模型集成到了兒童玩具狗中。還有PPT類、公文寫作類的AI產品賣得很好。新華社的新華妙筆一年賣700多塊錢,幾萬基層公務員都在買。這說明AI應用對公司而言是好事,非常有意思。

陳慶春: 我與駱老師的看法一致,不認為AI是虛火。 人們之所以認為AI可能存在泡沫,是因為我們對它的期望過高,總是用未來十年的預期來衡量現在,這是不切實際的。

回顧過去幾年,AI取得了巨大進步,成為推動實體產業發展的重要範式變革。聯想自2017年開始智能化轉型,受益於AI的驅動,供應鏈得到極大提升,在Gartner排名中連續兩年位居亞太第一,這是AI實際應用的例證。此外,國內大模型廠商如Mini Max和智譜AI在B端的應用也非常成功,智譜AI的表現很突出,這些落地案例證明了AI不是虛火。

泓君: 我們在說到混合式AI的時候,大家的定義還不太一樣,要不要先解釋一下什麼是混合式人工智能?

陳慶春: 聯想發現當大模型剛剛落地的時候,因為第一個階段我們就要想這個大模型來了該怎麼去用它。我相信大家去年這個時候可能都在討論的是怎麼去把大模型用好。因為聯想當時是比較有經驗的,所以去年聯想就第一次提出來,其實如果想把這個大模型用起來,就需要混合式人工智能這樣一個做法。

楊元慶介紹混合式AI,圖源:聯想

楊元慶介紹混合式AI,圖源:聯想 泓君: 所以它這個混合指的是什麼?

陳慶春: 混合大模型的概念源於當時OpenAI推出的ChatGPT基礎模型3.5的技術模型。隨著基礎大模型的增多,人們卻不知道怎麼使用它們,尤其是對ToB企業來說,這些模型顯得非常陌生。對於個體用戶,他們可以通過ChatGPT或聊天對話框來體驗和感受大模型。但對於企業來說,如何使用這些模型就成了一個問題。

因此,就需要讓大模型具備垂直行業的專業知識庫,即垂直模型。混合式人工智能就是指基礎大模型和私有大模型的結合。對於企業而言,這意味著需要基於企業所在垂直行業的特定知識庫進行預訓練,以獲得一個更瞭解該行業和企業需求的模型。這個模型可能沒有幾萬億的參數,可能只有幾百億參數,規模較小,但它會更懂這個行業,更明白企業自身的需求。這就是混合式人工智能,即公共大模型和私有大模型的混合使用,以推動混合AI的發展。

駱軼航: 混合人工智能可以從兩個維度來理解。 第一個維度是關於基礎大模型 ,也就是所謂的foundation model。 我們不認為存在完全獨立的小模型,而是認為基礎大模型具備通用性,擁有強大的泛化能力、處理問題的能力、理解能力和推理能力。 這是混合模型的一部分。 在基礎大模型的基礎上,通過後訓練或微調, 可以得到一個專業知識模型。這個模型結合了前者的通用能力和後者的專業知識,可以取得更好的結果 。

第二個維度是將這兩個模型放入一個物理容器中。通常,專業的模型由於數據的隱私性,更垂直、更專業,可能不適合與其他數據結合,且使用的數據量和訓練資源相對較少,因此在很大程度上是一個端模型。這種模型可以放在PC、手機或一體機上,通常在端側運行,不需要從雲端傳輸數據,運行速度更快,即使在沒網的情況下也可以。

所以混合式人工智能其實是一個強大的基礎模型與垂直專業模型的混合,也是一個基於雲端的大模型與在端側發揮更多計算和推理功能的小模型的混合。這兩種混合通過鏡像對應起來,我覺得這是一個非常重要的事情。

華人,尤其是中國人,特別擅長開發端側模型,因為這個領域依賴巧勁,然後中國人又擅長搞硬件。所以我挺樂觀的,都想下場去投類似的早期公司了。

泓君: 總結一下,剛剛我們提到的混合式人工智能其實有兩類,一類是大模型加垂直模型,另一類是端側加雲端的模型。而在垂直模型中,主要有幾種方法:微調、Rag以及對基於開源模型如Llama進行訓練得到的。

還有數據也是一個非常重要的因素。不管採用哪種調優方式,都是基於企業的數據來調整,調出更符合行業規律的模型。所以在談到混合式模型時,能不能給大家舉一個具體的例子,比如聯想是如何通過大模型加垂直模型、雲端加端側的方式,把這些複雜的技術整合到一起,得到一個好的結果的?

陳慶春:聯想的主要核心競爭力在於能夠將這些最前沿的技術非常定製化地提供給每個ToB企業。這並不是說任何人都可以隨意裁剪垂直行業的技術,然後稍作調整就能變成企業使用的大模型。聯想會根據企業所在行業的垂直行業know-how,提供針對性的解決方案。

舉個例子,聯想在製造行業擁有豐富的know-how,特別是在供應鏈管理方面。元慶在去年Tech World上提到,合肥的工廠通過公共大模型進行氣象預測,能提前七天預報暴風雨的到來。這樣的大暴風雨對工廠的生產影響非常大,因為一台PC涉及2,000多個上遊供應商,而聯想沒有龐大的零部件倉庫,一切都依賴智能計算來進行排產。當大模型預測七天后會有暴風雨,聯想的私有大模型就會基於行業知識庫和過往經驗,迅速做出決策。比如,它會通知供應商提前三天交貨,以避開天氣影響。

整個過程非常智能化,不僅能為供應鏈上的廠家配置零部件,還包括場內物流和場外物流的調度。以往需要幾天時間完成的智能排產流程,現在在AI的加持下,可能只需幾十分鐘甚至更短時間。這種速度使整個供應鏈管理和排產系統得以快速高效地完成。這就是公共大模型和企業私有大模型互相配合的完整流程,雖然看起來只需短短幾十分鐘,但背後涉及許多複雜的操作。

泓君: 其實是把供應鏈系統打通了,然後把數據也打通了。

陳慶春: 對,比如說在建立私有大模型時,首先要考慮的是數據,這些數據基於聯想以往所有的排產經驗,這是聯想獨有的。其他企業如A企業、B企業,或者任何一家創業公司,都無法做到這一點,因為它們沒有這種經驗和know-how。

其次,聯想的生產定製化非常強。一台筆記本與另一台筆記本的定製化需求完全不同,生產線上可能同時處理多種型號。因此,當生產一台ThinkPad X1時,它的零部件需求和物流調配與YOGA系列可能完全不同。聯想必須快速知道如何處理這些差異,進行零部件管理和物流調度。這些關鍵知識是其他創業公司無法獲得的。

02 AI智能體三要素:回報率、好用、專業

駱軼航: 我見到的很多場景其實都是混合式的,只要你在做某個項目,基本上都是混合的。 我想延伸一下,剛才講到了自動化決策在物流體系中的應用,像一個agent。 其實,什麼是agent? 有時候大家會把幾個詞混淆。 前兩天我和一個創業者聊天,他從事了4年研究科學家工作,現在出來做AI agent。 我們討論了什麼是AI agent,發現大家的理解各有不同。

但我們總結出一句話:AI agent不是你,但它可以代替你,幫助你自動解決和處理問題。

陳慶春:對,在聯想就叫做你的「個人智能體」,你的個人的雙胞胎。

駱軼航:最近有一個特別有意思的趨勢,矽谷許多原本聲稱解決垂直領域問題的AI公司,現在都在搞AI陪伴。但這種AI陪伴並不是簡單的逗趣聊天或情感互動,而是具有知識和情緒,幫助你處理每個問題。比如,一些公司專注於降低客戶流失率、提升客服體驗,或是針對保險、教育等行業的AI平台,甚至包括會議管理的AI平台,這些應用都開始出現了。

AI智能體和深度場景的結合是一個明顯的趨勢。比如,像友邦這樣的公司,是否會把客戶數據提供給ChatGPT等AI模型?這帶來了很多值得思考的問題。未來,銷售經理可能會管理多台沒有屏幕的一體機,每台設備都有一個智能助理,幫助他處理複雜的銷售管理工作,滿足幾十到上百個客戶的需求,管理情緒等複雜任務。這樣的AI agent實際上是微調過的小模型分身,也就是原生的ToB或未來的ToC AI應用。

原生AI應用這個詞有點像是對軟件的這種說法,而agent就是這種進化邏輯的體現。agent本身是一個混合體,融合了你的個人數據、經驗、偏好等等。

陳慶春:說到agent,我還是要重新回到混合式人工智能的理解上。混合式人工智能最開始是在去年這個時候元慶提出來的,目的是為了讓大家知道怎麼去用這個大模型。

現在我們討論的就是如何用好大模型。經過這一年的發展,我們可以看到AI本身也獲得了很大的進展,這個進展包括預訓練模型的性能提升非常快,比如Llama 3.2以及國內的千問2.5,這些大模型的預訓練能力都有了很大的提升。在之前的半年,我還記得駱老師您主持了一個論壇,大家討論的是我們到底是ToB還是ToC。最終我們發現,現在大家已經達成了共識,都是要用的。那麼為什麼會達成共識呢?因為當時討論的一個點是幻覺太嚴重了,大模型的幻覺問題很突出。但在接下來的這兩三個月中,我們取得了非常大的進展,特別是在推理能力方面有了顯著提升。

泓君:如何用混合式人工智能的方法來避免在精準問題上出現幻覺問題呢?比如說,如果我用一個agent來幫我訂機票和酒店,它不能把我的預訂搞錯。

陳慶春:混合式人工智能現在不僅是公共大模型和私有大模型的混合,未來可能還會是多個agent之間的混合,也就是agent與agent之間的對話。

駱軼航:對,最早的史丹福小鎮項目就是這樣做出來的。Google以及史丹福的團隊,在史丹福小鎮一起合作,愉快地生活在一起。最近,面壁智能也有類似的公司內部項目。他們通過agent之間的協作,這種方式顯然會越來越普及,尤其是在一個組織內部。

陳慶春:現在的混合式人工智能,其實混合能力要更強一些。首先,它涉及公共大模型與私有大模型之間的混合調用。其次,多個agent之間的調用也至關重要。這些agent會為你進行知識分析,最終聯想的這些智能體會嵌入到每個硬件中,形成一體多端的結構。

每個智能體會幫助你進行分析,並需要調用多個大模型和agent。在後台,它們會先召開會議,討論如何滿足需求。比如你提出一個需求,作為聯想的AI Now,後台就開始運作,調動多個agent來共同協作。就像公司開會一樣,老闆提指示,其他人、秘書協調好各方事宜。關鍵是,這個智能秘書就像你的雙胞胎,十分瞭解你,就像看到鏡像中的你一樣。

聯想AI Now個人智能體,圖源: 聯想

聯想AI Now個人智能體,圖源: 聯想 泓君: 你們覺得這個秘書最合適落地在哪些設備上? 例如,這個秘書可以出現在眼鏡、手機,或平板電腦上。 聯想去年提出過一個AIPC戰略,認為PC是AI落地的第一終端。 PC是否真的是AI落地的第一終端?

駱軼航:比如說Ray-Ban Meta眼鏡,我玩得很開心,但我認為它絕對不是第一終端。至少現在不是,五年或十年之後它可能會有變化,但那時的演進形態也可能不同。AR形態可能會進一步演化,所以我覺得這款眼鏡是一個實驗性和過渡性的產品,雖然具備了一些AI功能,但絕對不能算作第一終端。

我認為手機和PC都有可能成為AI第一終端,這取決於使用它的人要做什麼。如果這個人不創造生產力,那麼手機可能是他們的第一終端。因為人們一天到晚離不開手機,刷手機的頻率遠高於刷電腦的頻率。你很少見到家裡60歲的老人刷電腦,除了炒股票。

泓君:但現在大家的很多生產力還是發生在電腦跟手機上,對不對?

駱軼航:是的,我覺得其實手機上幹活是比較少的。如果是閑著沒事、半工作半休息的狀態下用手機幹個活沒問題。我也不是沒有在手機上寫過文章,但要處理比較複雜的事還是不行。所以我認為電腦還是這個事的變革中心。

最近我參加了華源活動,我跟嘉賓的互動環節結束之後,我就把這些資料後貼到一個Google Docs做總結,直接推給一個AI,然後郵件就能發過去,全部AI完成。你能看到鼠標和鍵盤自己在動。這個東西是我覺得它就是一個生產力變革。手機上是不能幹這些事的,而且你還要跨平台整合這個問題,各家的產品都要用,所以我覺得這個是一個特別有意思的事。

陳慶春:現階段AIPC肯定是AI大模型落地的第一終端。無論是從背後的邏輯、算力,還是從本地知識庫需要處理的大量數據來看,你都需要一個存儲設備。因此,僅從這兩點來看,PC是必然的選擇。而如果選擇其他設備,比如剛才你的智能眼鏡,可能就有無法正常工作的情況。

泓君:我們說到AI和PC結合的時候,聯想在這方面做了整合了哪些AI來提升工作效率?

陳慶春:聯想是一個非常開放的生態,在基礎大模型的選擇上非常豐富。國內的一線大模型廠商,比如千問和Kimi,都與聯想有合作;在國外,像Llama這樣的模型也與聯想有深度合作。聯想不會拒絕任何大模型的合作方式,強調的是混合式人工智能,即誰好用、誰對你有幫助,就用誰。現在大模型的特點越來越明顯,比如Kimi擅長處理長文本,MiniMax則擅長語言大模型。

每個大模型的優勢不同,而聯想的優勢在於「誰強誰上」,就像開會時發現誰擅長某方面,就讓他來解決問題。聯想的AI Now會集成所有大模型,並針對每個大模型進行本地化調優,綜合實現AI能力。這也體現在每個AIPC上,都有一個AI Now來調用和優化大模型,為用戶提供更好的服務。

朱克伯格介紹Llama與聯想的合作,圖源: 聯想

朱克伯格介紹Llama與聯想的合作,圖源: 聯想 泓君: AI Now 它是怎麼樣調用這些程序的? 可以在哪些細節上幫助到大家?

陳慶春:這確實非常豐富,具體看你需要什麼功能。比如說你現在需要做一個PPT,可以直接調用AI來幫助你快速生成一整套PPT,這是每個打工人最大的痛點。還有像繪圖,你只要通過對話的方式告訴AI,它就會幫你完成任務,就像和一個機器人對話一樣,這個機器人能幫你解決很多問題。

在辦公方面,因為大部分人在Windows、PC上使用微軟的辦公軟件,如果你可以的話還可以直接調用Copilot,一鍵完成操作,提升辦公生產力。

03 最好的商業模式在B端

泓君: AI怎麼樣去跟跟企業的這個數字化、智能化的這波轉型相結合,大家是怎麼看這個問題的?

陳慶春: 剛才我們聊到的混合式人工智能的關鍵應用點就是企業AI的建立。 因為在企業AI中,你需要構建一些公共大模型,還有企業自身的私有大模型,特別是在端雲網的混合應用上。 比如,聯想具備小樣本學習的能力,它能夠在邊緣端進行學習和推理,不需要推到雲端再做訓練,這樣的能力非常強,也非常及時。 這種能力經常用於智慧交通、智能駕駛等領域,是非常好的例子。

對於企業AI來說,這種混合應用能力是非常重要的。比如什麼時候使用公共大模型,它可以用來做一些研究分析,特別是在高性能計算領域。聯想為吉利打造了一套高性能計算中心,利用公共大模型進行推理和計算,幫助進行車型設計,通過這些能力來確定哪種車型最好。這實際上是一個虛擬數字化的過程,

泓君: 大家可以猜一下,現在在所有AI應用中,最賺錢的美國公司是誰?

其中一個公司就是埃森哲,這是我跟很多在矽谷創業的AI創業者交流時,今年第一季度它的財報收入是6億美元,第二季度達到了9億美元。而且它也是OpenAI最重要的客戶之一。

現在很多B端企業想要轉型,首先就要瞭解這個大模型該怎麼做,如何部署,如何實現Rag,如何適配垂直行業的需求。而埃森哲實際上就是在幫這些大公司,尤其是那些特別有錢的創業公司,去做整個公司的AI化設計。我覺得這是美國一個特有的生態系統。但如果對應到中國,類似的企業就是聯想,甚至字節、阿里這樣的公司,他們也在做類似的事情。

所以從整個應用市場來看,能夠幫助企業把這一整套AI真正落地,並且轉換成生產力工具的方向,正如大家剛才提到的,確實是這一波AI浪潮中非常流行的一個趨勢。

駱軼航: 這裡邊我覺得也有一個很有意思的一個事,就是中美的 AI 焦慮,美國的 AI 焦慮來自於很多過去不是在前沿 AI 領域的大公司擔心掉隊,中小商家是因為要降本增效。甚至有很多做電商做這種傳統 SaaS 的公司都想用AI,這個是美國。中國是全面焦慮。那他們的焦慮其實最直接的轉化成了訂單。

陳慶春: 對,因為他的痛點在於如何快速地使用好這些工具,並且看到投資回報率,所以這是第一個最大的訴求。

第二個訴求是在整個過程中,不能要求我再投入100個工程師去服務、去學習如何使用這些工具。這樣投入就又增加了,所以他希望這些工具是傻瓜式操作,任何人都能打開就用。比如今天我要生產100台PC,只需簡單操作就能排產。

駱軼航: 我覺得聊天語言應該是自然的,作為輸入的方式,但輸出不應該是唯一的。它應該能給出一個決策結果。比如,機器人的模型中,輸入是語言,而輸出則是識別、抓東西、踢球等行為。

陳慶春:所以第二個需求就是要好用,一般的用戶都可以把它用起來。這樣就能省去再投資和僱傭一百個程序員的成本,否則就是不划算了。第三,你就要專業,比如說有些大模型廠商為一些專業企業提供的服務就不夠專業,因為他們根本沒有辦法完成定製化,也沒有相關的知識輸出。從這一點來看,企業使用起來就會很費勁,最後的結果可能會產生很大的偏差,準確率也會很高。因此,這些就是企業需要關注的:要把投資回報率做起來,要好用,還要專業。

04 算力與能耗:AI發展的雙重挑戰

泓君:談到落地,模型的三要素是算力、算法和數據。企業通常是自己擁有數據的。而算法則是訓練模型的部分。我瞭解到聯想在算力方面也有佈局。慶春能否和大家解讀一下聯想在算力方面的佈局?

陳慶春:對,聯想在算力方面的佈局主要體現在其 ISG 基礎設施方案業務集團,這個集團是專門為整體 AI 基礎設施而設立的。算力的佈局實際上是分得非常細的,它並不是簡單地依賴一台服務器或者一個 GPU 來完成整個 AI 的任務。算力需要有服務器、存儲能力,如果沒有存儲能力,就無法進行大數據分析。

其次,數據網絡也是非常重要的,因為一台服務器是無法承擔很多工作的。就像英偉達的黃仁勳前幾天提到的,Meta 用了 19 天建立了 10 萬個 GPU 集群,那麼這些集群之間如何連接,就非常考驗數據網絡的能力。聯想在這方面也有很強的技術能力。

此外,還有虛擬化的能力,比如算力池。還有數據化的能力,以及非常強的可持續發展能力。也就是說,不能消耗過多的電力,過多的消耗會造成浪費。

這個大的算力架構並不僅僅是一個 GPU 的能力,而是一個非常全面的能力。只有當這些全面的能力都建立起來後,才能實現一個非常穩定和可持續發展的算力能力。

泓君:那就是既要算力,還要省電。我記得今年 Sam Altman 一直提到,未來大模型的訓練不僅僅受到算力的限制,更重要的是能源的限制。大家怎麼看?你們認為未來 AI 的訓練和數據中心會面臨能源方面的瓶頸嗎?

駱軼航:長期來看,它確實會的。因此,現在替代性能源的選擇越來越多。我覺得,AI 這一波發生了一個非常有意思的變化,它改變了很多公司的角色。例如,過去我們把芯片製造商稱為代工廠,但現在你會發現一些比較強大的芯片製造商已經不僅僅是代工廠,而是某種意義上變成了基礎設施,變得像雲一樣,地位提升了。

電這一點,過去哪個行業沒用電?湯馬斯·愛迪生發明電已經150多年了,誰都在用電。但是你會發現,電作為一種基礎設施,其基礎性已經達到了這樣的程度。以至於你必須考慮派生和可控核聚變這種投資,其實我覺得接下來可能各地都會去搞。

所以,我認為,AI 這一波作為計算革命、生產力革命的一個範式變化,它直接重組了很多東西,抬升了許多產業鏈中模塊的地位。

泓君:因為我們之前在播客中專門聊過一期關於 AI 能耗的內容,並請教了很多電力學專家。他們有一種觀點認為,過去中國和美國在電力問題上的情況是非常不一樣的。美國的電力一直屬於一種非常穩定且平衡的狀態,穩定的表現是每年大約 0.5% 的增長率,而美國的 GDP 增長並不依賴於電力,而是依賴於服務型行業。

所以,現在美國AI數據中心當前的耗電量其數據能耗相當於一座紐約市。然而,美國的基礎設施大家都知道進展非常緩慢,電力建設無法跟上未來 AI 產生的能耗增長,而且首先要保證居民的用電需求。這個問題在美國非常嚴重,而在中國卻不是一個特別大的問題。因為中國的電力建設,包括基礎設施建設,做得可以說是非常好的。

駱軼航:基礎設施這東西原本不值錢。所以我們那時說互聯網公司就像水電、煤一樣,我們說它估值就上不去了,市值上不去了。但是,作為一種稀缺的基礎設施,它就值錢了。我覺得未來可能會出現這種新的電力和可替代能源的公司,它們直接因為變得稀缺而提升價值。這可能是一個非常大的變化。

泓君:如果能節省一點點能耗,這對所有在 GPU 上進行訓練的公司來說,都是一個巨大的資源節省,同時對社會也是一種巨大的資源節省。我記得剛剛慶春在跟我們分享的時候,提到聯想在降低能耗方面進行了一些嘗試,可以整體展開一下嗎?

陳慶春:剛才兩位老師提到的觀點是,做一些大型集群的算力必然會耗電。過去耗電的原因有兩個:一個是散熱,另一個是電力消耗。

我不知道大家是否去過數據中心,那種服務器特別多的數據中心,第一個特點就是噪音特別大。這個噪音並不是來自於服務器本身,大家可能會記得,第一代電腦的聲音很大,主要是因為散熱風扇的噪音。同樣地,當你看到一個數據中心時,最先看到的不是服務器,而是一群空調外掛機。這麼多空調外掛機是因為大量的服務器和存儲在一起產生的熱量會很高,如果不降溫就可能導致宕機。因此,需要用空調來保持數據中心的平穩運行。

這就使得數據中心具有了這樣一個不好的屬性。 那麼,我們如何在這個不利條件下去改善呢? 聯想因為做服務器已經很多年,所以在十幾年前就發明了海神液冷技術,來幫助服務器降溫和節能。 現在,這項技術已經發展到第六代了。

楊元慶介紹海神液冷技術,圖源: 聯想

楊元慶介紹海神液冷技術,圖源: 聯想 我可以舉個例子,聯想為北京大學建立的高性能計算中心,節省了50%的智能散熱成本,每年算力可以節省60萬度電。

所以無論是高性能計算中心還是GPU計算中心,在散熱和降低能耗方面都有天然的需求。目前,關鍵在於哪個廠家更有能力將這部分費用降低。這可能是一個非常有競爭力的優勢,現在幾乎所有數據中心,無論是國內還是國外,都優先考慮節省成本。他們會關注你能為我節省多少電力成本,畢竟工業用電成本也相對較高。

泓君:今天整體的討論中,我還是想瞭解AI是不是真的創造了一些社會價值,它是如何幫助人的,尤其是如何幫助一些特殊群體。大家有沒有相關的案例想要分享?

陳慶春:舉個例子,聯想非常關心殘障人士的需求,比如聾啞人只會通過手勢溝通,那麼他們對著PC比劃手語時,PC可以識別手勢並進行翻譯,把手語轉換成文字或語言,幫助他人理解。這種技術能夠將社會中的每一個弱勢群體都考慮在內。

泓君:這個案例確實非常好,特別是在矽谷,我對AI在科學領域的應用感觸很深。比如說「AI for Science」這個方向,像今年盧保化學獎的頒布就特別有代表性,一共三位獲獎者,其中兩位獲獎者是來自DeepMind,他們通過AlphaFold在蛋白質結構預測方面取得了重大突破。這類AI的進展不僅推動了基礎科學的突破,同時也為社會帶來了巨大的益處。

陳慶春:聯想之前在公益事業方面也做了很多工作,其中一個例子就是利用AI技術幫助複刻應縣木塔。大家可能知道,應縣木塔是中國非常重要的古建築之一,由於年久失修,現在已經無法讓遊客近距離接觸或登上高層去觀察其細節。為了讓更多人能夠感受到這座古塔的原貌,聯想通過AI技術對木塔進行複原。通過AR和VR的方式,人們可以在電腦上以近距離的視角來觀看和瞭解這座古建築的結構和細節。

本文來自微信公眾號「矽谷101」,作者:矽谷101,36氪經授權發佈。