如何解讀 Yann LeCun推文建議學生不要在大模型方向工作?

作者 | 摘星狐狸

Yann LeCun的建議說得很直白,LLM已經在大廠手裡了,作為一個學生能做的很有限。與其繼續在已有的路徑上卷,不如去探索更多可能性 — 「lift the limitations of LLMs」!但如果要解讀的話,只看字面意思未免淺了些,那就讓我們聊點深入的吧。

LeCun的觀點

LeCun對大語言模型的「「抽水」」由來已久。早在2022年他就指出,語言只承載了所有人類知識的一小部分,而大部分人類知識和所有動物知識都是非語言的,因此大語言模型無法達到人類水平的智能。他對大語言模型的能力始終持懷疑態度,認為它們在理解複雜世界方面存在局限性。

LeCun認為當前的人工智能研究應該放棄生成模型和強化學習方法等主流路線,基於自監督的方法更有希望實現通向通用人工智能(AGI)的突破,未來的人工智能發展方向不應僅僅依賴於大語言模型,而應探索更多元化的技術路徑。這才是他一以貫之的觀點。

而這種觀點的背後,其實是對大模型自身固有限制的擔憂。業界瘋狂助推所謂「力大磚飛」的大模型,部分也是因為底層架構研究進展緩慢,實在等不及了。

當下的LLM有哪些限制?

當下的LLM大都基於Transformer架構,而Transformer架構的核心是自注意力機,它需要計算輸入序列中每個元素對其他所有元素的注意力分數。隨著序列長度的增加,這種計算的複雜度呈平方級增長,導致計算成本急劇上升。而由於自注意力層的內存需求與輸入序列長度成正比,更長的序列也會導致內存消耗顯著增加。這也是為什麼LLM都有上下文長度的限制。

而從模型輸出效果來看,儘管大語言模型能夠生成連貫的文本,但它們可能無法完全理解生成單詞的上下文語境或含義。這意味著它們生成的文本可能缺乏深度或與對話的上下文不完全關聯。比如,大語言模型在其訓練流程中沒有關於事件發生先後順序的概念,因此它們可能無法理解「時間」。而在空間上,大語言模型在處理描述同一事件的多個文本時,可能無法認識到它們之間的關聯,從而無法形成一個一致、完整的世界觀。

由於模型所做的一切就是猜測下一個token,它們不真正「知道自己知道什麼」,這也導致了大語言模型的決策過程往往是黑箱的,缺乏可解釋性,也就難以調試。

為瞭解決上面這些問題,人們在嘗試各種方法。比如為了降低深度學習模型的能耗並保持或提升性能,人們發明了模型剪枝/壓縮/蒸餾、輕量級架構、模型並行與數據並等方法,希望用更小的模型達到同樣出色、甚至更出色的效果。

但在LeCun看來,這些都是在單一路徑下的嘗試,是治標不治本的。而對於計算機專業的學生來說,即便有足夠的算力支持,想要做出突破LLM限制的工作,也不是一件容易的事。

LLM的跨學科應用

相較於想方設法突破大模型的種種限制,一個更有潛力的方向是尋找大模型的跨學科應用。例如由清華大學聶再清教授團隊開發的多模態生物醫藥大模型BioMedGPT,就整合了基因、分子、細胞、蛋白、文獻、專利、知識庫等多源異構數據,有助於在藥物靶點探索、先導化合物設計與優化、蛋白質設計等領域的應用。

對於學生來說,這可能更容易出成果。一方面,跨學科研究可以讓學生更有效地利用現有資源,如專業數據庫、實驗設備和領域專家的知識,不至於為缺乏算力而撓破頭。另一方面,在項目中學習如何將大模型技術應用於特定領域,也有助於掌握將技術轉化為實際應用的能力,對於大多數學生的就業來說更有好處。更重要的是,跨領域的邊緣地帶往往也是創新最密集的地方,在這裏工作能產生巨大的價值。

當然,要想用LLM做出跨學科的應用,工程能力是必須的。

世界模型

如果LLM不是AI的最終方向,那它又會是什麼呢?Yann LeCun給出了他的答案,那就是「世界模型」。

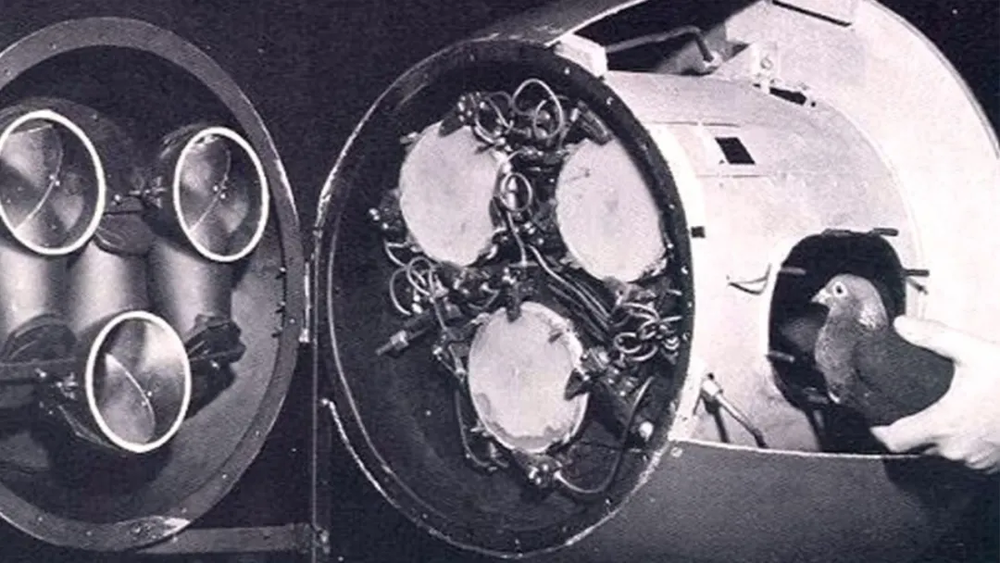

LeCun提出的自主智能的系統架構

LeCun提出的自主智能的系統架構世界模型(world models)是用於描述智能系統如何捕捉和模擬現實世界的概念框,它對於智能體的認知功能、邏輯推理以及決策製定至關重要。具體而言,世界模型涵蓋了對自然界法則、社會結構和人類思維過程的深入洞察,賦予了AI更精準地識別環境狀態、響應外界變化的能力。通過構建精確的世界模型,AI系統可以在其中進行反復試錯,找到現實中的最優決策。Yann LeCun認為,世界模型是通往強人工智能(AGI)的關鍵技術路徑之一。

要理解世界模型,我們可以試著把它和兩類技術進行對比。第一個是多模態大模型,當初Sora誕生時,很多人認為它就是world simulator,然而事實證明,儘管Sora能夠生成影片,但它更多是一個影片工具,並不能很好地進行反事實推理(counterfactual reasoning),即在沒有實際數據支持的情況下,準確回答「what if」類型的問題。Sora並沒有準確地學到物理規律,這表明簡單的數據堆砌可能並不是實現高級智能的正確途徑。而世界模型的最大特點,就是能夠進行反事實推理。

另一個場景是數字孿生。這種技術通常基於數據驅動的方法,創建一個數字副本來代表一個物理實體或過程。通過利用數字化建模技術、實時數據收集、仿真運行以及深入分析,數字孿生能夠與原系統實現同步,並對其進行有效的監測和性能提升。這種方法允許用戶在虛擬環境中模擬、預測和優化物理系統的運行,從而提高效率並降低風險。可是隨著時間的推移,單純的數據驅動的數字孿生已經不能滿足複雜系統的需求了。比如智能建築使用數字孿生來監控和控制建築內的環境條件,如溫度、濕度、能耗等。但是建築物的實際使用情況可能因季節、天氣或居住者的行為而變化,如果模型不能適應這些動態變化,其優化建議就不再適用。而這正好是世界模型的強項,通過讓系統合成和解釋大量的傳感器數據,從而預測潛在的未來場景。

對於一個想要進入AI領域工作的人來說,LLM代表著當下,而世界模型可能是未來。就大模型而言,單純的語言模型可能不如多模態更有潛力,其技術棧尚未收斂,多模態學習和跨模態對齊仍然是技術難點。而一旦在反事實推理方面取得突破,AI的決策能力將大幅提升,就可能帶來真正的AGI。