深度|OpenAI o1 的思維鏈與周鴻禕的慢思考

OpenAI 在 9 月 13 日發佈的 o1-preview 模型後,o1 系列憑藉其強大推理能力和解決問題能力得到大家廣泛關注。

有業內人士表示,o1 開創了「強化學習的 Scaling Laws」,即「Inference Law」,算力收益要比訓練獲得的大得多。

對 Inference 系統 1(快思考)和系統 2(慢思想)的討論一時間成為業內探討的熱點,而該理論正是出自盧保經濟學獎得主 Daniel Kahneman 的著作《思考,快與慢》。

英偉達高級科學家 Jim Fan 在 o1 發佈後第一時間表示,大量計算將被轉移到服務推理而不是訓練前/後,o1 將成為數據飛輪,反過來將進一步優化 GPT 未來版本的推理核心。

周鴻禕對 OpenAI 的賽前分析性解讀

OpenAI o1-preview 在產品中應用 Inference 的背後,正是通過「思維鏈(CoT)」實現的。基於強化學習,o1 將棘手的問題分解為更簡單的步驟,再交給多個子模型來解決,從而提高模型的推理能力。

o1 的思維鏈模式與 360 的「慢思考」不謀而合。周鴻禕早在 7 月底 ISC.AI 2024 大會上就提出了用基於智能體的框架打造慢思考系統,從而增強大模型的慢思考能力。

周鴻禕認為,OpenAI 遵循的正是《思考,快與慢》中的雙系統理論(Dual Process Theory) —— GPT 和 o 系列分別對應系統 1 和 2。

結合雙系統理論,以及 GPT 和 o 系列各自特點,我們能發現:

-

GPT 系列對應系統 1:負責快速、直覺決策,依賴於經驗和情感,多模態,快速語言響應;

-

o1 系列對應系統 2:負責較慢、仔細的思考和推理,依賴邏輯和理性分析,多模態,思維鏈慢速複雜推理;

周鴻禕還表示,雙系統理論的重點/核心在於兩種系統並非獨立而是協同運作,而 OpenAI 內部構建的更加智能的模型或許是 GPT 和 o 系列的融合/系統。

OpenAI 此前在文章中提到,o1 在對推理要求高的領域受歡迎程度遠超 GPT4-o,但是語言為中心的領域卻相反,表明兩者能力所及互補而非衝突。

OpenAI 除了不斷改進 o1 新系列外,還會不斷改進 GPT 系列,由此也可知,o1 並不是GPT 的繼任者,即兩者並非衝突關係,相反大概率是互補關係。

根據周鴻禕的推測,OpenAI 內部可能正在構建雙系統的大模型 —— GPT 以及 o1 兩個系統將協同運作,當 GPT 的快速反應不足以應對複雜情況時,o1 會介入進行更深入的分析。

CoE 架構與 OpenAI 思維鏈不謀而合

OpenAI 在「雙系統」與思維鏈的實踐,與周鴻禕此前在 7 月底 ISC.AI 2024 大會上宣佈的「基於智能體框架打造慢思考系統,從而增強大模型慢思考能力」觀點不謀而合。

周鴻禕也在近期多次強調,通過智能體框架,讓大模型從快思考切換成慢思考,用多個大模型組合協作來解決業務問題。或許這就是通往 AGI 路上,海內外頭部 AI 玩家所給出的答案。

7 月底,360 在正式發佈的 CoE(Collaboration-of-Experts,專家協同)架構中強化了推理的使用。

不同於 MoE(Mixture-of-Experts)架構的稀疏混合專家模型,一次只能調用其中的一個專家模型回答,CoE 架構則能讓多個模型分工協作、並行工作,執行多步推理。

CoE 模型擁有更精細的分工、更好的魯棒性、更高的效率和可解釋性和更強的泛化能力,可以在加快推理速度的同時, 降低 API 和 Token 的使用成本。

CoE 的實際應用,效果超 GPT-4o

目前,CoE 架構在 360 牽頭下,已經接入了國內 16 家國內主流大模型廠商的 54 款大模型產品。

產品方面,360 已經有多款基於 CoE 架構的產品上線,360 AI 搜索和 360 AI 瀏覽器就是基於 CoE 架構的典型應用,涉及多次大模型調用來回覆用戶意圖。

1)CoE 架構實際體驗

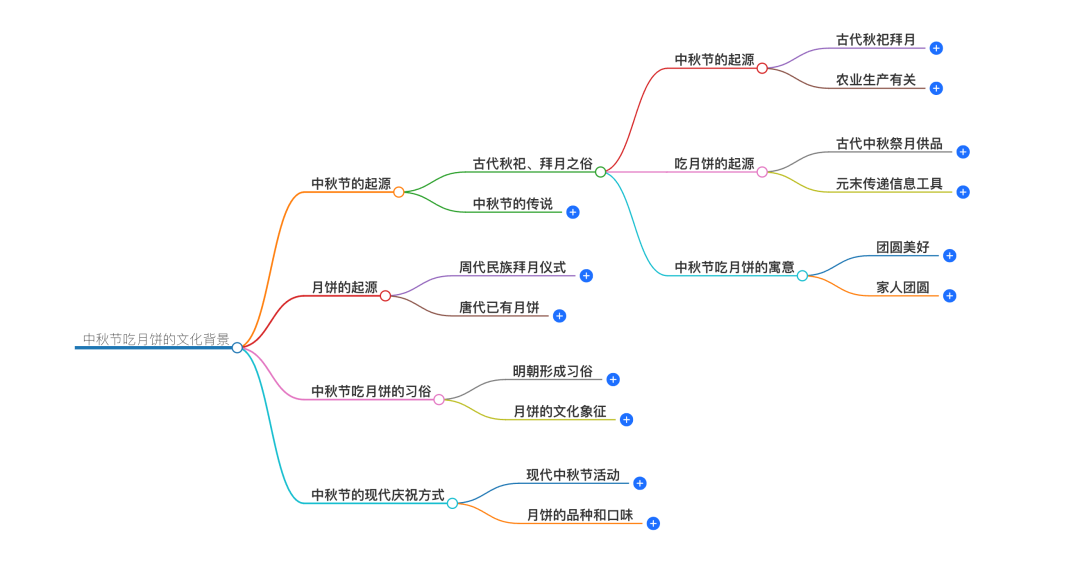

對於實際體驗,用戶可以訪問 https://www.sou.com/ 打開 360 AI 搜索,在「深入回答」模式中輸入「為什麼中秋節要吃月餅」,360 AI 搜索便會啟動 AI 多任務智能體(Agent)來進行用戶搜索意圖識別:

值得一提的是, 360 AI 搜索會通過預設的 AI 模型來蒐集和總結資料,當然用戶也可以在「標準回答」模式中選擇任意第三方 AI 模型進行資料的蒐集與梳理:

在使用中,360 AI 搜索首先會通過意圖分類模型對「為什麼中秋節要吃月餅」進行 1 次意圖識別。

接下來,360 AI 搜索將調用 1 次搜索改寫模型,將用戶意圖改寫成「中秋節吃月餅的起源」、「中秋節吃月餅的文化內涵」以及「不同地區中秋節吃月餅的習俗差異」等 5 個子意圖。

隨後,360 AI 搜索會通過選擇的 AI 大模型對改寫的 5 個子意圖分別進行搜索,並按一定順序羅列出來:

最終,通過 AI 大模型從精選的 29 篇參考資料對分類後的 5 個子意圖進行總結回覆:

360 AI 搜索也支持通過腦圖的形式來幫助用戶快速找到感興趣的內容:

此外,360 AI 搜索也支持構建 AI 工作流,使得多個大模型協同運作。比如,面對一道古詩詞中譯英題目,路由模塊就會調用起翻譯、反思等多個模型,讓這些模型分工配合、共同完成任務:

CoE 架構除了在 360 AI 搜索的應用,還有 360 AI 瀏覽器中的 AI 助手。用戶可以訪問 https://bot.360.com/ 來體驗其最新的多模態協作功能。

點擊左邊欄「多模型協作」,用戶可以從 16 家國內主流大模型廠商的 54 款大模型中任意選擇 3 款大模型進行多模型協作。

在設計思路上,AI 助手設置了「專家」、「反思者」以及「總結者」三個選項,用戶需要在每個選項中確定一個模型:

這樣即使在第一個專家模型在測試中給出了錯誤回答,反思模型與總結模型也能通過協作修正結果。

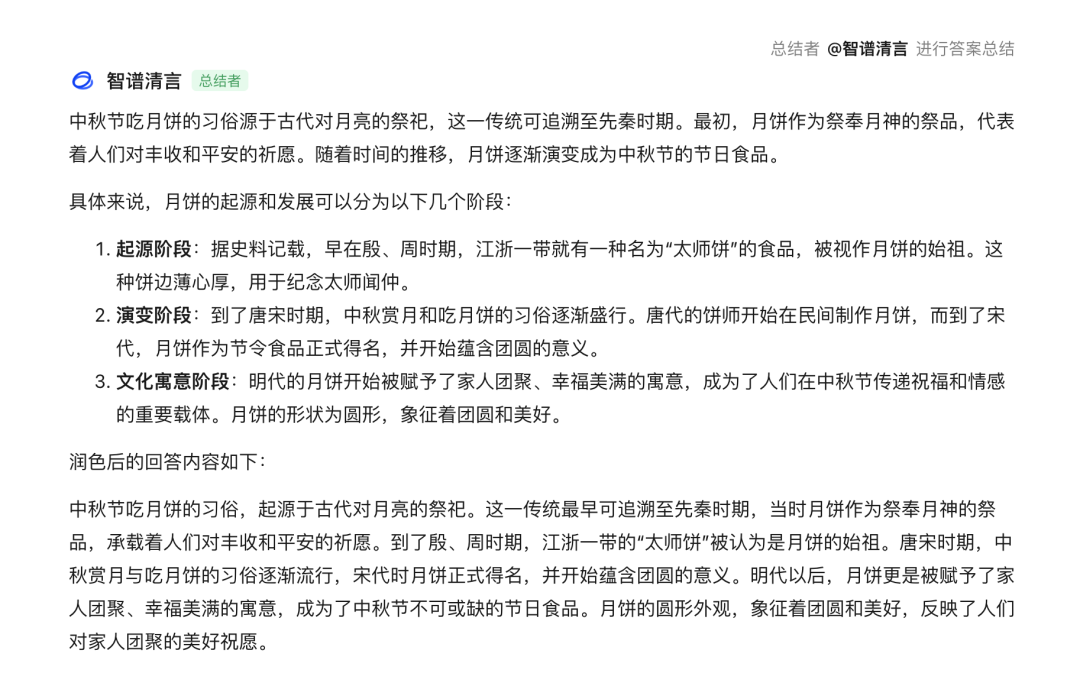

還是以「為什麼中秋節要吃月餅」為例,分別選擇豆包、文心一言以及智譜清言作為測試模型,首先是豆包作為「專家」給出了初步回答:

接下來,文心一言作為「反思者」對豆包回答的內容進行建議與優化:

最後,由智譜清言作為「總結者」對前兩個模型回答進行總結:

目前,AI 助手上線的是三模型協作版本,360 產品團隊還計劃在 9 月底推出五模型或更多模型協作的版本。

2)CoE 架構的開創性

基於 CoE 架構的方案與 OpenAI o1 通過多個子模型實現「慢思考」的理念類似,而主要差異點在於 CoE 架構集合了國內各家大模型能力,OpenAI 則是基於自研的模型。

360 CoE 架構比 OpenAI 更具開創性的點在於 —— CoE 技術架構不僅為 360 AI 搜索以及 360 AI 瀏覽器提供了底層技術,同時與國內多家主流大模型廠商通力協作,為國內大模型創造了更開放和多元的環境,而非像 OpenAI 在美國那樣。

根據行業專家張俊林的觀點,o1-preview 之所以能夠更強,其方法本質上是思維鏈的自動化。

而對於同樣應用思維鏈,且在 7 月底就已推出 CoE 技術架構來講,則是通過「多系統協同」的方式實現「慢思考」和思維鏈自動化的。

並且,就在 o1-preview 上線的同時,360 還推出了基於 CoE 架構AI助手-多模型協作(bot.360.com)。用戶可以在已經接入 CoE 的大模型中,任意調用三個模型協同工作,實際體驗多模型協作中 1+1+1>3 的反思決策效果。

經過 21道複雜邏輯推理題測試結果顯示,其效果在多個維度都超越了 GPT-4o,有時還能超越 o1-preview。