解密盧保物理學獎為什麼頒給AI?Hinton和Ilya 12年前對話,竟引發物理諾獎AI風暴

昨天的盧保物理學獎一公佈,瞬間炸翻了物理圈和AI圈。

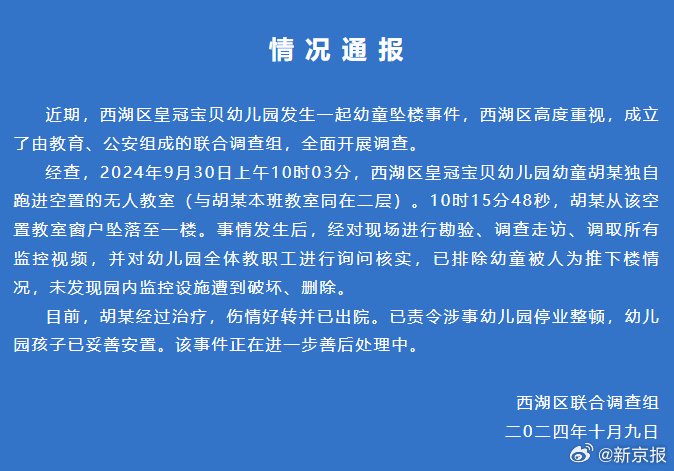

Hinton的第一反應更是有趣:這不會是個詐騙電話吧?

如此出乎意料的結果,讓各路針對諾獎物理學獎的嚴肅預測,都彷彿成了笑話。

而盧保獎的官方帳號,也被網民們給衝爆了。

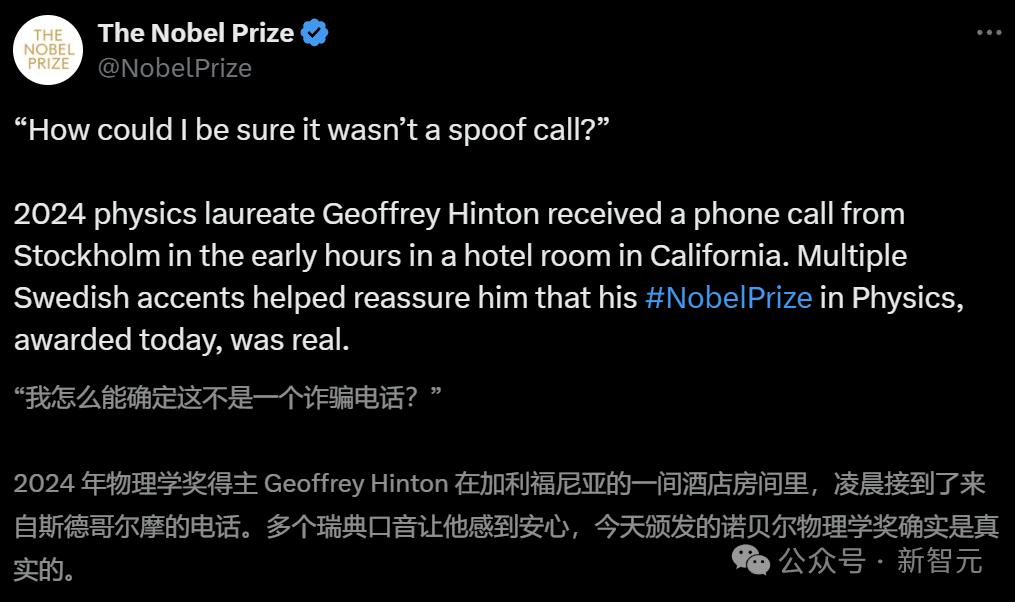

他們紛紛高呼:這不是物理學!

「數據科學或神經網絡是『用於』物理學,但絕對不『是』物理學。」

相比之下,AI圈則是一片其樂融融的景象。大佬們都開心地給Hinton送去了祝福。

AI教母李飛飛:AI的深遠影響,如今才剛剛開始

AI教母李飛飛:AI的深遠影響,如今才剛剛開始MIT博士生Ziming Liu直言:「Physics (Science) for AI」是一個被嚴重低估的領域。規模化可以實現一對多的效果,但唯有科學才能帶來從無到有的突破。

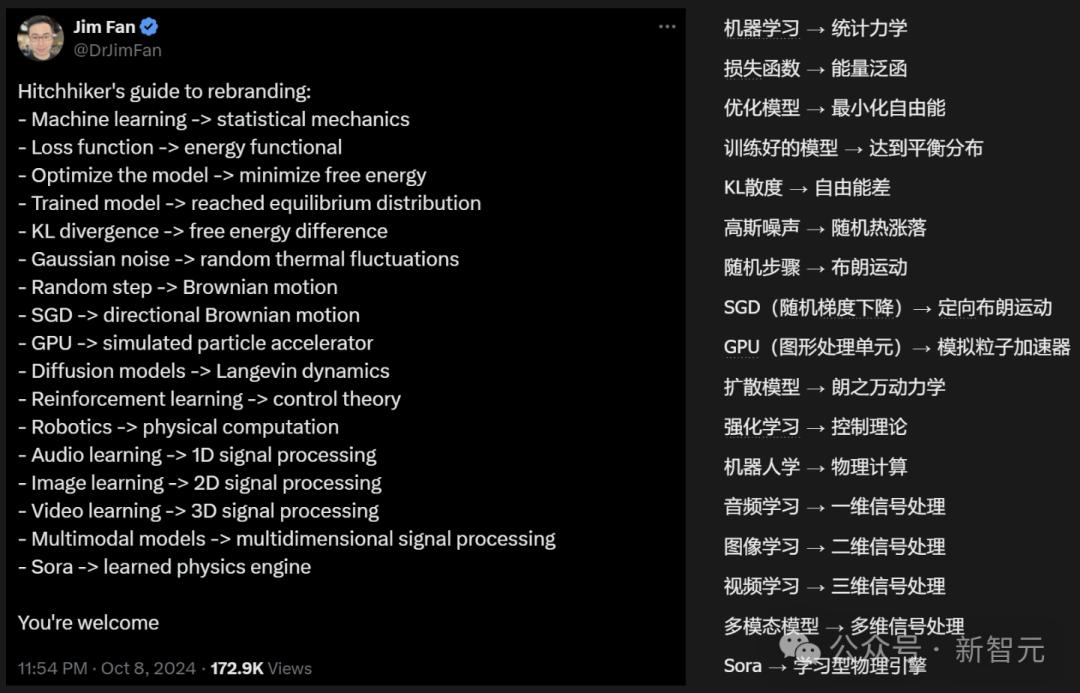

Jim Fan則做了一個非常有趣的「AI-物理學對照表」:

想衝擊諾獎的AI學者們,你們學會了嗎

想衝擊諾獎的AI學者們,你們學會了嗎言歸正傳,盧保物理學獎,為何要頒給AI學者?

這就要從深度學習爆發的那一年講起。

Geoffrey Hinton:2012年,深度學習的驚人革命

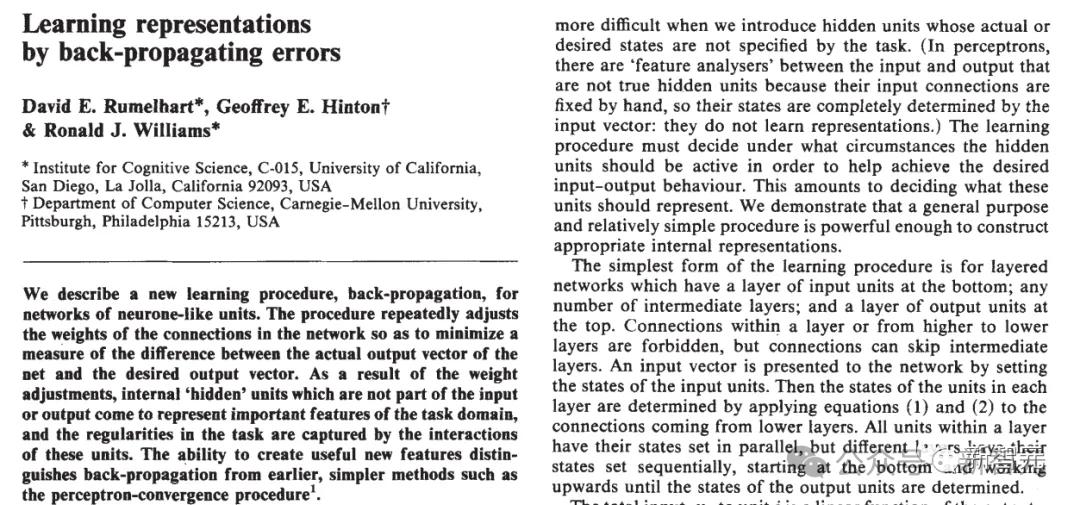

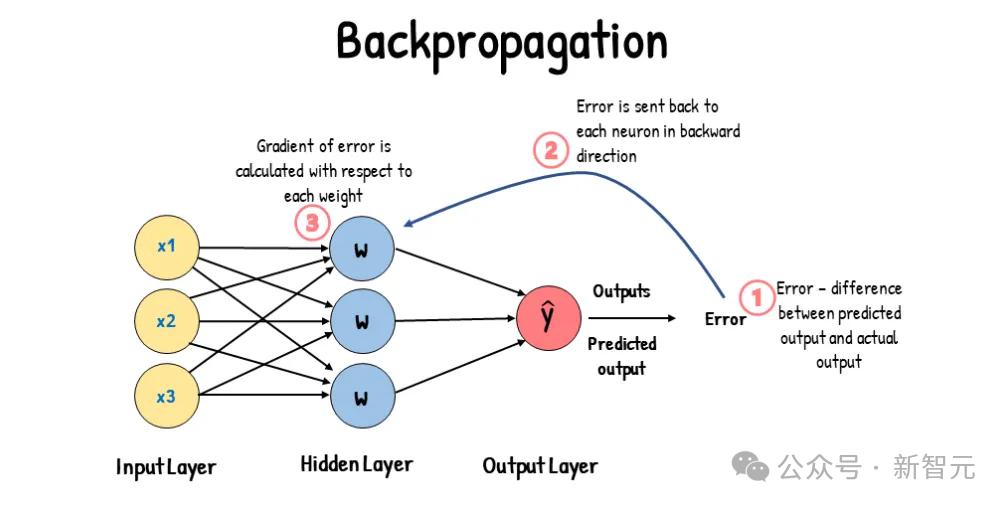

早在1986年,Geoffrey Hinton等人在Nature上發表的論文,就讓訓練多層神經網絡的「反向傳播算法」廣為人知。

當時我們很多人都相信這一定是人工智能的未來。我們成功地證明了我們一直相信的東西是正確的。

可以說,神經網絡在經歷第一波寒冬之後,自此開始重新走向AI舞台。

1989年,LeCun率先使用了反向傳播和卷積神經網絡。他也同意Hinton的看法。

我毫不懷疑,最終我們在上世紀80-90年代開發的技術將被採用。

早期的圖靈三巨頭

早期的圖靈三巨頭不過,反向傳播算法引發的熱潮,隨後又在1995年被統計機器學習蓋過去了。

統計機器學習的風頭興盛了很多年,即使2006年Hinton在Science上首次提出「深度學習」,業內也響應寥寥。

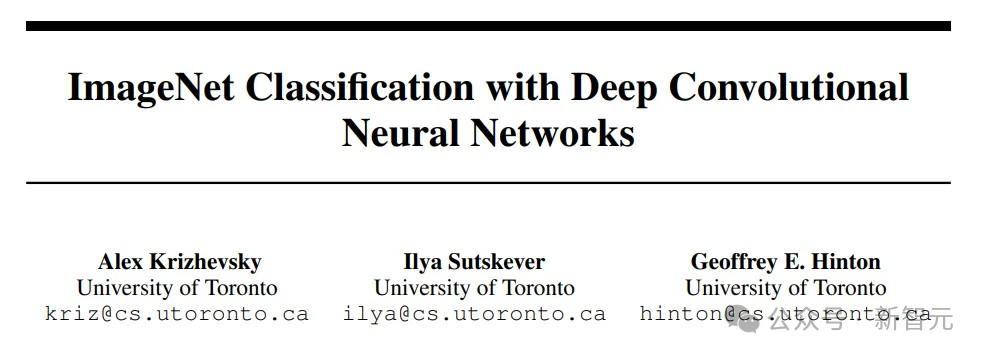

直到2012年9月,一篇題為「用深度卷積神經網絡進行ImageNet圖像分類」的論文,讓此前沉寂多年的AI領域熱度驟起。

文中提出的AlexNet深度卷積神經網絡,在當年的ImageNet比賽上以碾壓之勢奪冠,一舉將top-5錯誤率降低到了15.3%,比身後的第二名(26.2%)足足高出10多個百分點。

ImageNet數據集,正是由史丹福李飛飛團隊在2007年創建。

AlexNet摧枯拉朽般的大勝,讓研究人員驚歎於大型卷積深度神經網絡架構的神奇威力,這篇論文也成為深度學習和人工智能自「AI寒冬」後重新成為熱門領域的重要里程碑。

後來人們所講的「深度學習革命」,也借此文以發端,直到十二年後的今天。

事後李飛飛這樣回顧:自2012年以來,深度學習的發展堪稱「一場驚人的革命,令人做夢都沒想到」。

自此,人們開始相信:大數據、算力、深度模型,是走向通用人工智能的關鍵三要素。

而深度模型也從最早的卷積神經網絡,迭代為遞歸神經網絡、Transformer、擴散模型,直至今天的GPT。

從生理學、哲學到AI:大腦究竟如何思考

在年輕時,為了弄清楚人類的大腦如何工作,Hinton首先來到劍橋學習生理學,而後又轉向哲學,但最終也沒有得到想要的答案。

於是,Hinton去了愛丁堡,開始研究AI,通過模擬事物的運行,來測試理論。

「在我看來,必須有一種大腦學習的方式,顯然不是通過將各種事物編程到大腦中,然後使用邏輯推理。我們必須弄清楚大腦如何學會修改神經網絡中的連接,以便它可以做複雜的事情。」

「我總是受到關於大腦工作原理的啟發:有一堆神經元,它們執行相對簡單的操作,它們是非線性的,它們收集輸入,進行加權,然後根據加權輸入給出輸出。問題是,如何改變這些權重以使整個事情做得很好?」

某個週日,Hinton坐在辦公室,突然有人敲門。AI命運的齒輪從此轉動。

敲門的正是Ilya。

當年青澀的Ilya

當年青澀的IlyaHinton給了Ilya一篇關於反向傳播的論文,約定兩人一週後討論。

Ilya:I didn’t understand it.

Hinton:這不就是鏈式法則嗎?

Ilya:不是,我不明白你為什麼不用個更好的優化器來處理梯度?

——Hinton的眼睛亮了一下,這是他們花了好幾年時間在思考的問題。

Ilya很早就有一種直覺:只要把神經網絡模型做大一點,就會得到更好的效果。Hinton認為這是一種逃避,必須有新的想法或者算法才行。

但事實證明,Ilya是對的。

新的想法確實重要,比如像Transformer這樣的新架構。但實際上,當今AI的發展主要源於數據的規模和計算的規模。

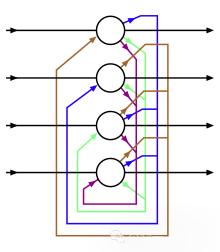

2011年,Hinton帶領Ilya和另一名研究生James Martins,發表了一篇字符級預測的論文。他們使用域奇百科訓練模型,嘗試預測下一個HTML字符。

模型首次採用了嵌入(embedding)和反向傳播,將每個符號轉換為嵌入,然後讓嵌入相互作用以預測下一個符號的嵌入,並通過反向傳播來學習數據的三元組。

當時的人們不相信模型能夠理解任何東西,但實驗結果令人震驚,模型彷彿已經學會了思考——所有信息都被壓縮到了模型權重中。

AI如何「蹭」上物理學

講到這裏,你可能有一個疑問:這些跟物理學有什麼關係呢?

諾獎委員會的解釋是,人工神經網絡是用物理學工具訓練的。

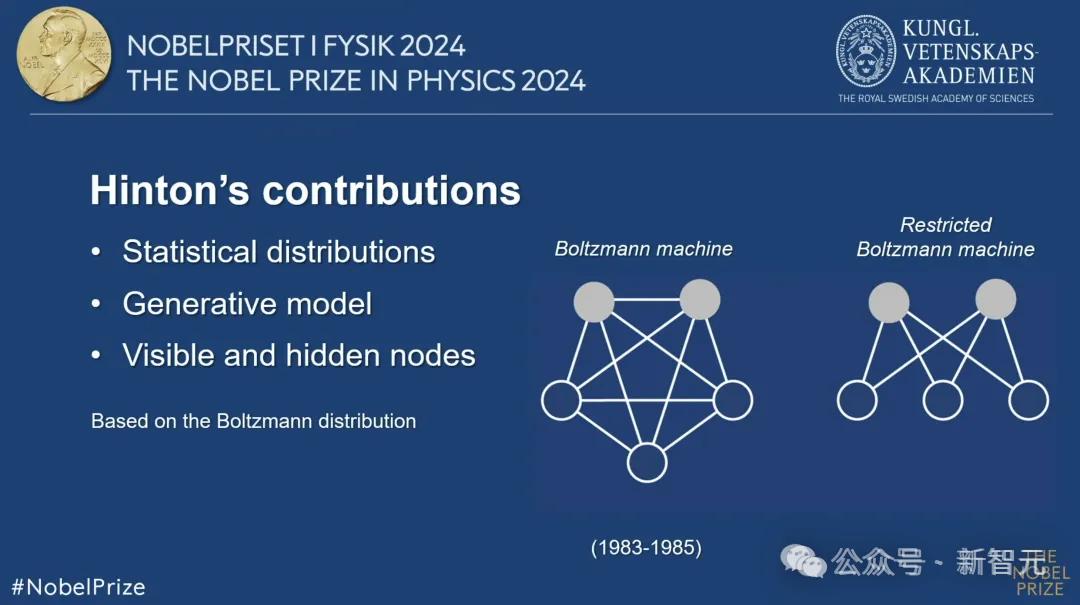

Geoffrey Hinton曾以Hopfield網絡為基礎,創建了一個使用不同方法的新網絡:玻爾茲曼機。在這個過程中,Hinton使用的是統計物理學的工具,來學習和識別數據中的模式。

就這樣,AI跟物理學聯繫上了。

如果講到此次另一位獲獎者John Hopfield,倒是和物理學的關係更緊密一些。

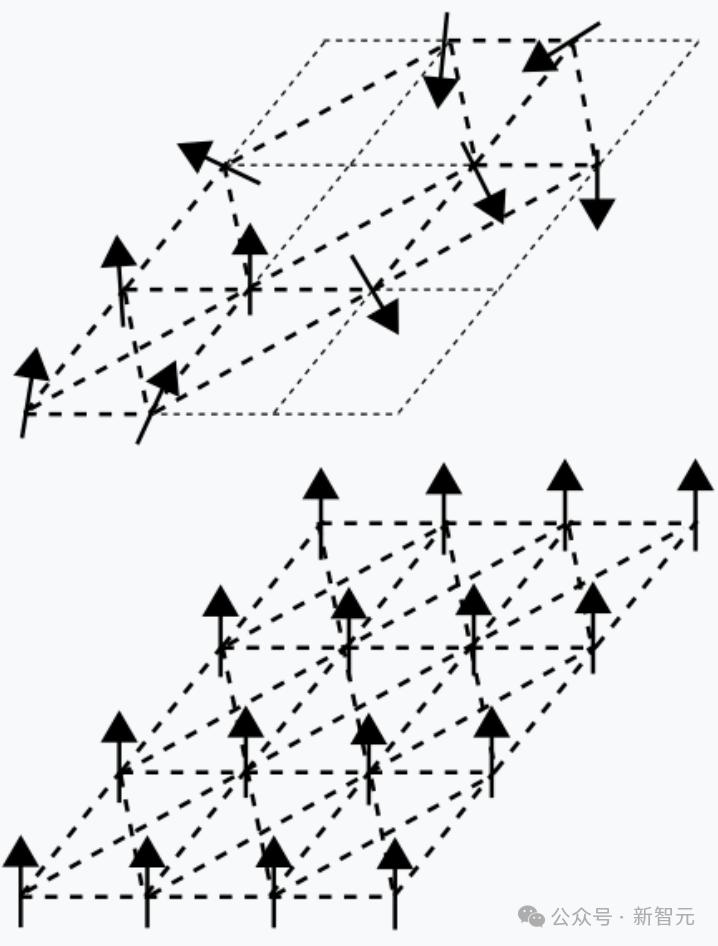

一言以蔽之,Hopfield網絡是按物理學上能量函數最小化來構建的,可以看作是物理學中「自旋玻璃模型」的擴展。

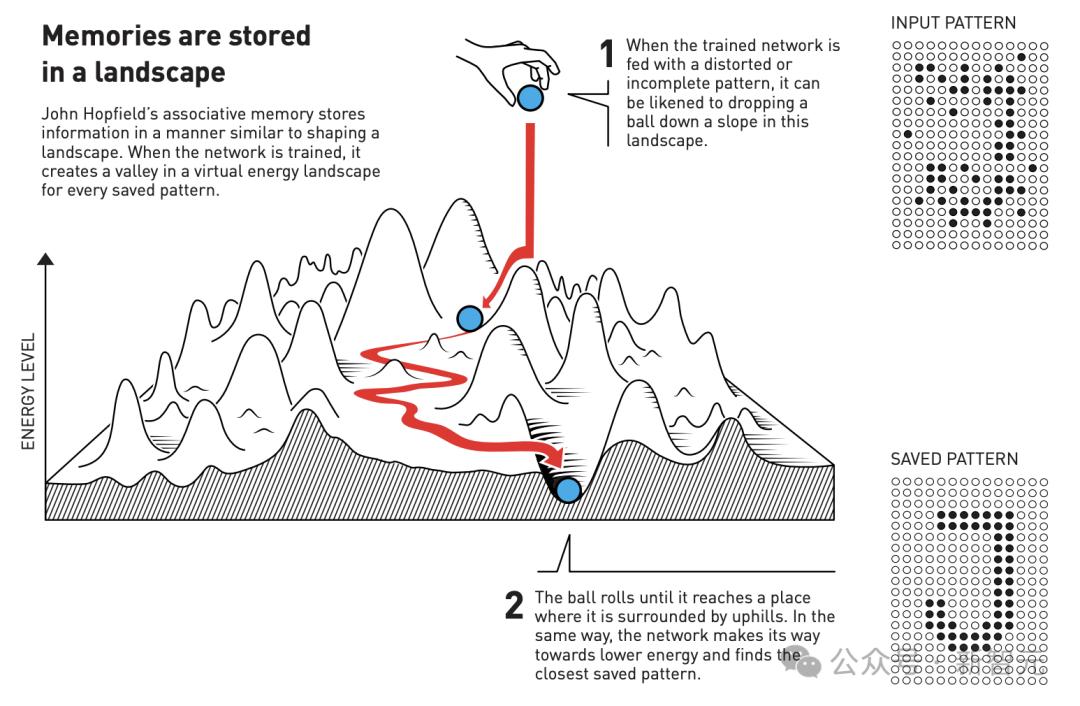

Hopfield網絡利用了材料由於其原子自旋而具有特性的物理學——這種特性使每個原子成為一個微小的磁鐵。整個網絡的描述方式等同於物理學中發現的自旋系統中的能量,並通過找到節點之間連接的值來訓練,使保存的圖像具有低能量。

另外,Hopfield Network和玻爾茲曼機都是基於能量的模型。

統計力學原理,便是這兩者的核心。它們都使用來自統計力學的能量函數,來建模和解決與模式識別和數據分類相關的問題。

在前者當中,能量函數被用來尋找與所存儲的模式相對應的最穩定狀態。後者中,能量函數通過調整節點之間連接的權重來幫助學習數據的分佈。

至此,諾獎委員會就自圓其說了。

John Hopfield:一個想法,波及三大學科

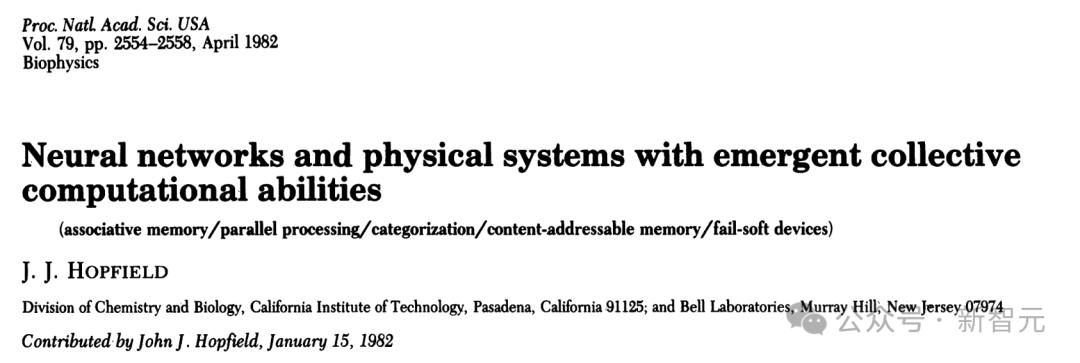

20世紀80年代初,John Hopfield在加州理工學院創建了一個簡單的計算機模型——Hopfield Network。

其行為方式不太像當時的計算機,而更像人腦。

這是因為,Hopfield Network模仿了人腦儲存信息的結構。它由相互連接的節點組成,正如人腦中的神經元一樣。

節點中的連接強度具有可塑性,可強可弱,而強連接進而形成了我們所說的「記憶」。

Hopfield學生,現Caltech計算機科學、計算與神經系統以及生物工程教授Erik Winfree解釋道:

Hopfield Network是物理學中「自旋玻璃模型」(the spin glass model)的擴展。自旋玻璃有兩種磁化狀態,可以稱之為它的「記憶」。

Hopfield擴展了這一模型,讓其有了更複雜的連接模式。

簡言之,他使用一個簡單的規則,讓每對單元(每個節點)之間有不同的連接強度,而不再局限於兩種狀態。

他的工作證明了,這種網絡可以儲存多種複雜的模式(記憶),而且比之前的方法更接近大腦運作方式。

Hopfield以一種跨學科的視角闡述這個模型,解釋了人工神經網絡與物理學之間的聯繫。

複旦大學計算機科學教授張軍平認為,Hopfield Network與物理學領域的關聯是,它的設計思路模擬了電路結構。

「假設網絡每個單元均由運算放大器和電容電阻組成,而每個單元就代表著一個神經元」。

在普林斯頓大學新聞發佈會上,Hopfield表達了同樣的觀點。他認為,長遠來看,新科學領域通常產生於,大量科學知識的交叉點上。

你必須願意在這些「縫隙」中工作,找出你的知識局限性,以及讓這些學科更豐富、更深入、更好被理解而採取的行動。

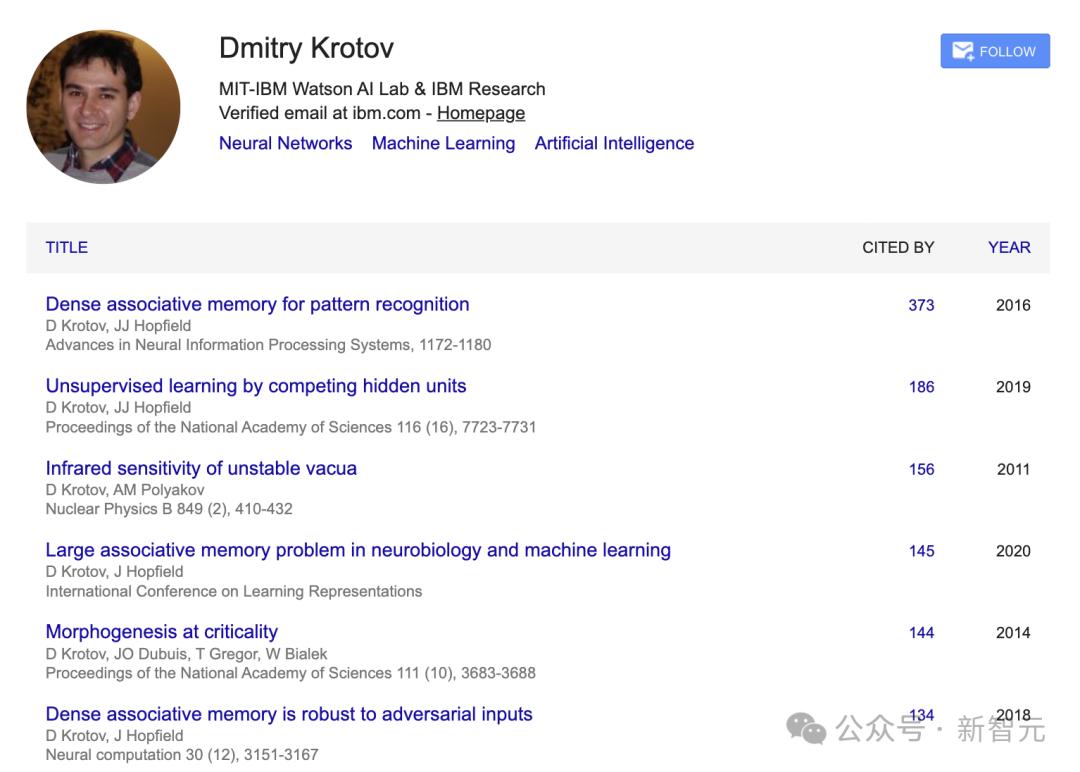

來自MIT-IBM實驗室物理學家Dmitry Krotov分享了,Hopfield Network一個想法至少對三大學科產生了巨大的影響。

它們分別是,統計物理學、計算機科學和人工智能、神經科學。

2023年,他曾發表了一篇Nature論文,對Hopfield Network在統計物理、神經科學和機器學習等多個學科中,進行了分析。

論文地址:https://www.nature.com/articles/s42254-023-00595-y

論文地址:https://www.nature.com/articles/s42254-023-00595-yKrotov本人也與Hopfield合作過多篇研究,因此他對Hopfield Network工作的瞭解再熟悉不過了。

統計物理學

在統計物理學中,Hopfield Model成為最常被研究的哈密頓量(Hamiltonian)之一。哈密頓量在物理學中,描述了系統的總能量,是理解系統行為的關鍵。

這一模型已經催生了數以萬計的論文、幾本書籍。它為數百名物理學家進入神經科學和人工智能,提供了切入點。

就連盧保獎官方給出瞭解釋,機器學習模型,是基於物理方程式。

計算機科學和AI

在計算機科學中,Hopfield Network終結了AI寒冬(1974-1981),並開啟了人工神經網絡的複興。

Hopfield在1982年發表的論文,標誌著現代神經網絡的開始。

論文地址:https://www.pnas.org/doi/10.1073/pnas.79.8.2554

論文地址:https://www.pnas.org/doi/10.1073/pnas.79.8.2554就連如今的頂會NeurIPS,起源可以追溯到1984-1986年在加州理工學院舉行的被稱為「Hopfests」的會議。

這個名字直接致敬了Hopfield,彰顯了他的早期工作在神經網絡研究中的核心地位。

John Moody在1991年的NeurIPS論文集中記錄了這段歷史。

另外,Hopfield Network成為限制玻爾茲曼機(Restricted Boltzmann Machine)發展的主要靈感來源。RBM在早期深度學習中,發揮著重要的作用。

還有基於能量的模型(Energy Based Model),代表著人工智能領域中一個重要的範式。

它也是從Hopfield基於能量和記憶的模型發展而來。

神經科學

在神經科學領域,Hopfield Network成為後來許多計算記憶模型的基礎。

它將記憶回憶概念化,即能量景觀中滾下山坡的想法,已成為神經科學中的經典隱喻。

這次「諾獎風波」後,許多人也對如今的學科分類有了全新的思考。

不可否認的是,AI已經融入了全學科、全領域。

而這次盧保物理學獎頒給AI,也是AI大爆發對於人類社會顛覆影響的一個真實寫照。

參考資料:

https://x.com/Caltech/status/1843764971022495942

https://x.com/DimaKrotov/status/1843682498825564463

https://cacm.acm.org/opinion/between-the-booms-ai-in-winter/

https://x.com/DrJimFan/status/1843681423443800315

本文來自微信公眾號「新智元」,作者:新智元,編輯:編輯部 HYZ,36氪經授權發佈。