無需參數訪問!CMU用大模型自動優化視覺語言提示詞 | CVPR’24

林之秋 投稿

量子位 | 公眾號 QbitAI

視覺語言模型(如 GPT-4o、DALL-E 3)通常擁有數十億參數,且模型權重不公開,使得傳統的白盒優化方法(如反向傳播)難以實施。

那麼,有沒有更輕鬆的優化方法呢?

就在最近,卡內基梅隆大學(CMU)的研究團隊對於這個問題提出了一種創新的「黑盒優化」策略——

通過大語言模型自動調整自然語言提示詞,使視覺語言模型在文生圖、視覺識別等多個下遊任務中獲得更好的表現。

這一方法不僅無需觸及模型內部參數,還大幅提升了優化的靈活性與速度,讓用戶即使沒有技術背景也能輕鬆提升模型性能。

該研究已被 CVPR 2024 接收。

如何做到的?

大多數視覺語言模型(如 DALL-E 3、GPT-4o 等)並未公開模型權重或特徵嵌入,導致傳統依賴反向傳播的優化方式不再適用。

不過,這些模型通常向用戶開放了自然語言接口,使得通過優化提示詞來提升模型表現成為可能。

然而,傳統的提示詞工程嚴重依賴工程師的經驗和先驗知識。

例如,為提升 CLIP 模型的視覺識別效果,OpenAI 花費了一年時間收集了幾十種有效的提示詞模板(如 「A good photo of a [class]」)。

同樣,在使用DALL-E 3和Stable Diffusion等文生圖模型時,用戶往往也需掌握大量提示詞技巧才能生成滿意的結果。

那麼,有沒有替代人類提示詞工程師的方法?

有的 CMU 團隊提出了一種新策略:用 ChatGPT 等大語言模型自動優化提示詞。

像提示詞工程師利用反饋改進提示詞一樣,CMU 的方法將正負反饋交給 ChatGPT,以更高效地調整提示詞,具體過程如圖所示:

這種優化過程類似於機器學習中的「爬山法」(hill-climbing)策略,不同之處在於大語言模型可以自動分析提示詞表現,從正負反饋中找到最優改進方向。

研究團隊利用這一特性來更高效地優化提示詞。這個過程可以用以下步驟概括:

提示詞初始化:收集一批未經優化的初始提示詞。

提示詞排序:對當前提示詞進行表現評分,保留高分提示詞,替換低分提示詞。

生成新提示詞:通過大語言模型,根據提示詞的表現生成新的候選提示詞。

經過多輪迭代,最終返回得分最高的提示詞作為優化結果。

實驗結果

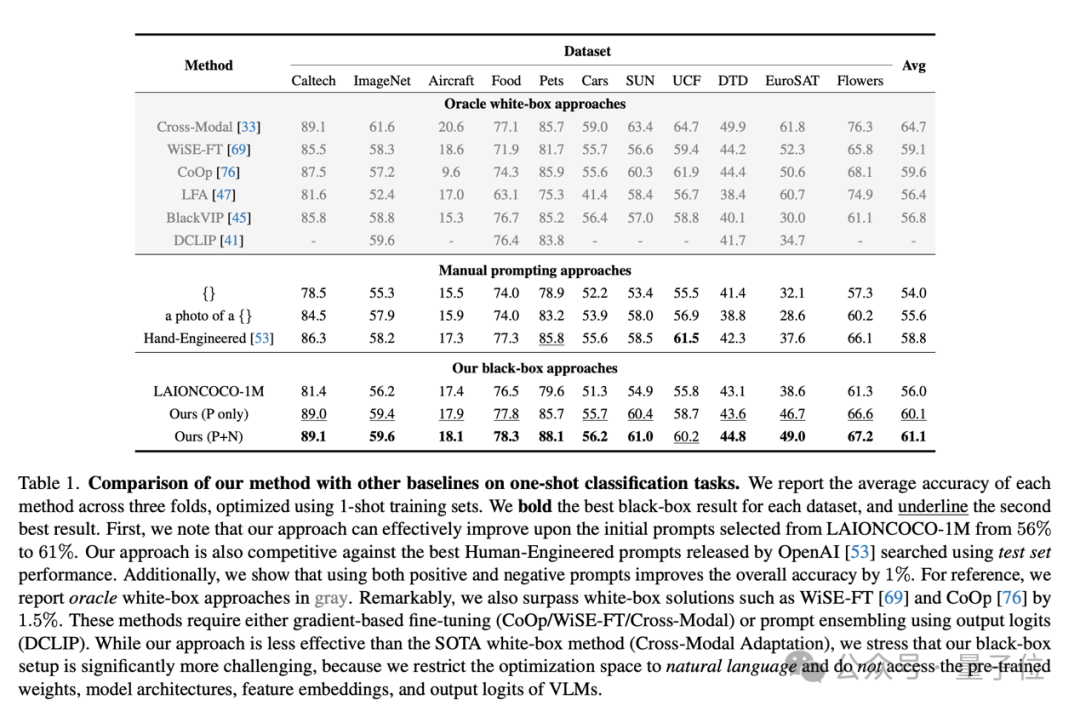

通過這一方法,CMU 團隊在無需人類提示工程師參與的情況下,在多個小樣本視覺識別數據集上取得了最佳準確性,甚至超越了傳統的白盒提示詞優化方法(如 CoOp)。

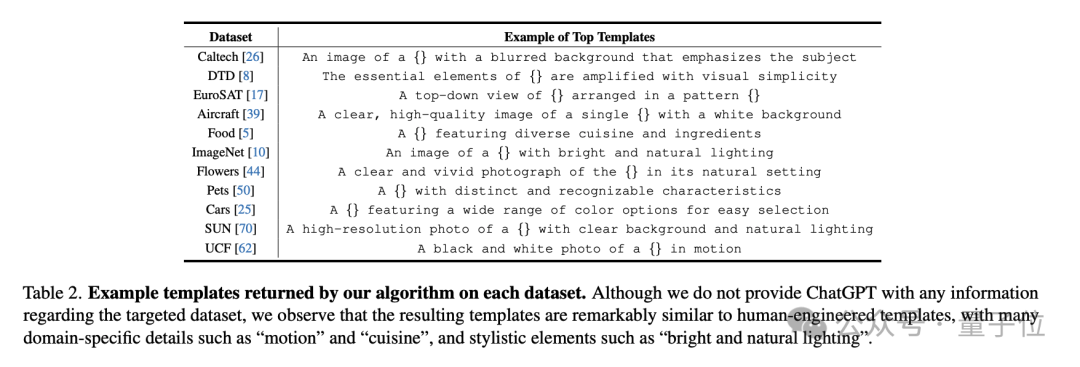

此外,該方法在無需瞭解數據集內容的前提下,自動捕捉到了下遊任務的視覺特性並將其融入提示詞中,取得了更好的效果。

例如,在食物識別任務中,ChatGPT 自動將提示詞調整為識別「多樣化的美食和原料」,從而提升了模型的表現。

研究團隊還證明了,通過 ChatGPT 黑盒優化得到的提示詞不僅適用於單一模型架構,還能在不同模型架構(如 ResNet 和 ViT)之間泛化,並且在多種模型上表現優於白盒優化得到的提示詞。

這一系列實驗證明,大語言模型能夠從提示詞的性能反饋中提取出隱含的「梯度」方向,從而實現無需反向傳播的模型優化。

在文生圖任務中的應用

CMU 團隊進一步探索了該方法在生成任務中的應用潛力。

在文本到圖像生成(T2I)任務中,ChatGPT 能夠自動優化提示詞,從而生成更符合用戶需求的高質量圖像。

例如,對於輸入描述「一個動物注視著一個人」,系統可以通過逐步優化提示詞來提升生成圖像的準確性。

此外,這一方法還適用於提示反演(Prompt Inversion)。

提示反演是一種根據現有圖像反推生成模型輸入提示詞的技術,簡單來說,就是通過圖像生成能夠再現其特徵的文本描述(提示詞)。

研究團隊在複雜的文本到圖像任務上進行了測試,結果表明這一方法僅需三輪提示詞優化,就能顯著提高用戶的滿意度。

此外,研究團隊還指出,提示反演可以幫助用戶快速定製特定的圖像效果,例如「讓這隻狗變成站立姿勢」或「讓背景變成夜景」,從而生成符合特定需求的圖像。

CMU 團隊表示,提出的黑盒優化範式突破了傳統模型調優的限制,不僅在圖像分類和生成任務中表現出色,還展示了廣泛的應用潛力。

這一方法無需訪問模型權重,僅通過「文本梯度」實現精準優化,具備強大的擴展性。

未來,黑盒優化有望應用於實時監控、自動駕駛、智能醫療等複雜動態場景,為多模態模型的調優帶來更加靈活高效的解決方案。

團隊介紹

團隊的一作劉士弘(Shihong Liu)是卡內基梅隆大學的研究生畢業生,曾任機器人研究所研究員。

目前在 北美Amazon 工作,負責大型分佈式系統的計算和大語言模型驅動的 AI Agent 的開發。

△劉士弘(Shihong Liu)

△劉士弘(Shihong Liu)團隊的共同一作林之秋(Zhiqiu Lin)是卡內基梅隆大學的博士研究生,專注於視覺-語言大模型的自動評估與優化。

Zhiqiu Lin在CVPR、NeurIPS、ICML、ECCV等頂級會議上發表了十數篇論文,並曾榮獲最佳論文提名和最佳短論文獎等。

△林之秋(Zhiqiu Lin)

△林之秋(Zhiqiu Lin)Deva Ramanan教授是計算機視覺領域的國際知名學者,現任卡內基梅隆大學教授。

△Deva Ramanan教授

△Deva Ramanan教授他的研究涵蓋計算機視覺、機器學習和人工智能領域,曾獲得多項頂級學術榮譽,包括2009年的David Marr獎、2010年的PASCAL VOC終身成就獎、2012年的IEEE PAMI青年研究員獎、2012年《大眾科學》評選的「十位傑出科學家」之一、2013年美國國家科學院Kavli Fellow、2018年和2024年的Longuet-Higgins獎,以及因其代表性工作(如COCO數據集)獲得的Koenderink獎。

此外,他的論文在CVPR、ECCV和ICCV上多次獲得最佳論文提名及榮譽獎。他的研究成果對視覺識別、自動駕駛、和人機交互等應用產生了深遠影響,是該領域極具影響力的科學家之一。

CVPR’24論文鏈接:

https://arxiv.org/abs/2309.05950

論文代碼:

https://github.com/shihongl1998/LLM-as-a-blackbox-optimizer

項目網站:

https://llm-can-optimize-vlm.github.io