13.8倍吞吐提升!浙大上海AI Lab等提出視覺生成新範式,從「下一個token」到「下一個鄰域」

NAR團隊 投稿

量子位 | 公眾號 QbitAI

在圖像/影片生成任務中,傳統的「下一個token預測」方法正面臨嚴重的效率瓶頸。

怎麼辦?

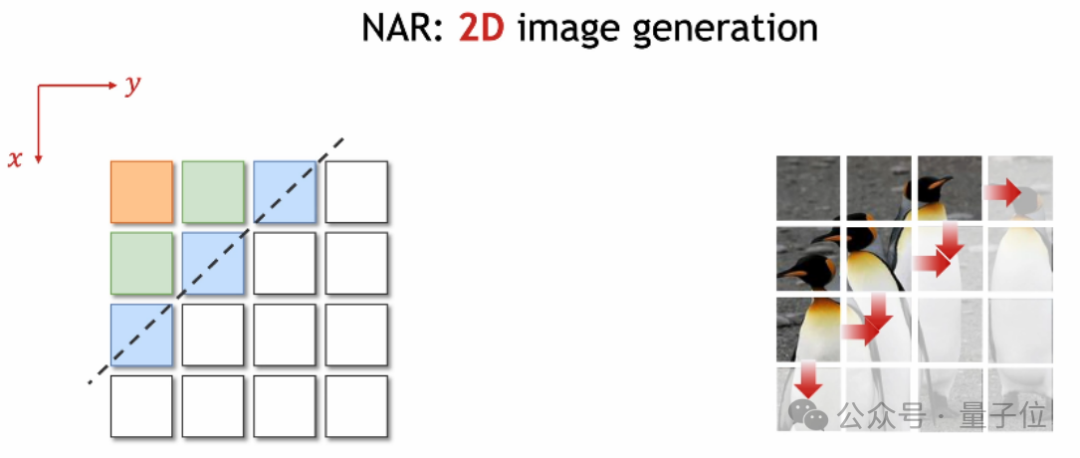

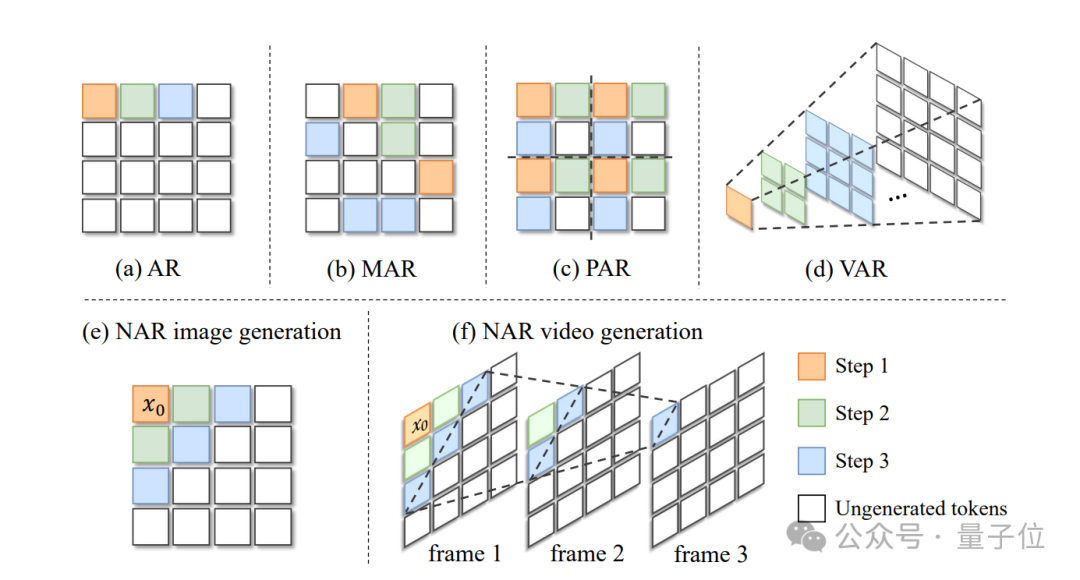

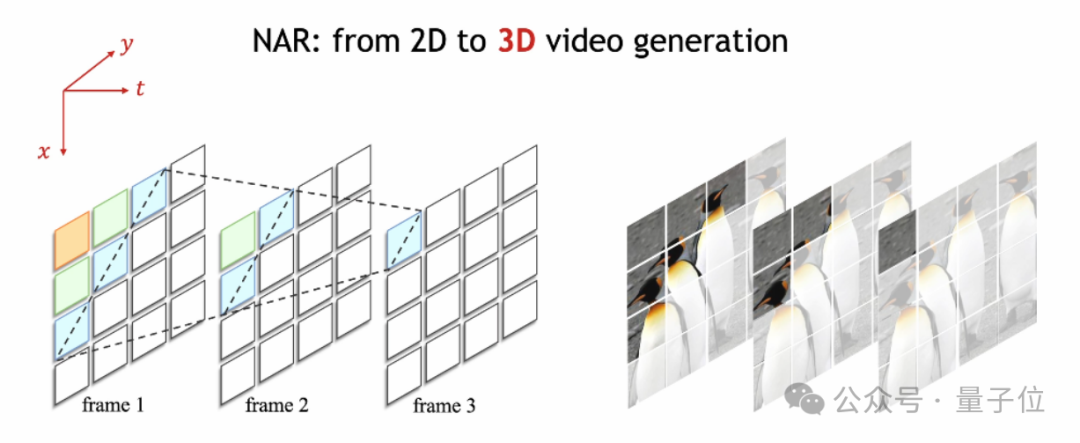

來自浙大、上海AI Lab等機構的研究人員提出了一種全新的視覺生成範式——鄰近自回歸建模(Neighboring Autoregressive Modeling, NAR)。與傳統的「下一個token預測」不同,NAR模型採用了「下一個鄰域預測」的機制,將視覺生成過程視為一種逐步擴展的「外繪」過程。

具體來說,NAR模型從初始token開始,按照與初始token的曼哈頓距離從小到大依次生成token。這種生成順序不僅保留了視覺內容的空間和時間局部性,還允許模型在生成過程中並行預測多個相鄰的token。

為了實現這一點,研究人員引入了維度導向的解碼頭,每個頭負責在空間或時間的一個正交維度上預測下一個token。

通過這種方式,NAR模型能夠在每一步中並行生成多個token,從而大幅減少了生成所需的模型前向計算步驟。

下面具體來看。

從「下一個token」到「下一個鄰域」

在當今的AI領域,視覺生成任務(如圖像和影片生成)正變得越來越重要。無論是生成逼真的圖像,還是創造連貫的影片,AI模型的表現都在不斷提升。

然而,現有的視覺生成模型,尤其是基於自回歸(Autoregressive, AR)的模型,面臨著嚴重的效率瓶頸。

傳統的自回歸模型通常採用「下一個token預測」的範式,即按照光柵順序逐個生成圖像或影片的token。這種方法雖然簡單直觀,但在生成高解像度圖像或長影片時,模型需要進行數千次甚至數萬次的前向計算,導致生成速度極其緩慢。

更糟糕的是,現有的加速方法往往以犧牲生成質量為代價。

例如,一些方法嘗試通過並行生成多個token來提高效率,但由於鄰近圖像token之間的強相關性以及上下文信息的缺失,這種方法容易導致生成質量下降。

因此,如何在保持高質量生成的同時,大幅提升生成效率,成為了視覺生成領域的一個關鍵挑戰。

為瞭解決上述問題,研究人員提出了鄰近自回歸建模(NAR)。

正如一開頭提到的,通過引入維度導向的解碼頭,使每個頭負責在空間或時間的一個正交維度上預測下一個token,最終讓NAR模型能夠在每一步中並行生成多個token,從而大幅減少了生成所需的模型前向計算步驟。

值得一提的是,維度導向的解碼頭設計非常靈活,能夠輕鬆擴展到更高維的視覺內容生成。

例如,在影片生成任務中,影片可以被視為三維數據(時間、行、列),NAR模型只需增加一個時間維度的解碼頭,即可在時間、行、列三個正交維度上並行生成token。

對於由 t×n×n 個token表示的影片,NAR模型僅需 2n+t−2 步即可完成生成過程,遠遠少於傳統「下一個token預測」模型所需的 tn2 步。

這一顯著的效率提升使得NAR模型在處理高解像度影片生成任務時具有極大的優勢。

13.8倍吞吐提升

研究人員在多個視覺生成任務上對NAR模型進行了全面評估,實驗結果令人振奮:

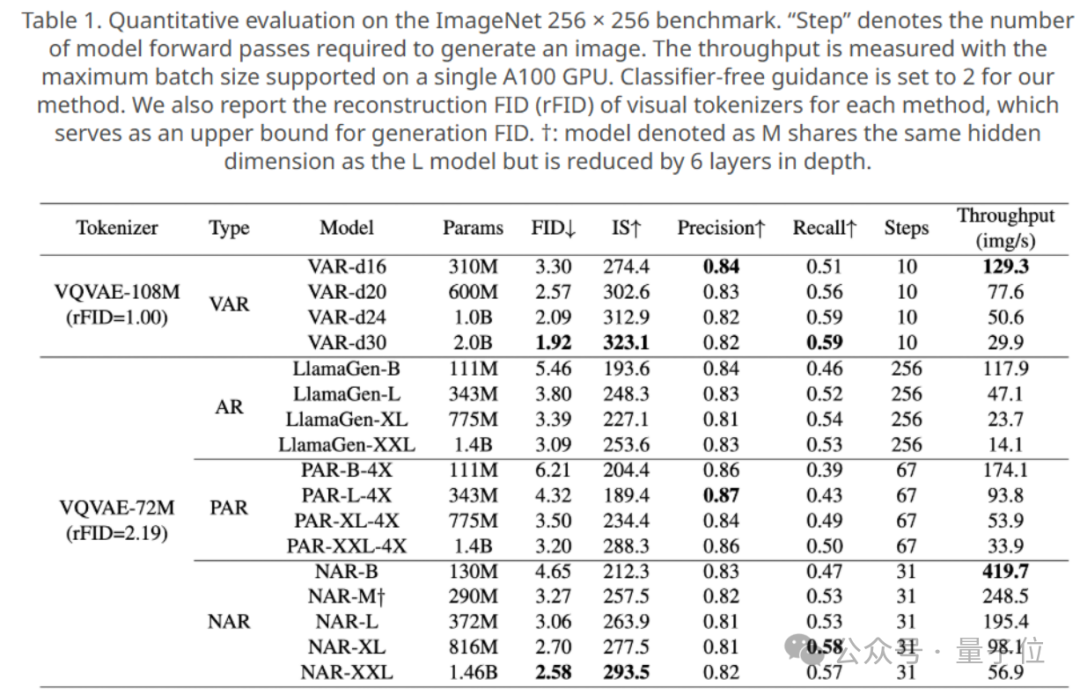

1、類別圖像生成

在ImageNet 256×256數據集上,擁有372M參數的NAR-L取得了比擁有1.4B參數的LlamaGen-XXL更低的FID(3.06 vs. 3.09),同時將生成步數減少了87.8%並帶來了13.8倍的吞吐提升(195.4 images/s vs. 14.1 images/s)。

與VAR-d16模型相比,NAR-M取得了更低的FID的同時(3.27 vs. 3.30),能帶來92%的吞吐提升(248.5 images/s vs. 129.3 images/s)。

這說明與現有的自回歸生成方法相比,NAR模型在生成效率和質量上均取得了顯著提升。

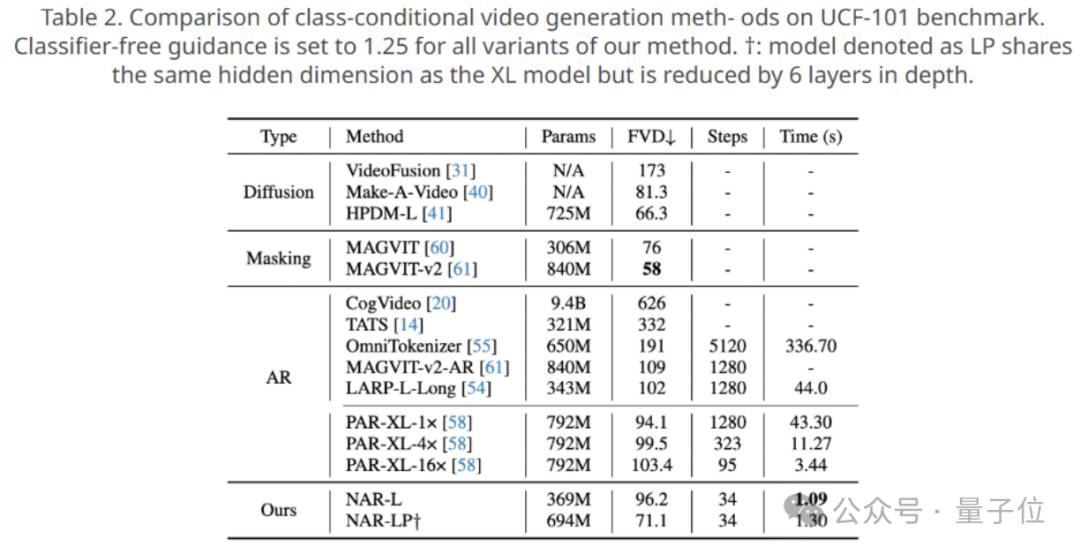

2、類別影片生成

在UCF-101數據集上,NAR模型相比基於「下一個詞預測」(next-token prediction)的自回歸模型在生成步驟上減少了97.3%。

相比並行解碼方法PAR,NAR在FVD更低的同時將吞吐提升了8.6倍。

這得益於NAR模型在時間維度上的並行生成能力,確保了影片幀之間的連貫性和高質量生成。

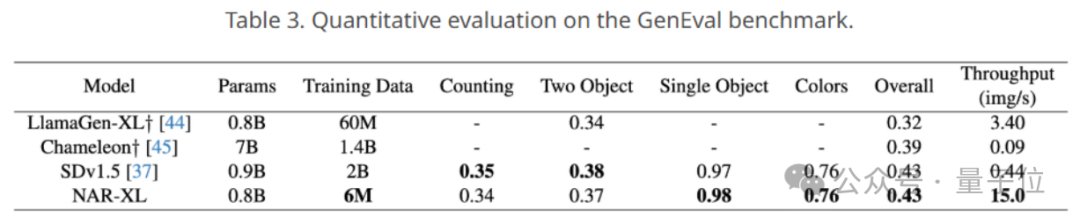

3、文本到圖像生成

在GenEval基準測試中,NAR模型僅使用了0.4%的訓練數據(6M)便獲得了和Stable Diffusion v1.5相持平的綜合得分。

與參數量更大且擁有1.4B訓練數據的Chameleon-7B模型相比,NAR的綜合得分更高(0.43 vs. 0.39)且將吞吐率提高了166倍。

這些實驗結果不僅證明了NAR模型在生成效率上的巨大優勢,還展示了其在生成質量上的卓越表現。

概括而言,NAR模型為視覺生成任務提供了一種高效且高質量的解決方案,有望在未來的AI應用中發揮重要作用。

更多細節歡迎查閱原論文。

論文地址:

https://www.arxiv.org/abs/2503.10696

項目主頁:

https://yuanyu0.github.io/nar/

代碼地址:

https://github.com/ThisisBillhe/NAR

一鍵三連「點讚」「轉發」「小心心」

歡迎在評論區留下你的想法!