OpenAI o1大模型“獵殺時刻”:當AI開始“類思考”,低維爭奪結束了

21世紀經濟報導記者孔海麗 北京報導

預熱一年之久,OpenAI代號為“草莓”的項目終於發佈。

北京時間9月13日淩晨,OpenAI甩出了重大更新,傳說中推理能力登峰造極的大語言模型——OpenAI o1系列模型亮相,複雜推理能力明顯更進一步,極限推理能力甚至超越人類博士水平,代表了大語言模型在推理能力上的重大飛躍。

最驚人的是,OpenAI o1系列已經開始展現出“類思考”的能力——之所以說“類思考”,是因為目前為止,AI大模型尚未突破思考的本質。“自我推理”路徑,更像是達到AGI之前的“花活兒”。

但,當下還未突破,並不意味著未來不可能。

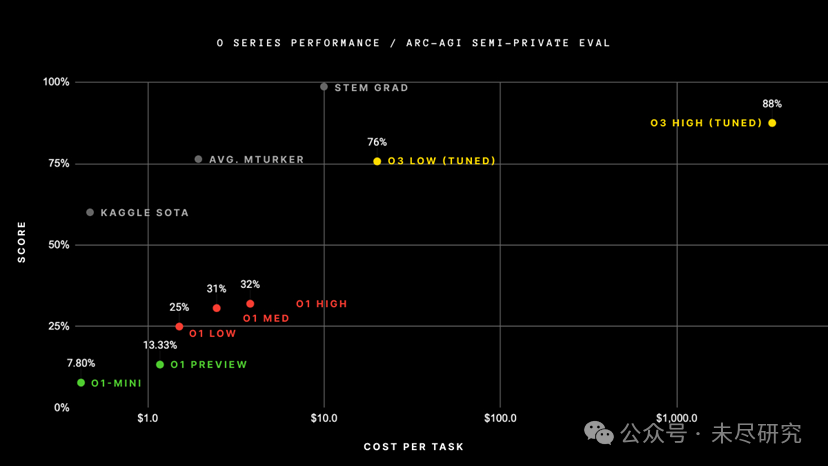

從“什麼都懂一點的‘人工智障’”,到“會自我糾正、選擇合適路徑”的人工智能,通向AGI的路徑,在逐漸清晰。尤其,OpenAI當前放出的o1-preview和o1-mini,還只是o1系列的“前菜”,按照OpenAI的調性,更多突破或許已經發生,只待合適的時機一一發佈。

正如李彥宏戳破大模型“跑分”假象,OpenAI 憑藉o1系列,又一次把大模型的競爭拉高到了新的水準,低維度的參數、榜單之爭,似乎不再有實際意義。

大模型開始“逐步思考”

根據OpenAI官方消息,o1系列包括o1-preview和o1-mini,前者是“預覽版本”,後者是經濟高效的“小模型”,比preview便宜80%。

這些模型專門為處理更複雜的、多步驟的問題而開發,尤其是在科學、數學和編程領域,超越了之前的模型(如GPT-4)在推理深度和準確性方面的表現。

Sam Altman在X上貼出的對比圖顯示,o1解決數學、編程和博士級別科學題目上的能力,比GPT-4o高出數倍。

OpenAI甚至明確指出,“o1不是gpt-4o的繼任者”,潛台詞在於,o1開啟了一段新的紀元。

整體來看,o1在美國數學奧林匹克預選賽中,排名美國前500名學生之列,並且在物理、生物學、化學基準上,首次超過了人類博士。

但在另一項創新之下,這些得分竟顯得“平平無奇”了起來。

OpenAI o1引入了“思路鏈”。

類似於人類在回答困難問題之前可能會思考很長時間,o1 在嚐試解決問題時學會了磨練其思維鏈並改進策略。它學會了識別和糾正錯誤,學會了將棘手的步驟分解為更簡單的步驟,學會了在當前方法不起作用時繼續嚐試不同的方法。

這種方法模擬了人類的認知過程,能夠逐步完善每個步驟,甚至在一個問題中實現自我迭代,而結果就是,顯著提高了模型的推理能力。

以一道閱讀理解題為例,GPT-4o會直接給出結論,而OpenAI o1-preview有“顯示思路鏈”選項,打開之後,o1-preview會將整個思考過程展示出來,逐步分析每個選項,並反複自問“這是一個很好的解釋嗎?能回答問題本身嗎?”並在一遍又一遍地推敲之後,給出正確答案。

當然,想要節省時間的用戶也可以選擇“隱藏思路鏈”。

英偉達高級科學家Jim Fan對OpenAI o1高度讚揚,他認為,AlphaGo式的自我學習終於有可能在大模型中實現了。

“Strawberry很容易變成一個數據的飛輪。如果答案是正確的,整個搜索跟蹤就成為一個小型的訓練樣本數據集,其中包含正面和負面的反饋。這反過來會改進未來版本GPT的推理核心,就像AlphaGo的價值網絡——用來評估每個棋盤位置的質量——隨著MCTS生成越來越精細的訓練數據而改進一樣。”

也就是說,未來大模型自我學習與思考的能力會像一個飛輪一樣轉起來,就像AlphaGo自己與自己對弈以提升棋藝一樣。

一家跨國公司中國區人工智能大模型從業者告訴21世紀經濟報導記者,從技術上來說,OpenAI o1“思路鏈”技術並不是最新的,但這種應用,讓人隱約看到了推理層面的Scaling Law。

OpenAI官方也蓋章,表示隨著強化學習(訓練時間計算)和思考時間(測試時間計算)的增加,OpenAI o1的性能會不斷提高,擴展這種方法的限制與 LLM 預訓練的限制有很大不同。他們將持續研究這裡面隱含的新的可能性。

離AGI有更近一步嗎?

業界對於OpenAI o1所呈現出的“思考”能力,是有分歧的。

一種觀點認為,OpenAI o1是人工智能大模型領域總結出Scaling Law之後的最重要進展。

所謂Scaling Law,是指隨著參數量、數據量和計算量的增加,大模型的性能能夠不斷提高。

而OpenAI o1增加的,是推理過程和思考時間,同樣明顯提升了模型性能,這打破了大模型進入Scaling Law瓶頸期的擔憂。

DCCI互聯網數據中心創始人胡延平發表評論稱,“草莓”真正開啟的角度是讓AI開始學會思考,而不只是訓練和推理,舉一反三,四顧找尋。長思考,慢思考,深度思考。到了草莓這一步,人們對大模型的理解就不能只停留在“對下一個詞的猜測、對一個問題的一次性的問答”上了。

但另一種觀點認為,前述說法過於誇張。

兩位AI大模型從業者向21世紀經濟報導記者表示,OpenAI o1的確在數學和推理能力方面有大幅度提升,但遠遠不到突破思考本質的階段。

“OpenAI o1沒有解決統計模型根本的缺陷,本質上還是通過大量學習得出正確的結論,很難理解背後的科學邏輯。”前述人士認為,目前,這種“思路鏈”更像是一種“假性思考”的狀態,無需擔心大模型已經有了意識。

“而且,人工智能突破思考本質對人類而言,會是非常危險的事情,短時間內還達不到。”他說。

連Sam Altman本人,都曾在今年3月份的一次採訪中強調,AI目前更多的是一套基於數據和數學的系統,能夠產生統計上可能的結果,而不是“生物”這種全新的生命形態。

在OpenAI那場震驚世界的宮鬥風波中,有一種說法是,OpenAI前首席科學家Ilya Sutskever是因為看到了一些東西(可能是AGI),這讓他內心不安,才說服董事會發起了高層人事“地震”。

Sam Altman也曾反複澄清過:“Ilya看到的不是AGI,沒有人見到過AGI,我們還沒有建造過AGI。”

在AGI到來之前,OpenAI亟待解決的現實問題其實是“賺錢”。

近期消息顯示,OpenAI已就融資事宜與投資者交流,並考慮調整公司架構,以提高對金主的吸引力。與此同時,OpenAI 首席執行官薩姆•奧特曼正在與幾家銀行洽談,以循環貸款的方式籌集50億美元。

而在商業變現方面,此前曾傳出消息,稱“草莓”的訂閱價格或飆升至2000美元/月,飆漲100倍。

不過,OpenAI o1-preview和o1-mini最終發佈的價格並沒有發生變化,只是限定了使用次數,o1-preview每週限制使用次數為30條消息。

OpenAI o1-mini則是一個較小的模型,在使用與o1相同的高計算強化學習 (RL) pipeline 進行訓練後,o1-mini 在許多推理任務上實現了相媲美的性能,同時成本效率顯著提高。但o1-mini 在MMLU等任務上的表現則不如GPT-4o,並且由於缺乏廣泛的世界認知而在GPQA基準上落後於o1-preview。

不可否認的是,OpenAI每一次都引領了AI大模型的新潮流,且這種野心絲毫不見減弱。最新的發佈中,OpenAI表示將在持續迭代的過程中發佈OpenAI o1系列的改進版本,o1 及其繼任者將為AI在科學、編碼、數學和相關領域解鎖許多新的用例。

換而言之,無論o1系列模型是否在歷史意義上突破了“思考”本質,OpenAI都在商業層面把其他同類產品一次又一次地甩在了身後,AI大模型的“不進則退”,比其他領域都更懸殊。