空間智能新進展:教機器人組裝宜家傢俱,首次實現操作步驟與真實影片對齊 | NeurIPS

基爾西 發自 凹非寺

量子位 | 公眾號 QbitAI

史丹福吳佳俊團隊,給機器人設計了一套組裝宜家傢俱的影片教程!

具體來說,團隊提出了用於機器人的大型多模態數據集IKEA Video Manuals,已入選NeurIPS。

數據集涵蓋了6大類IKEA傢俱,每種傢俱都包含完整的3D模型、組裝說明書和實際組裝影片。

而且劃分精細,拆解出的安裝子步驟多達1000多個。

作者介紹,該數據集首次實現了組裝指令在真實場景中的4D對齊,為研究這一複雜問題提供了重要基準。

知名科技博主、前微軟策略研究者Robert Scoble說,有了這個數據集,機器人將可以學會自己組裝傢俱。

團隊成員、史丹福訪問學者李曼玲(Manling Li)表示,這是空間智能領域的一項重要工作:

這項工作將組裝規劃從2D推進到3D空間,通過理解底層視覺細節,解決了空間智能研究中的一個主要瓶頸。

1120個子步驟詳述組裝過程

IKEA Video Manuals數據集中,涵蓋了6大類36種IKEA傢俱,從簡單的凳子到複雜的櫃子,呈現了不同難度的組裝任務。

每一款傢俱,都包括以下三種模態:

-

安裝說明書,提供了任務的整體分解和關鍵步驟;

-

真實組裝影片,展示了詳細的組裝過程;

-

3D模型,定義了部件之間的精確空間關係。

並且這三種模態並非簡單地堆砌在一起,作者通過對影片和操作步驟的拆解,將三種模態進行了精細的對齊。

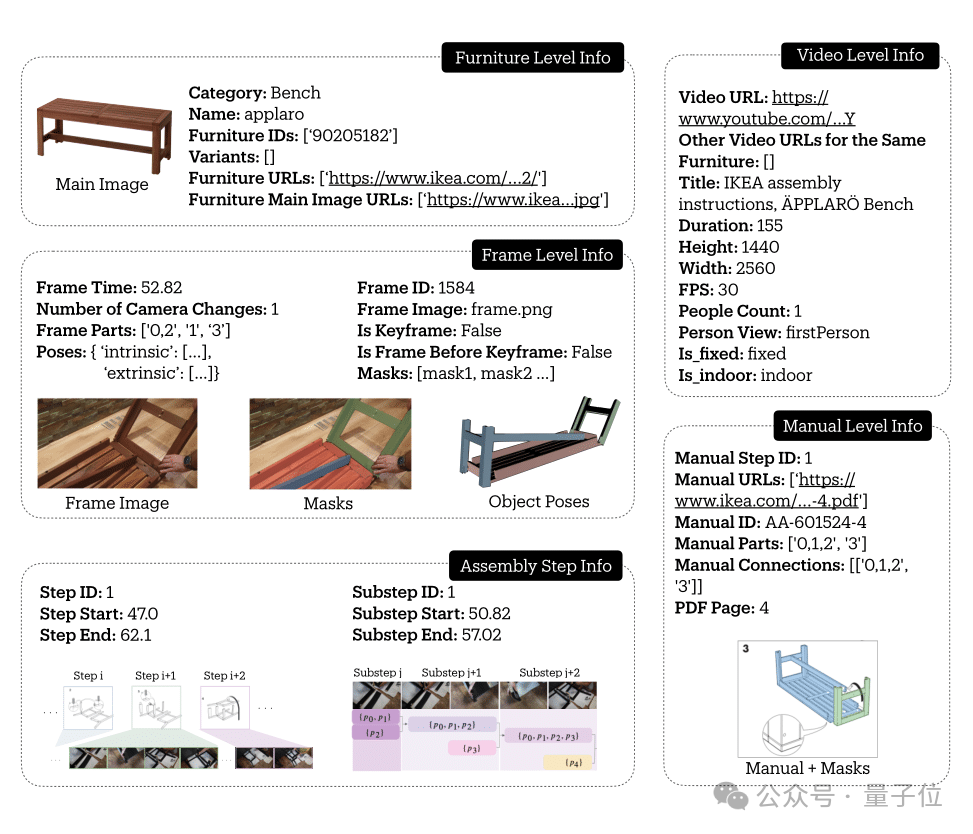

舉個例子,在這樣一條關於長凳的數據當中,包含了其基本概況、影片信息、關鍵幀信息,以及安裝步驟。

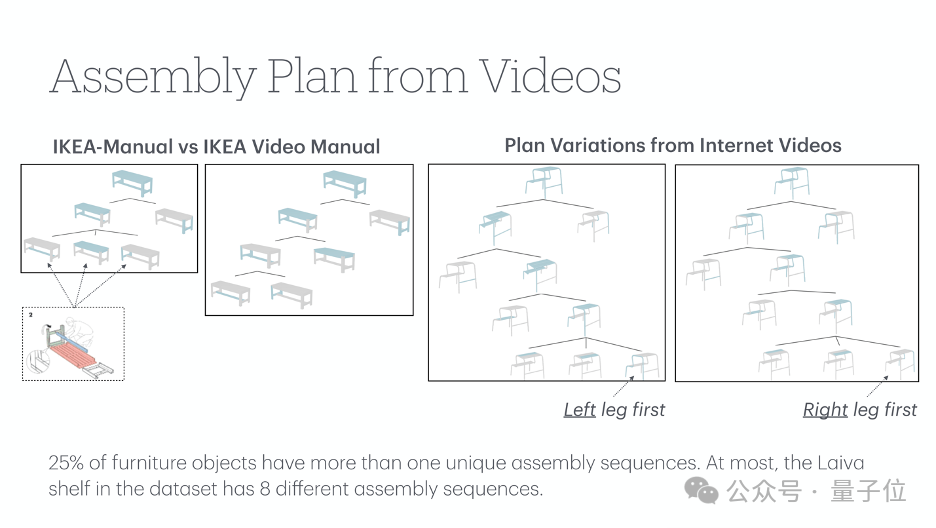

從下圖中可以看出,安裝步驟當中有主要步驟和子步驟的劃分,還標註了對應的影片位置。

整個數據集中,共包含了137個手冊步驟,根據安裝影片被細分為了1120個具體子步驟,捕捉了完整的組裝過程。

並且通過6D Pose追蹤,每個部件的空間軌跡都被精確記錄,最終在影片幀、傢俱組裝說明書和3D模型之間建立了密集的對應關係。

時空信息精細標註

IKEA Video Manuals數據集是在IKEA-Manual和IKEA Assembly in the Wild(IAW)兩個數據集的基礎上建立的。

其中,IKEA-Manual數據集提供了模型及其對應說明書,IAW則包含了大量用戶組裝宜家傢俱的影片片段。

這些影片來自90多個不同的環境,包括室內外場景、不同光照條件,真實反映了傢俱組裝的多樣性。

與在實驗室環境下採集的數據相比,這些真實影片帶來了更豐富的挑戰:

-

部件經常被手或其他物體遮擋;

-

相似部件識別(如四條一模一樣的桌子腿);

-

攝像機頻繁移動、變焦,帶來參數估計的困難;

-

室內外場景、不同光照條件下的多樣性。

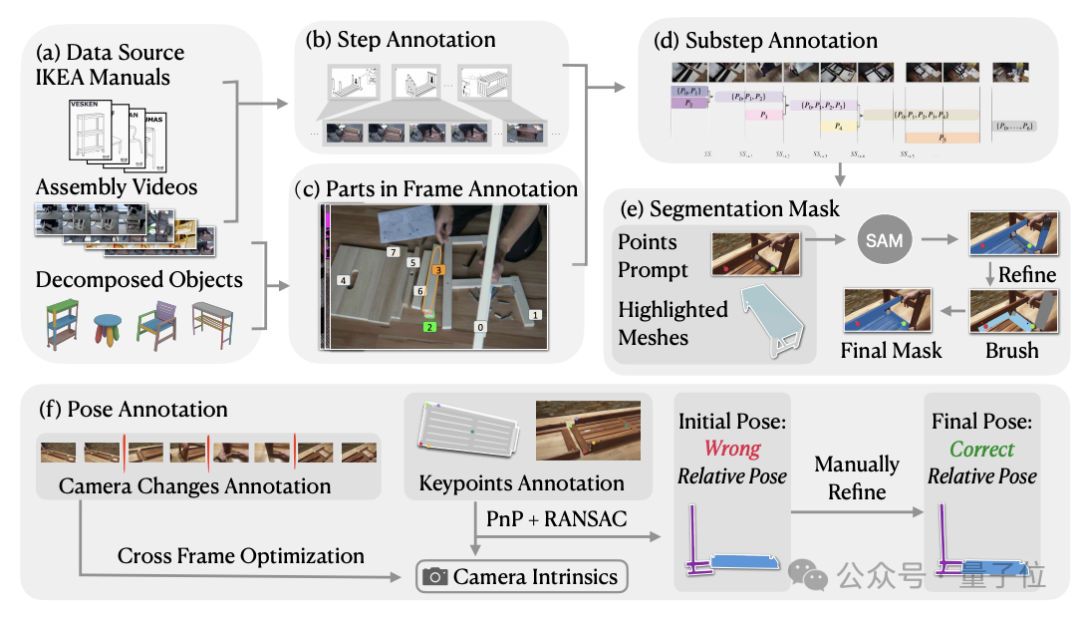

為了獲得高質量的標註,應對真實影片帶來的挑戰,研究團隊建立了一套可靠的標註系統:

-

識別並標註相機參數變化的關鍵幀,確保片段內的一致性;

-

結合2D-3D對應點和RANSAC算法進行相機參數估計;

-

通過多視角驗證和時序約束保證標註質量。

首先,研究者們首先定義了一套層次化的裝配過程描述框架,將整個裝配過程分為步驟、子步驟和影片幀等多個層級。

作者首先從IAW數據集中提取每個手動步驟的影片片段,並將每個影片片段分解為更小的間隔(子步驟)。

對於每個子步驟,作者以1FPS的速度采樣影片幀,並在每個子步驟的第一幀中標註出傢俱部件。

為了在整個組裝影片中對傢俱部件進行跟蹤,作者還在采樣幀中為3D部件註釋了2D圖像分割掩碼。

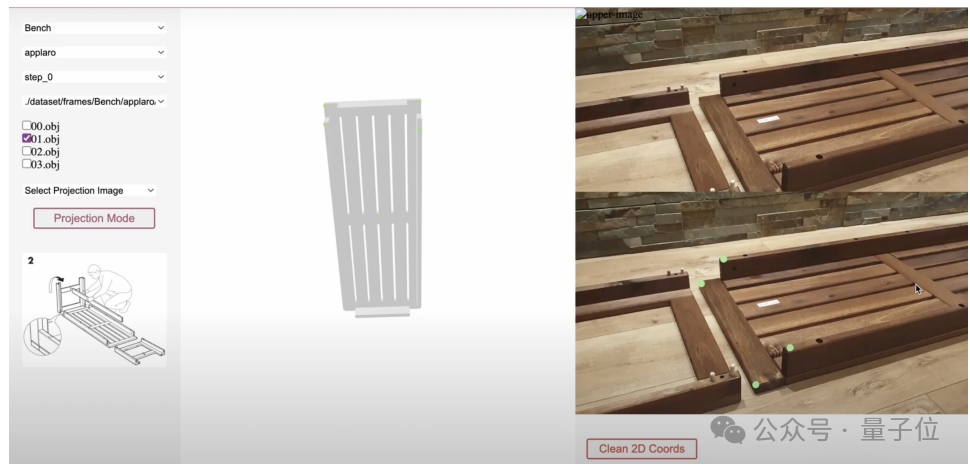

為了促進註釋過程,研究團隊開發了一個顯示輔助2D和3D信息的Web界面,同時該界面還可基於Segment Anything Model(SAM)模型進行交互式掩碼註釋。

標註過程中,標註人員會在3D模型上選中零件,然後在2D影片幀上指示其大致位置,並將其輸入到SAM模型中以實時生成2D分割掩碼。

為瞭解決SAM在提取具有相似紋理的部分之間或低光區域的邊界方面的固有局限,作者還允許標註人員使用畫筆和橡皮擦工具進行手動調整。

此外,作者還要估計影片中的相機參數,為此研究者們首先人工標記出影片幀中可能出現相機運動(如焦距變化、切換視角等)的位置,然後標註出影片幀和3D模型之間的2D-3D對應關鍵點。

最後,結合這兩類標註信息,研究者們使用PnP (Perspective-n-Point)算法估計出每段影片的相機內參數,得到相機參數的初始估計後,利用交互式工具來細化每個影片幀中零件的6D姿態。

空間模型能力評估

基於IKEA Video Manuals數據集,團隊設計了多個核心任務來評估當前AI系統在理解和執行傢俱組裝,以及空間推理(spatial reasoning)方面的能力。

首先是基於3D模型的分割(Segmentation)與姿態估計(Pose Estimation)。

此類任務輸入3D模型和影片幀,要求AI準確分割出特定部件區域,並估計其在影片中的6自由度姿態。

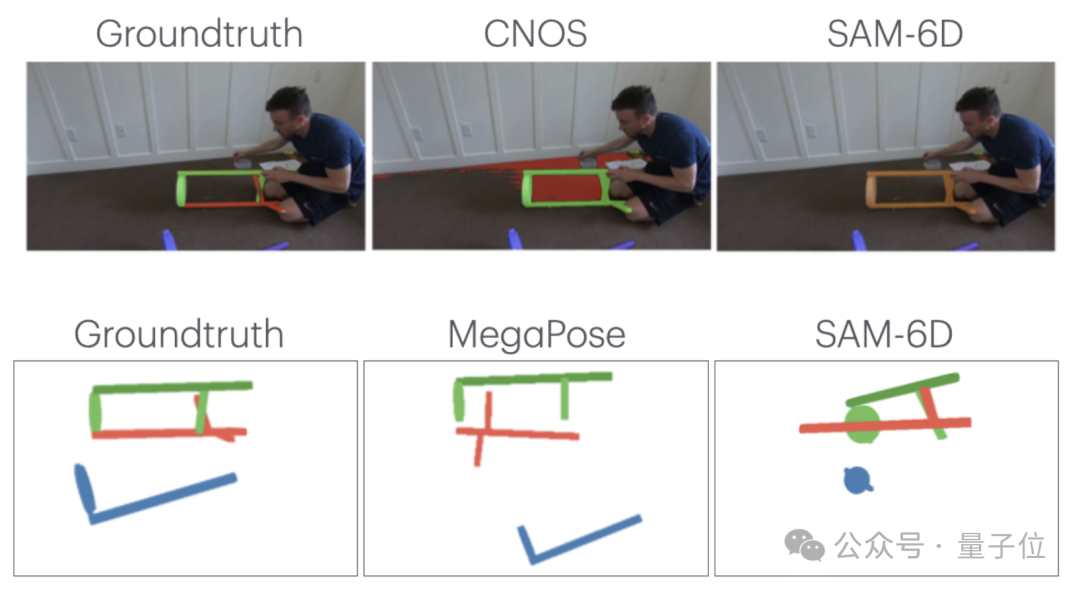

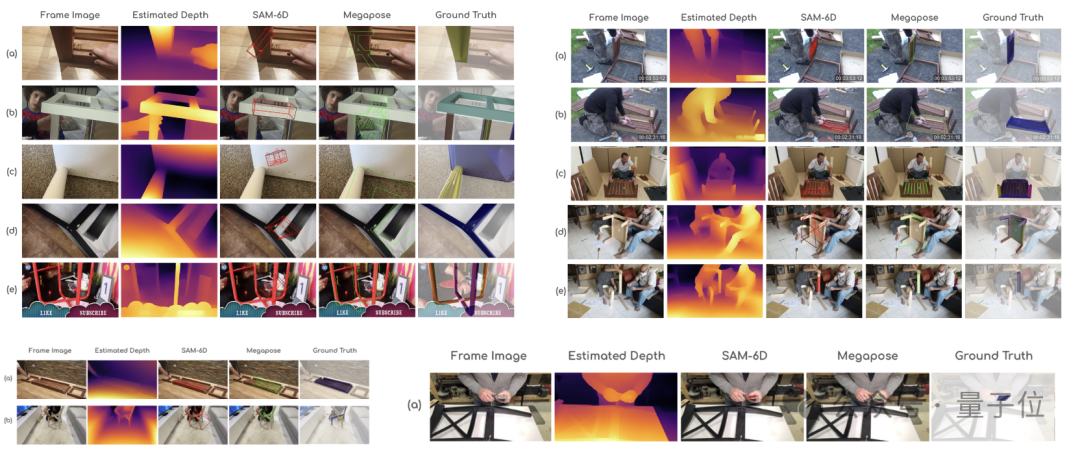

△上:基於3D模型的分割,下:基於3D模型的姿態估計

△上:基於3D模型的分割,下:基於3D模型的姿態估計實驗測試了最新的分割模型(CNOS, SAM-6D)和姿態估計模型(MegaPose)。

分析發現,它們在以下場景表現不佳:

-

遮擋問題:手部遮擋、近距離拍攝導致部分可見、遮擋引起的深度估計誤差;

-

特徵缺失:缺乏紋理的部件難以分割、對稱部件的方向難以判斷;

-

特殊拍攝角度(如俯視)導致的尺度誤判。

△上:遮擋問題,左下:特徵缺失,右下:特殊角度

△上:遮擋問題,左下:特徵缺失,右下:特殊角度第二類任務是影片目標分割,作者對比測試了兩個最新的影片追蹤模型SAM2和Cutie。

結果顯示,在真實組裝場景中,這些模型同樣面臨著三大挑戰。

一是相機的運動,可能導致目標丟失。

二是難以區分外觀相似的部件(如多個相同的桌腿)。

最後,保持長時間追蹤的準確度也存在一定難度。

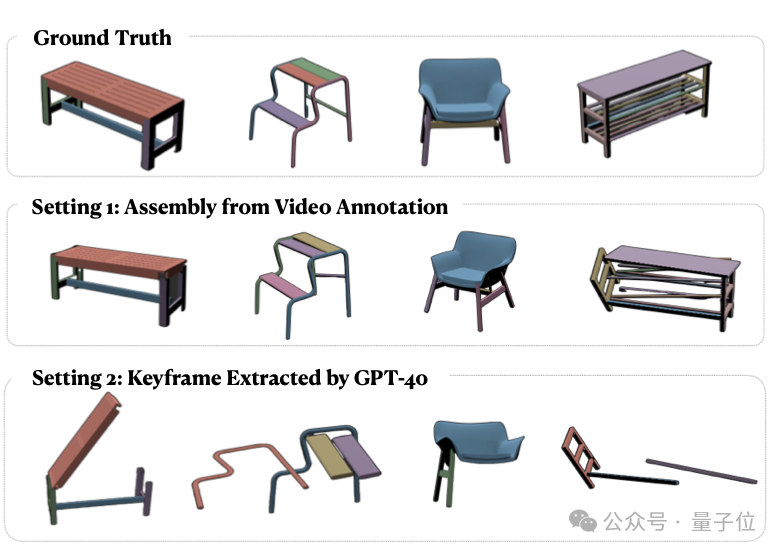

第三類任務,是基於影片的形狀組裝。

團隊提出了一個創新的組裝系統,包含關鍵幀檢測、部件識別、姿態估計和迭代組裝四個步驟。

實驗採用兩種設置:

-

使用GPT-4V自動檢測關鍵幀:結果不理想,Chamfer Distance達0.55,且1/3的測試影片未能完成組裝;

-

使用人工標註的關鍵幀:由於姿態估計模型的局限性,最終Chamfer Distance仍達0.33。

這些實驗結果揭示了當前AI模型的兩個關鍵局限:

-

影片理解能力不足:當前的影片模型對時序信息的分析仍然較弱,往往停留在單幀圖像分析的層面;

-

空間推理受限:在真實場景的複雜條件下(如光照變化、視角改變、部件遮擋等),現有模型的空間推理能力仍顯不足。

作者簡介

本項目第一作者,是史丹福大學計算機科學碩士生劉雨濃(Yunong Liu)目前在史丹福SVL實驗室(Vision and Learning Lab),由吳佳俊教授指導。

她本科畢業於愛丁堡大學電子與計算機科學專業(榮譽學位),曾在德克薩斯大學奧史甸分校從事研究實習。

她本科畢業於愛丁堡大學電子與計算機科學專業(榮譽學位),曾在德克薩斯大學奧史甸分校從事研究實習。史丹福大學助理教授、清華姚班校友吳佳俊,是本項目的指導教授。

另據論文信息顯示,史丹福大學博士後研究員劉蔚宇(Weiyu Liu),與吳佳俊具有同等貢獻。

另據論文信息顯示,史丹福大學博士後研究員劉蔚宇(Weiyu Liu),與吳佳俊具有同等貢獻。

此外,Salesforce AI Research研究主任Juan Carlos Niebles,西北大學計算機科學系助理教授、史丹福訪問學者李曼玲(Manling Li)等人亦參與了此項目。

其他作者情況如下:

項目主頁:

https://yunongliu1.github.io/ikea-video-manual/

論文地址:

https://arxiv.org/abs/2411.11409