全球五大巨頭GPU總量曝光,2025年等效H100或超1240萬塊

今年,馬斯克用全球最大AI超算Colossus轟動了整個世界。

這台超算配備了10萬張英偉達H100/H200顯卡,並預計未來即將擴展到20萬張。

自此,AI巨頭們倍感壓力,數據中心大戰火上澆油。巨頭們紛紛醞釀著各自的建造計劃。

最近,LessWrong網站上發表了一篇博客,根據公開數據對英偉達芯片的產量、各個AI巨頭的GPU/TPU數量進行了估計,並展望了芯片的未來。

博客地址:https://www.lesswrong.com/posts/bdQhzQsHjNrQp7cNS/estimates-of-gpu-or-equivalent-resources-of-large-ai-players#Nvidia_chip_production

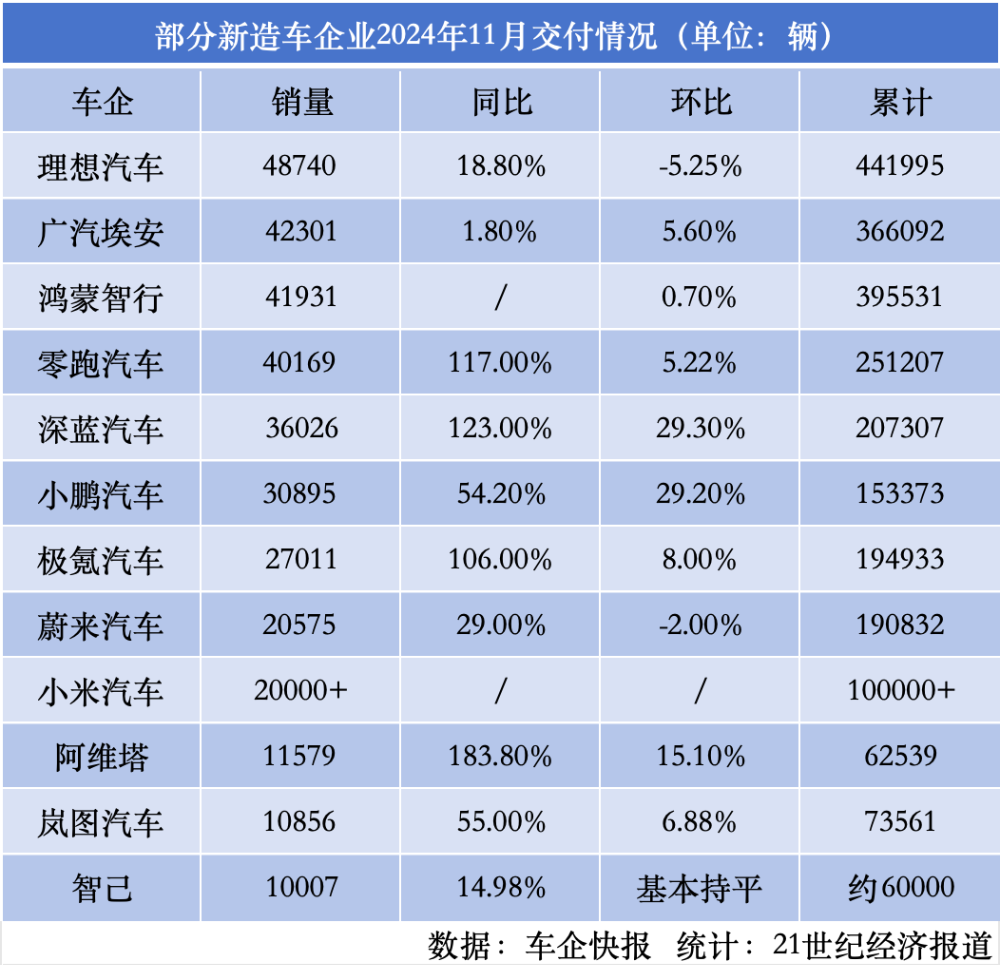

截止目前,世界五大科技公司的2024年擁有的算力,以及2025年的預測:

微軟有75萬-90萬塊等效H100,明年預計達到250萬-310萬

Google有100萬-150萬塊等效H100,明年預計達到350萬-420萬

Meta有55萬-65萬塊等效H100,明年預計達到190萬-250萬

亞馬遜有25萬-40萬塊等效H100,明年預計達到130萬-160萬

xAI有10萬塊等效H100,明年預計達到55萬-100萬

芯片數量估算總結

芯片數量估算總結可見,他們都在緊鑼密鼓地佈局自己的算力版圖,開展下一代更先進模型的訓練。

GoogleGemini 2.0預計在本月正式上線。此前,馬斯克也曾透露,Grok 3也會在年底亮相,具體時間仍舊未知。

他表示,在法律問題數據集上完成訓練後,下一代Grok 3將是一個強大的私人律師,能全天候提供服務。

為了追趕勁敵,OpenAI o2模型據稱也在訓練中了。

這一切訓練的開展,都離不開GPU/TPU。

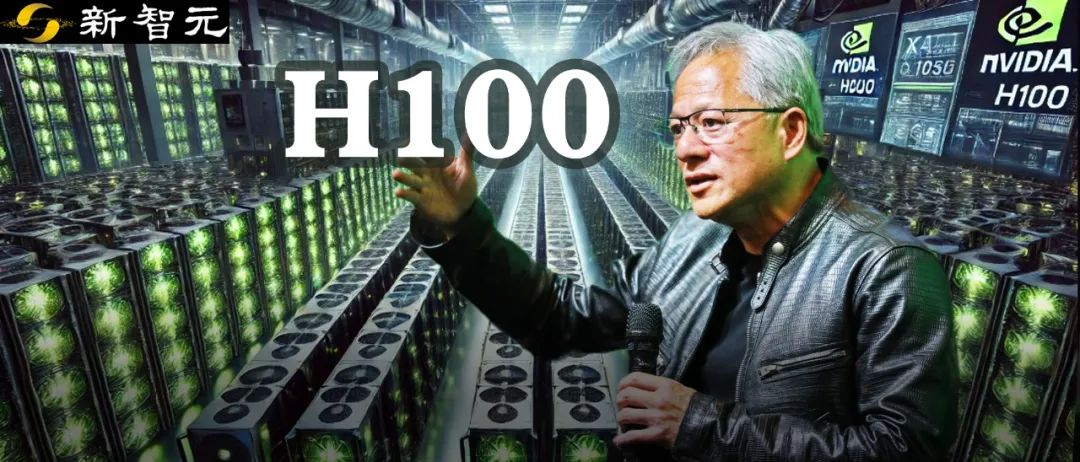

英偉達穩坐GPU霸主,25年或暴銷700萬塊

毋庸置疑,英偉達早已躍升為數據中心GPU的最大生產商。

11月21日,英偉達發佈的2025財年第三季度財報預計,2024自然年的數據中心收入將達1100億美元,比2023年的420億美元增長了一倍多,2025年有望突破1730億美元。

收入主力,那便是GPU了。

據估計,2025年英偉達銷量為650萬至700萬塊GPU,幾乎全是最新的Hopper和Blackwell系列。

根據生產比例和產量預期,其中約包括200萬塊Hopper,500萬塊Blackwell。

今年產量:500萬塊H100

那麼,2024年英偉達實際產量是多少?目前,關於這一數據來源較少,有些甚至還對不上。

不過,有估算稱2024年第四季度將生產約150萬塊Hopper GPU。不過這包括一些性能較低的H20芯片,因此是一個上限值。

根據季度間數據中心收入比例推測,全年生產總量可能上限為500萬塊——這是基於每塊H100等效芯片收入約2萬美元的假設,而這個單價似乎偏低;如果使用更合理的2.5萬美元計算,實際產量應該在400萬塊左右。

這一數據與年初估計的150萬至200萬塊H100生產量存在差異。目前尚不清楚這一差異是否可以歸因於H100與H200的區別、產能擴大或其他因素。

但由於這一估算與收入數據不一致,選擇使用更高的數字作為參考。

此前的產量

為了評估目前以及未來誰擁有最多的計算資源,2023年之前的數據對整體格局的影響有限。

這主要是因為GPU性能本身的提升,以及從英偉達的銷售數據來看,產量已經實現了大幅增長。

根據估算,微軟和Meta在2023年各自獲得了約15萬塊H100 GPU。結合英偉達的數據中心收入,2023年H100及同等級產品的總產量很可能在100萬塊左右。

五大科技巨頭,等效H100預測

截止2024年底,微軟、Meta、Google、亞馬遜、xAI將擁有多少塊等效H100?2025年他們又將擴展到多少塊GPU/TPU?

從季度報告(10-Q)和年度報告(10-K)中可以看出,英偉達的客戶分為「直接客戶」和「間接客戶」。

其中,46%的收入都是來自直接客戶,包括像SMC、HPE、戴亞這樣的系統集成商。

他們通過採購GPU,然後組裝成服務器,提供給間接客戶使用。

間接客戶覆蓋的範圍就非常廣泛,比如公有雲服務提供商、互聯網消費類公司、企業用戶、公共部門機構和創業公司都屬於這一範疇。

更直白講,微軟、Meta、Google、亞馬遜、xAI都是「間接客戶」(關於他們的擁有GPU相關信息披露相對寬鬆,但可信度可能較低)。

2024年財年報告中,英偉達披露了,約19%的總收入來自通過系統集成商和分銷商採購產品的間接客戶。

根據交易規定,他們必須披露收入佔比超過10%的客戶信息。那麼,英偉達的這個數據透露了什麼?

要麼是,第二大客戶規模只有第一大客戶的一半,要麼是這些數據存在測量誤差。

這其中,最大的客戶可能是誰?

從現有信息來看,最有可能的候選者是微軟。

微軟、Meta

微軟很可能就是英偉達這兩年的最大客戶,這一判斷基於以下幾個因素:

首先,微軟擁有全球最大的公有雲服務平台之一;其次,它是OpenAI的主要算力供應商;再者,與Google、亞馬遜不同,微軟沒有大規模部署自己的定製芯片;最後,微軟似乎與英偉達建立了特殊的合作關係——他們是首個獲得Blackwell GPU的公司。

今年10月,微軟Azure已經開始測試32個GB200服務器的機架。

2024年微軟的收入佔比數據沒有2023年那麼精確,英偉達第二季度財報(10-Q)中提到上半年為13%,第三季度僅「超過10%」。

這表明,微軟在英偉達銷售中的份額較2023年有所降低。

另有彭博統計,微軟佔英偉達收入15%,其次是Meta佔13%,亞馬遜佔6%,Google約佔6%(不過資料中並未明確指出這些數據具體對應哪些年份)。

去年來自Omdia研究統計,2023年底Meta、微軟各有15萬塊H100,亞馬遜、Google和甲骨文各5萬塊,這一數據與彭博數據更為吻合。

不過,Meta曾發文宣稱,到2024年底將擁有相當於60萬塊H100算力。據稱這包括35萬塊 H100,剩餘部分很可能是H200,以及少量將在最後一個季度交付的Blackwell芯片。

如果假設這60萬的數字準確無誤,並結合收入佔比進行推算,便可以更準確地估計微軟的可用算力。

微軟預計將比Meta高出25%到50%,也就是相當於75萬—90萬塊等效H100算力。

Google、亞馬遜

僅從英偉達收入的貢獻來看,亞馬遜、Google無疑是落後於微軟Meta。然而,這兩家公司的情況有著顯著差異。

Google已經擁有大量自研的定製TPU,這是內部工作負載的主要計算芯片。

去年12月,Google推出了下一代迄今為止最強大的AI加速器TPU v5p。

Semianalysis在2023年底一篇報導中指出,Google是唯一一家擁有出色自研芯片的公司。

Google在低成本、高性能且可靠的大規模AI部署方面的能力幾乎無人能及,是全球算力最豐富的企業。

而且,Google在基礎設施上的投入,只會越來越多。2024年第三季度財報估計,AI支出為130億美元,「大部分」用在搭建技術基礎設施,其中其中60%是服務器(GPU/TPU)。

大部分或許意味著70-110億美元,其中在TPU/GPU服務器上預估耗資45-70億美元。

按照TPU對GPU支出2:1的估算,並保守假設TPU的每美元性能與微軟的GPU支出相當,預計到2024年底Google將擁有相當於100萬到150萬塊等效H100算力。

相比之下,亞馬遜內部AI工作負載規模很可能小得多。

他們持有相當數量的英偉達芯片,主要是為了滿足通過其雲平台提供的外部GPU需求,尤其是為Anthropic提供算力需求。

畢竟,亞馬遜和微軟一樣,都是金主爸爸,負責為OpenAI勁敵提供充足算力。

另一方面,亞馬遜雖也有自研的Trainium和Inferentia芯片,但他們在這方面的起步比Google的TPU晚得多。

這些芯片似乎遠落後於業界最先進水平,他們甚至提供高達1.1億美元的免費額度來吸引用戶嘗試,這表明目前的市場接受度並不理想。

不過,今年年中,亞馬遜定製芯片似乎出現了的轉機。

在2024年第三季度財報電話會議上,CEO Andy Jassy在談到Trainium2時表示,這些芯片獲得了巨大的市場興趣,我們已多次與製造合作夥伴協商,大幅提高原定的生產計劃。

Semianalysis報導指出,「根據我們已知數據,微軟和Google於2024年在AI基礎設施上的投資計劃,大幅領先亞馬遜部署的算力」。

這些芯片換算成等效H100並不明確,關於Trainium/Trainium2芯片的具體數量也難以獲得,僅知道在上述免費額度計劃中提供了4萬塊。

xAI

今年,xAI在基礎設施搭建中,最為標誌性事件便是——122天建成了10萬塊H100組成的世界最大超算。

而且,這一規模還在不斷擴展中。馬斯克預告了未來將擴展到20萬塊由H100/H200組成的超算。

據稱,xAI超算目前似乎在站點供電方面遇到了一些問題。

2025年Blackwell芯片預測

最新2024 AI現狀報告對Blackwell採購量進行了估算:

大型雲計算公司正在大規模採購GB200系統:微軟介於70萬到140萬塊之間,Google40萬塊,AWS 36萬塊。據傳OpenAI獨自擁有至少40萬塊GB200。

如果將微軟GB200預估值設為100萬塊,那麼Google、AWS這些數字與它們在英偉達採購中,相對於微軟的比例是相符的。

這也使得微軟佔英偉達總收入的12%,與2024年其在英偉達收入份額的小幅下降趨勢一致。

該報告雖然沒有給出Meta的具體估計數字,但Meta預計明年人工智能相關基礎設施支出將顯著加速,這表明其在英偉達支出中將繼續保持高份額。

lesswrong預計在2025年,Meta的支出規模將維持在微軟支出的約80%水平。

雖然沒有提及xAI,但馬斯克宣稱,將在2025年夏天部署一個有30萬塊Blackwell芯片的運算集群。

慮到馬斯克一貫的誇張風格,更為合理的一個估計是,到2025年底他們可能實際擁有20萬—40萬塊芯片。

那麼,一塊B200相當於多少塊H100?這個問題對於評估算力增長至關重要。

就訓練而言,性能預計飆升(截至2024年11月)2.2倍。英偉達發佈當天,給出的數據稱,兩個B200組成的GB200,其性能是H100的7倍,訓練速度是H100的4倍。

對於Google,假設英偉達芯片繼續佔其總邊際計算能力的三分之一。對於亞馬遜,這一比例假定為75%。

值得注意的是,仍有大量H100和GB200芯片未被計入上述統計中。

有些是未達到英偉達收入報告閾值的機構,還有些是像甲骨文這樣的雲服務提供商和其他中小型雲服務提供商可能持有相當數量的芯片。

此外,也包括一些英偉達重要的非美國客戶。

在全面瞭解各家手握多少GPU/TPU算力之後,下一個問題是,這些算力將用在哪?

巨頭們訓練模型用了多少算力?

以上都討論的是關於各個AI巨頭總計算能力的推測,但許多人可能更關心最新前沿模型的訓練使用了多少計算資源。

以下將討論OpenAI、Google、Anthropic、Meta和xAI的情況。

但由於這些公司要麼是非上市企業,要麼規模巨大無需披露具體成本明細(比如Google,AI訓練成本目前只是其龐大業務的一小部分),因此以下分析帶有一定的推測性。

OpenAI和Anthropic

2024年OpenAI的訓練成本預計達30億美元,推理成本為40億美元。

據稱,微軟向OpenAI提供了40萬塊GB200 GPU,用於支持其訓練。這超越了AWS整體的GB200容量,使OpenAI的訓練能力遠超Anthropic。

另一方面,Anthropic 2024年預計虧損約20億美元,而收入僅為幾億美元。

考慮到Anthropic的收入主要來自API服務且應該帶來正毛利,且推理成本應該相對較低,這意味著20億美元中,大部分都用於模型訓練。

保守估計其訓練成本為15億美元,這大約是OpenAI的一半,但並不妨礙其在前沿模型上的競爭力。

這種差異也是可以理解的。Anthropic的主要雲提供商是資源相對有限的AWS,AWS的資源通常少於為OpenAI提供算力支持的微軟。這可能限制了Anthropic的能力。

Google和Meta

Google的Gemini Ultra 1.0模型使用了約為GPT-4的2.5倍的計算資源,發佈時間卻晚了9個月。其所用的計算資源比Meta的最新Llama模型高25%。

儘管Google可能擁有比其他公司更多的計算能力,但作為雲服務巨頭,它面臨著更多樣的算力需求。與專注於模型訓練的Anthropic或OpenAI不同,Google和Meta都需要支持大量其他內部工作負載,如社交媒體產品的推薦算法等。

Llama 3所用計算資源比Gemini少,且發佈時間晚8個月,這表明Meta分配給前沿模型的資源相較OpenAI和Google更少。

xAI

據報導,xAI使用了2萬塊H100訓練Grok 2,並計劃用10萬塊H100訓練Grok 3。

作為參考,GPT-4據稱使用2.5萬塊A100進行了90-100天的訓練。

考慮到H100的性能約為A100的2.25倍,Grok 2的訓練計算量約為GPT-4的兩倍,而Grok 3則預計達到其5倍,處於計算資源利用的前沿水平。

此外,xAI並非完全依賴於自有芯片資源,部分資源來源於租賃——據估算,他們從Oracle雲平台租用了1.6萬塊H100。

如果xAI分配給訓練的計算資源比例接近OpenAI或Anthropic,推測其訓練規模可能與Anthropic相當,但低於OpenAI和Google的水平。

參考資料:

https://www.lesswrong.com/posts/bdQhzQsHjNrQp7cNS/estimates-of-gpu-or-equivalent-resources-of-large-ai-players

本文來自微信公眾號「新智元」,作者:新智元,編輯:編輯部 HYj,36氪經授權發佈。