稚暉君開源百萬機器人真機數據集

衡宇 發自 凹非寺

量子位 | 公眾號 QbitAI

年末大禮包,稚暉君他又雙叒來開源了!

百萬真機數據集開源項目AgiBot World,也是全球首個基於全域真實場景、全能硬件平台、全程質量把控的大規模機器人數據集。

該項目由稚暉君具身智能創業項目智元機器人,攜手上海AI Lab、國家地方共建人形機器人創新中心以及上海庫帕思聯合發佈。

GitHub和抱抱臉上已經可以自取了(本文文末附直通車)~

說起來,此前在該領域在全球內,不是沒有玩家做過大規模的數據集:

比如GoogleDeepMind曾構建過Open X-Embodiment數據集,數據整合自22種不同本體的機器人。

但其中大部分數據缺乏統一標準化的採集流程,且許多用於數據採集的機器人構型已經過時,數據質量格式參差不齊——這就可能在機器人策略學習過程中帶來副作用。

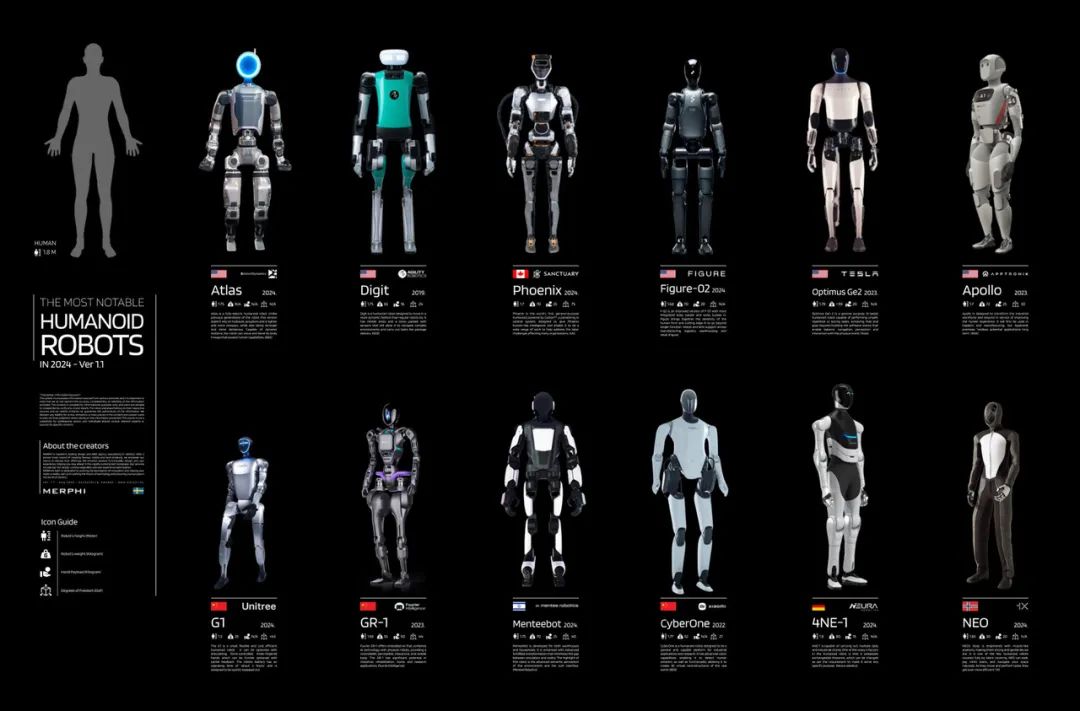

△

△GoogleDeepMind的Open X-Embodiment

又比如史丹福、UC伯克利、Google等構建的DROID數據集,涵蓋了相對豐富的場景與技能,雖然儘可能實現規範化的數據採集流程。

但作者團隊自己在後續研究中指出,DROID存在大量低質量數據,反而讓機器人越學越迷茫。

2024年以來,具身智能備受矚目,行業玩家紛紛湧現,很多初創公司都基於自採集的大規模高質量雙臂機器人數據訓練的模型展現出了整理、分揀、洗衣等執行複雜動作的能力。

這雖然進一步印證了高質量數據在當前具身智能領域研究階段的重要性,但這類數據集一般僅作自用。

據介紹,相比於Open X-Embodiment數據集,此次開源的AgiBot World長程數據規模高出10倍,場景範圍覆蓋面擴大100倍,數據質量從實驗室級上升到工業級標準。

一起來看看,這個數據集包含了些什麼——

日常生活中多樣化任務,可多機器人協作

官方資料顯示,AgiBot World數據集收錄了80餘種日常生活中的多樣化技能。

從抓取、放置、推、拉等基礎操作,到攪拌、摺疊、熨燙等精細長程、雙臂協同複雜交互,幾乎涵蓋了日常生活所需的絕大多數動作需求。

下面舉幾個栗子~

毫米級精細控制。

演示場景為插內存條。需要如神經纖維般靈敏的末端觸覺傳感器助力機器人精準對接,稍有不慎可能導致設備損壞。

繁瑣長流程家務整理。

該任務下演示場景1為整理洗碗機。

畫面中,勺筷碗盤層層堆疊在洗碗池里。在這條數據中,機器人將雜亂的餐具逐一整理到洗碗機相應卡槽中。

該任務下演示場景2為掛式熨燙衣物。

機器人通過雙手協作,一隻手抓住襯衫的一角,另一隻手控制掛燙機與衣物的距離,熨燙衣物褶皺。

搭建物體搬運。

搬運大件物體這項任務,目前對單機器人來說是個老大難。

數據集中採集的是雙機器人協作,分擔重量的同時,通過實時調整位置與角度,確保物體搬運過程中的穩定安全。

儘可能覆蓋日常生產、生活全域場景

團隊介紹,AgiBot World是從智元機器人自建的大規模數據採集工廠與應用實驗基地中採集的,採集空間總面積超過4000平方米,包含3000多種真實物品。

為了儘可能覆蓋機器人在生產、生活中的典型應用需求,為機器人提供高度真實的生產生活環境,採集環境包含超過100種真實場景、3000多種物品。

其中,80%的任務為長程任務,時長集中在60s-150s之間,且涵蓋多個原子技能,是DROID和OpenX-Embodiment工作的5倍。

值得一提的是,按照日常生活真實需求,團隊主要複刻了5個核心場景,分別是:

家居(40%)、餐飲(20%)、工業(20%)、商超(10%)和辦公(10%)。

主打的就是通過多場景的高度還原與任務設計,為機器人研發和測試構建一個能夠實現具身智能的必要條件。

首先,家居場景。

主要再現真實住宅佈局,包括臥室、客廳、廚房、衛生間等核心空間。有助於訓練機器人家務清潔、物品整理和廚房任務等。

在客廳,機器人可以精確控制機械臂抓取花材,精確定位花瓶的插孔,將花朵按計劃插入適當位置。

也可以使用清掃工具對地面進行全面清潔,包括碎屑、灰塵和液體等。

還可以清理家居表面的灰塵和汙垢,精確控制撢子或軟布進行擦拭,避免劃傷表面。

讓我們把視線從客廳轉換到廚房。

在廚房,機器人可以根據食材種類和沙拉配方,完成切割、混合和裝盤操作,也可以控制清潔工具對瓶內外進行刷洗,去除汙漬。

如果再把場景切換到衛生間,機器人可以精準控制機械臂使用刷子清潔衛生間馬桶。

其次,餐飲場景。

主要實現智能服務體驗,模擬前廳、後廚與用餐區域,包括點餐檯、備餐區、餐桌等。有助於訓練機器人實現餐廳服務(點餐、上菜、清理餐桌)、食材傳遞、後廚協作等。

再者,工業場景。

主要模擬分揀與物流自動化,複刻工業倉庫與生產線,包括分揀系統、打包設備、傳輸帶等。有助於訓練機器人實現物料分揀、包裝打包、物流搬運等。

在工廠,機器人在流水線上利用機械臂精準控制將物品放入指定的包裝盒中,實現物品自動打包。

還有商超場景。

這一場景下,主要高度還原超市貨架佈局與收銀區設計,包含生鮮、日用、雪藏等多個品類區域。有助於訓練機器人模擬物品上架、貨物盤點、顧客引導、無人結算等。

在超市,機器人可以精準控制掃碼槍對待結算物品進行掃瞄和幫助客人裝袋。

採集本體過硬+嚴控數據質量

上面所提到的AgiBot World的所有數據,都是由下面這款機器人採集的:

它具有以下幾個特點:

-

360°感知:8個攝像頭環繞式佈局,實時全方位感知周圍環境的動態變化。

-

靈巧操作:可配備具有6個主動自由度的靈巧手,保障動作精準且靈活,完成多種複雜操作。

-

末端精細感知:標配末端六維力傳感器,並可配備高精度視觸覺傳感器,能夠感知力的微小變化,做到「拿捏有度」。

-

高自由度:全身最高32個自由度,應對洗衣、做飯、分揀、搬運等複雜任務。

此外,由於AgiBot World的超大規模真實數據特性,團隊通過專業培訓、多級質量把控、全程人工在環,以確保嚴格精細化控制數據質量。

在任務設計環節,AgiBot World從設計初稿到設計迭代流程,均邀請了學術、工業、消費者來進行多視角任務把關。

在數據採集環節,由管理體系下的專業管理圖那對來保障採集員培訓和採集質量把控。

在審核標註環節,首先會經過端雲兩側,嚴格篩選採集的數據,自動剔除不符合要求的數據。

此外專業審核員會人工對全量數據進行逐幀審核,確保每一個動作都符合任務標準,並對關鍵幀和數據特性進行多維度標註。

在算法驗證環節,通過人工審核的數據,還會由AgiBot World團隊進一步通過算法進行驗證。

對於未能通過驗證的數據,會重新設計任務進行數據補采,確保數據可用性。

One More Thing

這次開源AgiBot World數據集,是稚暉君在三個月內的第三次開源舉動。

第一次是9月底,開源了專為具身智能打造的輕量化、高性能通信框架AimRT。

上一次是10月24日(沒錯就是踩點1024),智元人形機器人靈犀X1全套資料全球開源,包括設計圖紙和代碼。

至於下一步——

量子位得來的消息是,開源,開源,還是開源(莫不是稚暉君想做源神)。

內幕消息一併放在這裏,大家就等著他慢慢慢慢慢慢填坑吧,真的(真誠臉.jpg)。

-

百萬真機全量數據將陸續開源;

-

千萬仿真數據同步推送,支持更泛化和更通用的大模型訓練;

-

發佈具身基座大模型,支持模型微調,賦能千行百業;

-

發佈全套工具鏈,實現採集、訓練和評測完美閉環;

-

舉辦一系列AgiBot World Challenge。

GitHub鏈接:

https://github.com/OpenDriveLab/AgiBot-World

抱抱臉鏈接:

https://huggingface.co/agibot-world

項目主頁:

https://agibot-world.com/