遷移DeepSeek-R1同款算法,小米讓7B模型登頂音頻理解推斷MMAU榜單

允中 發自 凹非寺

量子位 | 公眾號 QbitAI

7B小模型+3.8萬條訓練數據,就能讓音頻理解和推斷評測基準MMAU榜單王座易主?

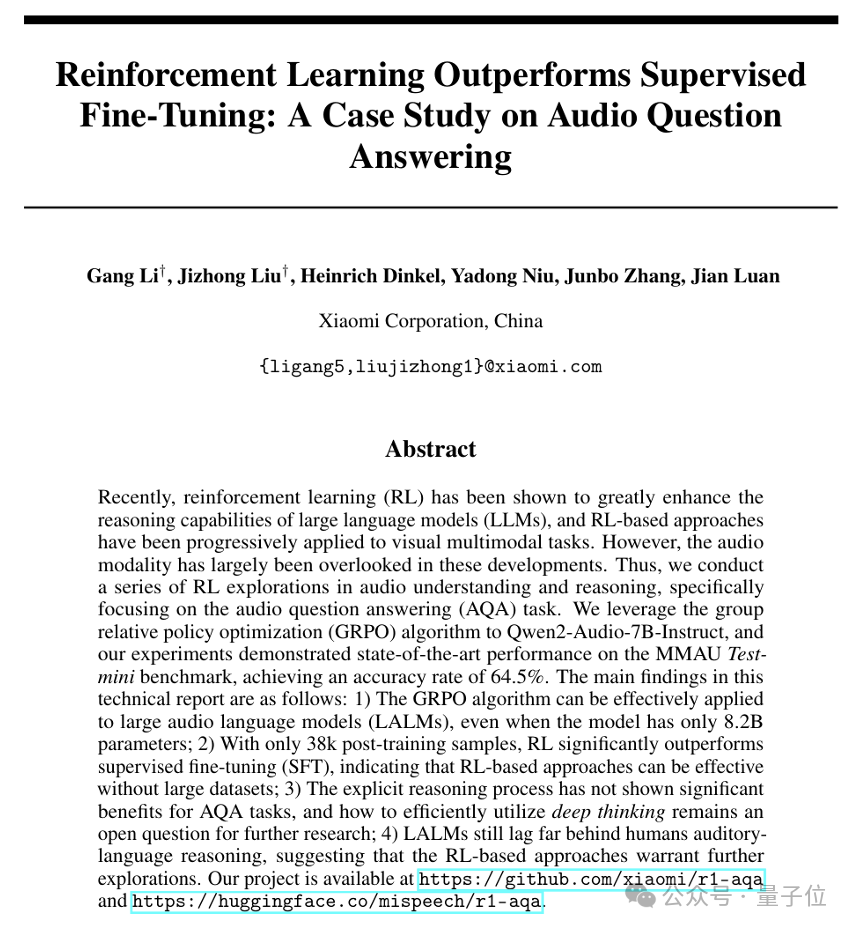

受到DeepSeek-R1中強化學習算法的啟發,小米大模型團隊對阿里的Qwen2-Audio-7B模型進行了微調。

結果模型在MMAU上的準確率從49.2%提升到了64.5%(漲幅31%),比以前霸榜的GPT-4o還高出近10個百分點。

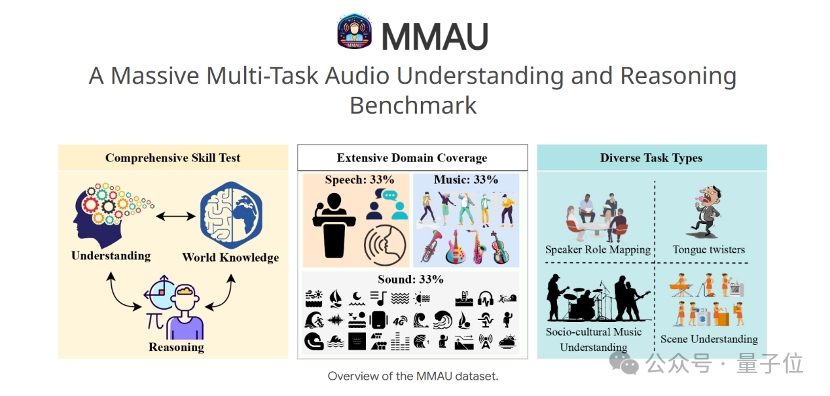

MMAU是一個由一萬條涵蓋語音、環境聲和音樂的音頻樣本構成的評測基準,難度非常高,人類專家的成績為82.2%。

來自阿里的Qwen2-Audio-7B模型在此評測集上的準確率為49.2%,經小米大模型團隊用清華大學發佈的AVQA數據集,使用SFT微調後提升到了51.8%。

這樣的提升並不明顯,而當小米團隊選擇改用DeepSeek-R1的GRPO算法時,發現獲得了巨大的性能提升,一舉達到了MMAU的新SOTA。

目前,小米大模型團隊已經把訓練代碼、模型參數開源,並提供了技術報告、在線Demo。

7B小模型拿下MMAU榜單SOTA

如前所述,小米大模型團隊通過SFT,使用清華AVQA數據集對選擇了來自阿里的Qwen2-Audio-7B進行了微調,成績提升了2.6個百分點。

直到DeepSeek-R1的發佈,為小米在該項任務上的研究帶來了啟發。

DeepSeek-R1的Group Relative Policy Optimization(GRPO)方法,讓模型僅通過」試錯-獎勵」機制就能使自主進化,湧現出類似人類的反思、多步驗證等推理能力。

在同一時間,卡內基梅隆大學發佈的預印本論文(arxiv:2503.01067),通過精巧的實驗得出了一個有趣的論斷:

當任務存在明顯的生成-驗證差距(Generation-Verification Gap),即任務生成結果的難度遠大於驗證結果正確性的難度時,強化學習比起有監督微調具有獨特優勢。

而AQA任務,恰好是完美的生成-驗證差距顯著的任務。

離線微調方法,如SFT,有點像背題庫,你只能根據已有的題目和答案訓練,但遇到新題可能不會做;

而強化學習方法,如GRPO,像老師在要求你多想幾個答案,然後老師告訴你哪一個答案好,讓你主動思考,激發出自身的能力,而不是被「填鴨式」教學。

當然,如果訓練量足夠,比如有學生願意花很多年的時間來死記硬背題庫,也許最終也能達到不錯的效果,但效率太低,浪費太多時間。

而主動思考,更容易快速地達到舉一反三的效果。強化學習的實時反饋可能會幫助模型更快鎖定高質量答案的分佈區域,而離線方法需要遍曆整個可能性空間,效率要低得多。

基於上述洞察,小米嘗試將DeepSeek-R1的GRPO算法遷移到Qwen2-Audio-7B模型上。

令人驚喜的是,在僅使用AVQA的3.8萬條訓練樣本的情況下,強化學習微調後的模型在MMAU評測集上實現了64.5%的準確率,這一成績比目前榜單上第一名的商業閉源模型GPT-4o有近10個百分點的優勢。

有趣的是,如果在訓練中強製要求模型輸出包含thinking標籤的推理過程時,準確率反而下降至61.1%。這說明顯式的思維鏈結果輸出可能並不利於模型的訓練。

小米大模型團隊的實驗揭示了幾個和傳統認知不同的結論:

-

關於微調方法:強化學習在3.8萬條數據集上的表現,顯著超過監督學習在57萬條數據集上的結果;

-

關於參數規模:相比千億級模型,7B參數的模型通過強化學習也可展現強推理能力;

-

關於隱式推理:顯式思維鏈輸出反而成為性能瓶頸。

儘管當前準確率已突破64%,但距離人類專家82%的水平仍有差距。

小米大模型團隊表示,在當前的實驗中,強化學習策略還是比較粗糙,訓練過程對思維鏈的引導並不充分,我們會在後續做進一步探索。

此次實驗驗證了強化學習在音頻理解和判斷領域的獨特價值,也為後續研究打開了一扇新的大門。

小米團隊期待,當機器不僅能「聽見」聲音,還能「聽懂」聲音背後的因果邏輯時,真正的智能聽覺時代將會來臨。

人類專家準確率82.23%

MMAU(Massive Multi-Task Audio Understanding and Reasoning)評測集由美國馬里蘭大學和Adobe的研究人員於去年聯合提出,是音頻理解和推斷能力的量化標尺。

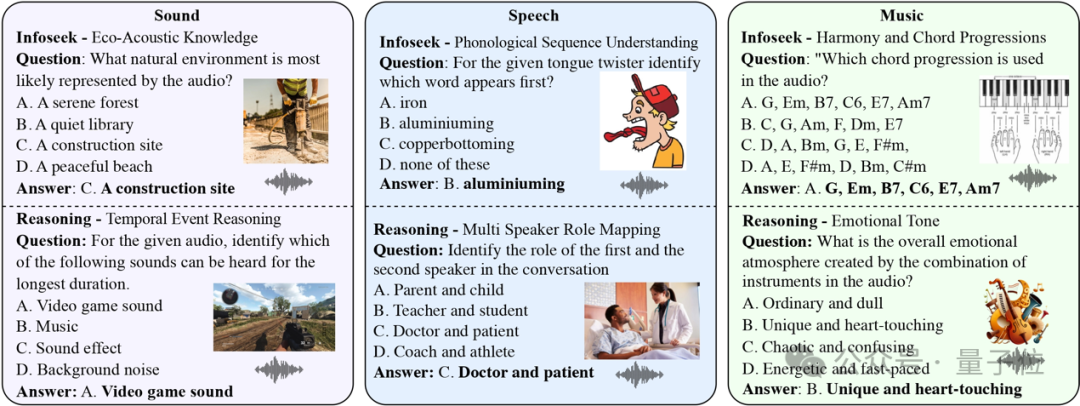

它通過一萬條涵蓋語音、環境聲和音樂的音頻樣本,結合人類專家標註的問答對,測試模型在27種技能,如跨場景推理、專業知識等應用上的表現,期望模型達到接近人類專家的邏輯分析水平。

-

面對一段汽車行駛中的座艙錄音,AI 能否判斷出汽車是否存在潛在的故障?

-

在交響樂演出現場,AI 能否推測出作曲家創造這首音樂時的心情?

-

在早高峰地鐵站混亂的腳步聲潮中,AI 能否預判閘機口可能發生的衝撞風險?

在大模型時代,人們已經不滿足於機器僅僅識別說話的內容、聲音的種類,更期望機器具備複雜的理解和判斷能力,MMAU衡量的就是這種能力。

這是一個很難的評測集,作為基準上限,人類專家在MMAU上的準確率為82.23%。

目前MMAU官網榜單上表現最好的模型是GPT-4o,準確率為57.3%。緊隨其後的是Google的Gemini 2.0 Flash,準確率為55.6%。

訓練代碼:

https://github.com/xiaomi-research/r1-aqa

模型參數:

https://huggingface.co/mispeech/r1-aqa

技術報告:

https://arxiv.org/abs/2503.11197

交互Demo:

http://120.48.108.147:7860/