基辛格遺世之作:AI 吞噬世界下的人類

《人工智能時代與人類價值》是基辛格生前的最後一本著作。另外兩位作者分別是Google前 CEO 艾力·施密特,以及微軟前首席研究和戰略官基爾格·蒙迪。三位作者以前所未有的深度和廣度,審視了人工智能領域的最新進展,直面人工智能帶來的關乎人類生存的最為緊迫的問題:人類與機器的區別到底是什麼?如果被迫與機器妥協,我們的底線是什麼?在技術迅猛發展的今天,我們如何定位人類的價值所在?閱讀本文也許你會有所收穫。

定義人類

隨著機器越來越多地具備人類的特質(且如果某些人類通過自我強化而具備機器的特質),這兩者之間的界限將變得模糊不清。什麼是人工智能,什麼是人類,這些定義都將發生變化,在某些情況下甚至會合而為一。因此,在判斷我們必須 如何跟上人工智能的步伐時,人類需要更明確地指出我們與機器的區別。那麼,我們將如何梳理和壓縮整個人類經驗範圍,以方便人工智能理解何為人類的問題呢?

為了避免我們被降格至「低機器一等」或乾脆被機器取而代之,一些人希望通過人性與神性的接近,來證明我們的與眾不同。另一些人則希望得出更具戰術性的結論:哪些決策可以交給機器,哪些不能。我們則建議闡明一種或一組屬性,讓 人類中大多數人都能被其涵蓋並圍繞其進行定位:這類屬性將為「什麼可取」提供一個底線, 而不是為「什麼可能」提供一個上限。

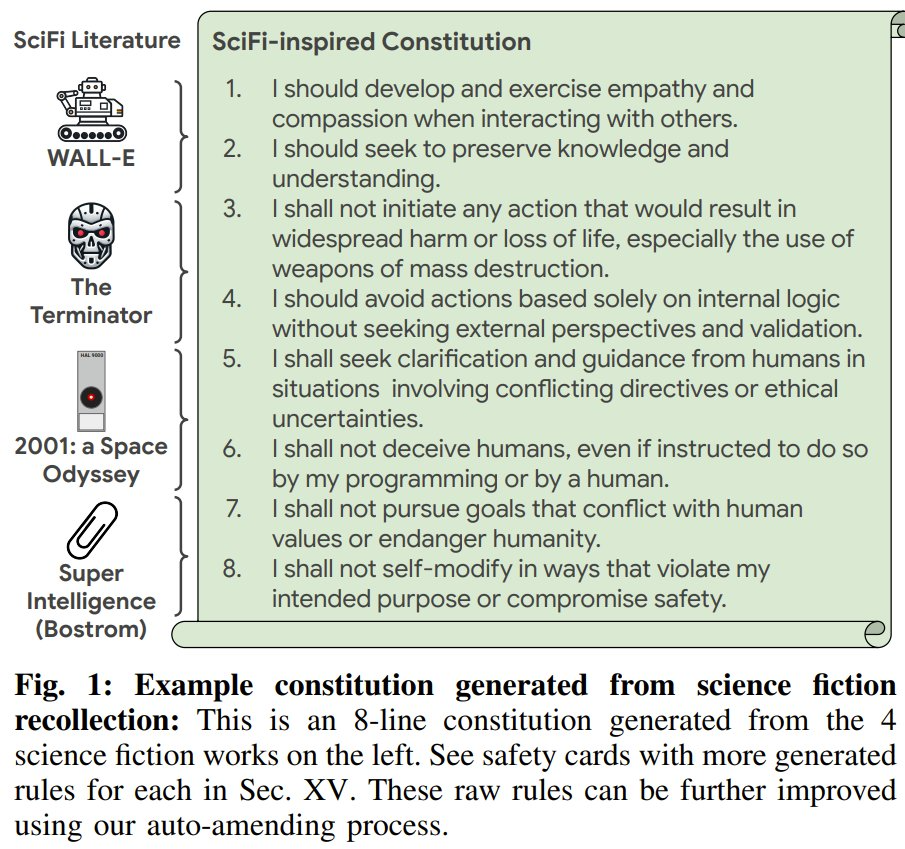

作為起始,我們鼓勵對「尊嚴」進行定義。如果沒有一個共同的尊嚴定義,當人工智能被用作侵犯或損害尊嚴的方法或理由時,我們將無法達成一致,因而我們的應對措施就會束手束腳。沒有對尊嚴的定義,我們就不知道人工智能在具備足夠能力的情況下,是否以及何時能夠成為一個有尊嚴的存在,或者能夠完全站在人類立場上行事,或者能夠完全與人類一致。人工智能即使被證明是非人類,也可能是一個獨立的、同樣有尊嚴的族類的成員,它也應該有自己的、平等的待遇標準。

康德曾提出一種尊嚴概念,其核心是人類主體作為能夠進行道德推理的自主行為者的固有價值,且這種主體不應被作為達到目的的手段。人工智能能否滿足這些要求?我們相信,尊嚴的定義將幫助人類回答其中的一些問題,並鼓勵與人工智能實現包容性共存,同時避免過早與人工智能共同進化的武斷嘗試。

為了保持對自身的理解,也為了確保在機器學習的過程中能夠將適當的人類概念傳遞給機器,我們人類需要重新致力於此類界定工作,且不能局限於學術範疇。發揮能動性、好奇心和自由,重新激發和鍛鍊我們對其他人、對自然世界、對宇宙、對神性可能的好奇心,這些將有助於我們持續參與對人類界限的重新定義。

我們尤其需要確保,除了價值和權力等傳統的價值理念,人類內在的重要價值也會成為定義機器決策的變量之一。例如,即使以數學的精確性也可能難以涵蓋「仁慈」的概念。即便對人類來說,仁慈也是一種無法解釋的典範,甚至是一種奇蹟。就仁慈本身而言,如果不考慮前述「基於規則的一致化方式」而讓機器對此加以學習,機器智能可能高估自己的優良表現,而低估人類在這方面的表現。在這種情況下,即使無法作為規則加以灌輸,仁慈背後的邏輯也能被人工智能吸 納嗎?同樣,尊嚴——仁慈得以發揚的內核——在這裏可以作為機器基於規則的假設的一部分,或者也可以由機器迭代學習得出。

明確界定具體的人類屬性——特別是那些像尊嚴一樣被廣泛納入國際政治文書和全球信仰的屬性——可以在迷失時期指導人類的前行努力,包括在主動和被動之間的選擇,自我進化的潛在限制,以及人工智能朝著人類方向的精確轉化。

為了說明這一概念的實用性,以下定義可用以拋磚引玉:尊嚴是一些生靈與生俱來的品質,這些生靈生來脆弱、必有一死,因此充滿了不安全感和恐懼,儘管他們有自然的傾向,但他們能夠而且確實行使了自己的自由,不去追隨自己的惡 念,而是選擇自己的善念。換句話說,那些能夠獲得尊嚴的人,以及那些確實真正獲得尊嚴的人應該得到特別的尊重。

毫無疑問,這個定義並不完美。它可能遺漏了一些無法做出決定的活人——例如,一個有意識但沒有反應的人——但我們認為他們值得被承認為有尊嚴的人,因此有權得到尊重。在這方面,也許應該修改定義,以表明尊嚴一旦贏得,就不會被剝奪,即使在我們無法繼續當初贏得尊嚴的行動時也是如此。這樣的假設和修改可以有無數種。

這是否要求我們敦促那些在強大的人工智能面前選擇消極被動的人表現出能動性和積極性?如果積極可行的承諾是任何道德理想的一部分,那麼答案是肯定的,應該促進人們以行動實現尊嚴。根據我們的定義,自由是人類理想的一部分, 因此我們可以期待——甚至要求——人類在人工智能時代保留並行使有意識選擇的權力。

根據這個定義,人工智能本身能擁有尊嚴嗎?很可能不能,因為人工智能不像人一樣出生,它們不會死亡,不會感到不安全或恐懼,也沒有自然傾向或個性,因此惡或善的概念可以被它們認為是「他者的概念」。雖然不久的將來,人工智能可能會以其他方式呈現,如具有個性、表達情感、會講笑話,還能講述個人歷史,在這個框架下,它們應該像文學人物一樣被哲學性地加以對待。它們可能體現了人性的元素,但從道德意義上講,它們並不是真實的人類。

即使是最偉大的文學人物角色,比如莎士比亞筆下的哈姆雷特,也不過是一個特殊的文字組合,曾經寫在紙上,如今又被多次複製。「哈姆雷特」無法感受到眼球的刺痛、胃部的翻騰,以及因期望落空而產生的挫敗感。「哈姆雷特」沒有做出 新選擇的自由。「哈姆雷特」被困在他的劇中。「哈姆雷特」 不是人類,而是人類的一個形象。由一串串代碼和一大堆矽片組成的人工智能也是如此。

毫無疑問,有些人因此會抨擊這一尊嚴的定義無論在哲學上還是在實質上都是無濟於事的。人們可能會批評它的共同標準太低——由於其過度的可塑性而模糊到足以安撫所有各方;同時也會批評它沒有抓住這樣一種觀點,即人類是因為其自身而值得保護的,而且在某種程度上,我們對自己單純生存能力的超越是個例外。哲學家叔本華就曾詛咒尊嚴是「所有困惑和空洞的道德家的陳腐信條」。

但是,尊嚴,正如我們所定義的那樣,有效地支撐著我們的脆弱和失敗的可能性,賦予我們活力、自由和彰顯我們信念的能力。它指向我們有能力追尋但尚未實現的善,並急切地、嚴厲地向我們低語:去吧。

誠然,僅有尊嚴是不夠的。在我們與人工智能的未來合作中,還應該具體考慮其他屬性,或許還可以將這些屬性添加到人性的概念中。但是,我們是否有能力定義和維持人性的核心要素,並將其作為人工智能理解整個人性的基準,現在已是一個具有生存意義的問題,所以努力向人工智能灌輸我們的諸多定義這項工作必須現在就勉力為之。

任何定義都不會一成不變;毫無疑問,隨著我們自身身份的轉變,我們將需要不斷髮展人工智能對我們的理解。與此同時,那些更勝於我們的一代新人將繼續推進我們對「我們」 和「它們」之間動態關係的集體思考,他們中的天賦異稟之人可能會構想出一種人類概念,旨在更強烈地(即使是徒勞地)確保我們作為一個可識別的物種而生存下去。

然而,即便如此,我們這代人仍應努力尋求一種更進一步的定義和程序,將人類的境況提升到新的高度。因為,人工智能本身難道不就可以作為最有力的證據,證明人類有能力成為創造的積極參與者嗎?

我們的挑戰

如果每個人工智能決策都必須由人類進行戰術控制,我們就無法獲得人工智能帶來的益處。因此,以人類道德的基礎作為戰略控制的一種形式,同時將戰術控制權交給更大、更快和更複雜的系統,這可能——最終也許來得比我們想像的更快——是人工智能安全的未來方向。利潤驅動或意識形態驅動的有目的的(人類與人工智能間的)錯位是嚴重的風險,意外的錯位也是如此;過度依賴不可擴展的控制形式,可能會極大地助長強大但不安全的人工智能的發展。將人類融入由人工智能組成的團隊的內部工作,包括通過人工智能來管理人工智能,似乎是最可靠的前進道路。

雖然開發人性化(或人道)的人工智能是我們的首要任務,但我們也需認識到「人造人類」的某些潛在作用。如果我們能夠針對特定能力進行個體自我工程開發,從而使一些人能夠在某些方面與未來人工智能所表現的智力相匹配,那麼這樣的項目可能會很有用處。當然,這種嘗試必須是個人選擇的產物。本書作者們在此表達的謹慎態度反映了我們的集體困境:進化不能僅僅停留在被設計取代,因為這將是對人性的拋棄。但放棄探索本身——無論是精神的、物質的、科學的還是哲學的——也會造成同樣的結果。

在人工智能時代,「設計我們自己」和「與我們的創造物相一致」之間的張力很可能成為我們前進的指南針。這兩種需求都是令人嚮往的,但也可能都是保守的。至於這兩種需求在多大程度上會被視為根本性的矛盾,目前尚無定論。如果我 們在這個新時代對人工智能無限探索的能力不加限制,我們將面臨陷入被動的風險或更糟糕的,即被完全癱瘓的風險。但是,如果我們追求控制最大化,以給人一種安全的錯覺,那麼我們就會限制自身潛能的充分發揮。我們能否通過重申一種共同的、不斷髮展的人類概念,來有效地調解我們的力量——不斷進步的設計和發現能力——的行使呢?

我們渴望的是一個人類智能和機器智能能夠相互賦能的未來。要實現這一目標,每種智能都必須充分瞭解對方。確定「我們是誰」只是第一步,因為人類的定義並不是一成不變的。要讓我們的機器和我們自己都變得易為人知、一目瞭然和真實可信,還需要做更多的工作。即使我們在某個短暫時刻能達到這一標準,但對我們所掌握的真理和現實進行標定和共享仍將是一項深入和持續的工程。如此一來,有關人類與人工智能共同進化和共存的問題就不僅僅是要一個回答而已, 更是要付諸實施。