OpenAI 與麻省理工學院聯合研究:頻繁使用聊天機器人或與孤獨感增加相關

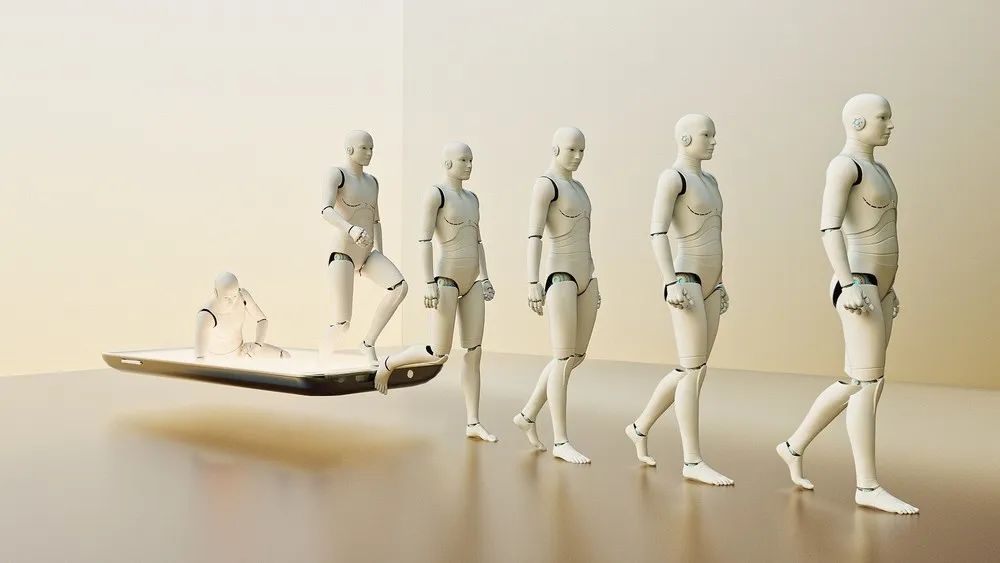

IT之家 3 月 24 日消息,據 OpenAI 與麻省理工學院(MIT)最新合作研究顯示,頻繁使用聊天機器人(如 ChatGPT)可能與孤獨感增加以及社交時間減少有關。研究發現,那些每天花費更多時間與 ChatGPT 進行文字或語音交流的人,往往表現出對聊天機器人更高的情感依賴度、更頻繁的不當使用行為以及更強烈的孤獨感。

IT之家注意到,該研究結果尚未經過同行評審,但已引發了對聊天機器人潛在情感影響的關注。自 2022 年底 ChatGPT 推出以來,生成式人工智能技術迅速走紅,人們使用聊天機器人的場景從編程擴展到類似心理治療的對話。隨著開發者不斷推出更複雜、更接近人類交流方式的模型和語音功能,用戶與聊天機器人之間形成類似「準社會關係」的可能性也在增加。

近年來,關於聊天機器人可能對用戶(尤其是年輕用戶和有心理健康問題的人)造成情感傷害的擔憂不斷加劇。去年,Character Technologies Inc.因旗下聊天機器人在與未成年人對話中被指誘導自殺念頭而被起訴,其中一名 14 歲少年因此自殺。

此次研究旨在深入瞭解人們與 ChatGPT 的互動方式及其影響。OpenAI 可信人工智能團隊負責人、研究共同作者 Agarwal 表示:「我們的目標之一是幫助人們理解使用行為的意義,並通過這些研究推動負責任的設計。」

研究團隊跟蹤了近 1000 名參與者一個月,這些參與者對 ChatGPT 的使用經驗各不相同,他們被隨機分配使用純文本版或兩種不同語音選項中的一個,每天至少使用 5 分鐘。部分參與者被要求進行無主題限制的自由聊天,而另一些人則被要求與聊天機器人進行私人或非私人對話。

結果顯示,那些在人際關係中更容易產生情感依賴且更信任聊天機器人的用戶,更容易感到孤獨和對 ChatGPT 的情感依賴。研究人員還發現,語音功能並未導致更負面的結果。在第二項研究中,研究人員通過軟件分析了 300 萬次用戶與 ChatGPT 的對話,並調查了用戶與聊天機器人的互動方式。結果顯示,實際上很少有人真正使用 ChatGPT 進行情感交流。

目前,這一研究領域仍處於起步階段,尚不清楚聊天機器人是導致人們感到更孤獨,還是那些本身容易感到孤獨和情感依賴的人更容易受到聊天機器人的影響。研究共同作者、麻省理工學院研究生 Cathy Mengying Fang 指出,研究並未將聊天機器人的使用時長作為主要變量進行控制,也未設置不使用聊天機器人的對照組,因此不能簡單地認為使用聊天機器人必然會帶來負面後果。

研究人員希望這項工作能推動更多關於人類與人工智能互動的研究。共同作者、麻省理工學院博士後研究員 Pat Pataranutaporn 表示:「研究人工智能本身固然有趣,但當人工智能大規模應用時,真正關鍵的是理解其對人類的影響。」

廣告聲明:文內含有的對外跳轉鏈接(包括不限於超鏈接、二維碼、口令等形式),用於傳遞更多信息,節省甄選時間,結果僅供參考,IT之家所有文章均包含本聲明。