人機協同時代的版權困局:人工智能版權治理與創新研討會深度解析

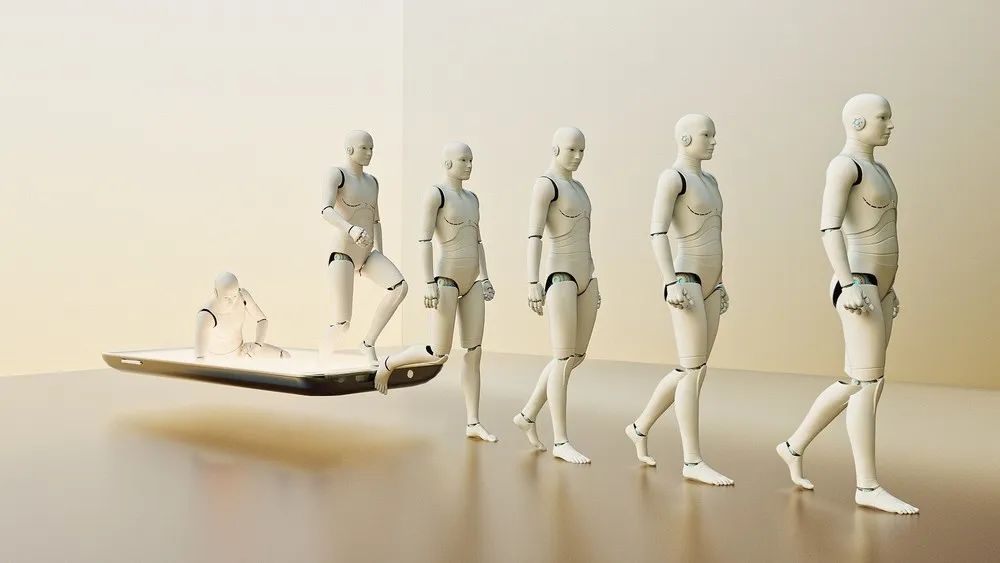

隨著人工智能大模型技術的發展,越來越多用戶在工作生活中利用各類AI工具,提升了效率。人機交互過程中,一些問題受到關注——用戶輸入內容是否可用於訓練AI或「模型優化」?AI生成內容的著作權該歸屬於誰?如何看待AI產品和行業的未來發展?

3月21日,中國政法大學民商經濟法學院民法研究所、走出去智庫、《互聯網法律評論》聯合主辦「人工智能版權前沿問題」研討會,來自法學、經濟學、公共政策等領域專家學者就相關問題進行了研討。

一、人機交互應注重隱私保護,數據訓練則需各方聯合構建更好生態

針對當前用戶與AI軟件間的交互,與會專家學者均強調了保護用戶個人隱私的重要性,但也指出高質量數據對模型訓練的巨大價值,用戶更負責任地使用大模型有著重要意義。

中國政法大學比較法學研究院劉文傑教授表示,用戶為讓AI更好回答問題,相關提示詞可能涉及個人信息。根據《個人信息保護法》,信息輸入後,如果服務商想要儲存、再加工,需要明示用戶並徵求其同意。關於敏感個人信息,我國法律還有「一事一議」的特殊規定,即處理敏感個人信息不能採用概括同意或推定同意的授權模式,而必須獲得個人明確的、單獨的同意。

中國人民大學法學院姚歡慶副教授進一步提出,由於個人用戶對數據價值的認知和技術公司的利用能力往往不對等,當前「用戶同意」機制仍有待完善,涉及個人隱私的「知情同意」應做到明白、清楚、仔細。近期受到關注的「開盒」行為,是通過不同數據庫彙集和碰撞,利用看似不重要的信息反向拚圖推導出個人信息。相關操作明顯違法,應從整體社會規範角度進行處罰和管理。

北京理工大學智能科技法律研究中心王磊研究員就此指出,大型平台企業的數據利用大多合法合規,但黑灰產對大數據的非法運用十分猖獗。須通過政府監管、技術平台和社會多方形成合力打擊黑灰產。他並指出當前高質量數據的結構性匱乏已成為製約大模型發展的瓶頸,尤以醫療、交通、金融等領域為代表。

針對當前模型訓練的數據訴求,與會專家討論指出,由於模型優化有時缺乏常識和判斷邏輯,而是基於用戶反饋,當不斷持續喂料錯誤觀點和結論,模型將可能賦予錯誤內容更優先權重。此外,數據標註環節若由非專業人員完成,標註錯誤往往引發「汙染數據」,進而導致模型輸出出現「幻覺」。對此,必須構建良好的生態系統,其中,用戶負責任地使用模型也是重要一環,應讓數據持有方、技術開發者和社會公眾形成多方共贏。

二、AI生成內容要看到人與智能體的共同貢獻

當前,隨著AI技術的不斷髮展,通過簡單提示詞則可得到內容充實的文字、圖片甚至影片,相關生成內容正更多走進社會工作和生活中的方方面面。這些內容是否涉及權屬爭議、是否受到版權保護,也成為近年來各界關注焦點。

中國政法大學民商經濟法學院郝明英講師指出,中國現有判例表明,如用戶在提示輸入、結果篩選等環節體現「獨創性勞動」,即認定生成內容受版權保護。這與日本文化廳最新意見相近,強調「人類創作性貢獻」的核心地位,「指令的具體性」是影響認定的因素之一。

劉文傑則指出,當前司法實踐中對AI生成內容場景中用戶「作者」身份的判定其實不同於傳統著作權法理論。以北京互聯網法院「文生圖」判決為例,法院雖認可用戶對AI生成圖片的著作權,卻要求該用戶標註「所使用的由AI技術」,這實質上說明用戶與著作權上的 「作者」並不完全等同。用戶以提示詞觸發模型運行,最終表達由模型輸出,此時用戶貢獻更接近於操作工具者或「製作者」,而非「創作者」。

而針對生成內容的權屬問題,郝明英認為,無約定時應歸屬於人工智能的使用者,並強調權利義務和責任「應當相適應」。即人工智能生成內容如若構成作品,且權利歸屬於用戶,發生侵權時,平台是否需要承擔責任,需主要考慮其注意義務的邊界。劉文傑也認為,如果人工智能生成內容受《著作權法》保護,就存在責任區分問題。只有承認生成內容相當程度上來自於平台運營的人工智能模型,才能要求平台承擔責任。

國研新經濟研究院創始院長朱克力則指出,經濟學強調「成本—收益」邏輯。工業時代,創作者投入大量時間、智力等成本,所以其著作權受法律保護以便獲得收益;但在人工智能時代,用戶進行文字、圖片等產出的投入成本明顯降低。當輸入幾個詞就能獲得成果時,投入成本與工業時代相比微不足道。技術平台提供的應用大幅降低大家的投入成本,相關產品具有普惠性,需在此基礎上探討權益問題。

王磊也表示,要用發展的眼光看待《著作權法》相關問題。以服裝類電商為例,文生圖、圖生影片等,已成為服裝廣告片的高效生產依託。同樣一件衣服作為商品,可根據全球不同目標市場,快速生成不同膚色人種的試穿效果圖。當法學界還在討論版權問題時,國內外業界已大步前進。人工智能的發展和應用豐富了數字經濟,在公共領域有益於產業發展。

針對AI在內容生成,尤其文藝創作等領域帶來的巨大變革乃至衝擊,姚歡慶則呼籲建立「人機創作雙軌製」,以維護人類創作的主體性。他以攝影技術對繪畫藝術的衝擊為歷史鏡鑒,指出當AI能高效生成內容時,人類需尋找主體意義的創作動力。他強調對AI生成內容進行明確標註的意義,並建議通過市場機制賦予人類作品溢價,通過堅守人類主體性,避免人類在智能時代淪為技術附庸。

對此,朱克力從經濟學和未來學結合的跨學科視角,表示AI技術能幾乎無限生成符合市場需求的文本、圖像甚至影片時,同質化內容的價值將越來越低。以目前國家政策提倡的「正選經濟」為參照,未來相關創作的稀缺性將轉向正選性、獨創性、差異化。富有企業家精神、科學精神的人將比一般匠人更具創造力,「知識首位效應」仍為人類提供了充分的創新激勵空間。

三、人工智能產業方興未艾,法律應以審慎包容和鼓勵發展為主基調

今年以來,中國AI產業應用正加速前進,為經濟社會發展帶來了新的增長動能。政府工作報告也繼去年以來,再提推動「人工智能+」行動。與會專家共同表達了法律應以探索包容和鼓勵發展為主基調的呼籲,以支持人工智能行業發展。

劉文傑指出,人工智能技術發展不斷突破,對應用場景、人類生活和國際競爭的影響尚難預測,因此不宜急於立法。目前全國人大尚無《人工智能法》立法的明確時間表。當前,我國行政主管部門通過規章、規範性文件等多種方式對人工智能產業進行監管,可根據實際情況及時調整監管力度,其靈活性有利於產業發展,相較於通過一部法律解決所有問題的設想更切合實際。他認為應採用相對包容的監管方式,以提倡、促進為主,讓市場發揮檢驗作用,在不侵害人的基本權利的前提下,鼓勵產業發展。但對於可能對人的基本權利造成重大傷害風險的應用,必須審慎進行安全評估。

王磊提出兩點對更適合現階段AI監管政策的觀察。一是「小步快跑」——就個人信息保護、生成式人工智能、深度合成偽造等具體問題,相關主管部門以敏捷治理方式給出監管要求,如十條到二十條左右的規定,具有很強針對性和靈活性。二是,「讓子彈飛一會兒」——以共享經濟為例,在討論共享經濟要不要立法的過程中,共享經濟就已經不具備立法規製相應的規模了。這說明市場有自我糾偏能力,要兼顧考慮法律框架,也要充分發揮產業和市場的力量。

郝明英指出,應從兩個角度看待「技術中立」。一是,人工智能技術發展本身是中立的,沒有好與壞。因此對於平台而言,需考慮其責任和義務的有限邊界。二是,更重要的在於我們要中立地去看待技術,不應對技術有偏見或者歧視。

四、國際競爭視角下,中國AI發展更要走出自身特色道路

從2023年底ChatGPT橫空出世,到今年春節DeepSeek出圈,中美數字科技領域博弈愈加激烈。當前歐美正通過「數據主權」與「知識產權聯盟」強化技術壁壘,AI版權等前沿問題已不僅是法律問題,更是戰略問題。本次與會專家均認為,中國AI發展和治理需在發展與安全的動態平衡中探索漸進式解決方案,走出自身特色道路。

郝明英指出,法律是為了保障產業發展。面對未來,法律如何進行適應性調整,來保障和促進產業發展至關重要。無論人工智能、知識產權,都已成為國際競爭的抓手,甚至已經成為部分國家的武器。如此背景之下,既要從人類命運共同體角度考慮,也要有國家競爭的因素考量。在全球視角與國際競爭層面,AI發展領域須加快提出 「中國方案」、發出「中國聲音」。

朱克力也表達了相似觀點——基於國際博弈的背景,法律並非是要讓步於國際競爭,但應該試圖與國家發展進行共振、聯動,成為推動國家發展的重要力量,才會更加符合時代需求。具體而言,法律應與國家發展戰略緊密結合,通過合理的制度設計和法律規製,為科技創新和產業發展提供有力的法治保障。在人工智能領域,包括但不限於知識產權保護的法律,應關注技術的快速發展對社會經濟的影響,及時調整和完善相關法律制度,以適應新的技術環境和社會需求。

會議主持人、走出去智庫合夥人張穎也指出,歐盟《人工智能法案》立法過程前後歷經數年,期間經歷了相當多質疑。終於出台後,卻在本次巴黎AI行動峰會後,決策層卻決定近期不予執法,而是尋求促進歐盟AI技術和產業發展,相關立法完成後卻陷入可能擱置的狀態,令人十分唏噓。

姚歡慶則表示,當前人工智能也對人類帶來諸多挑戰,其中包括巨大算力需求帶來的能源消耗與環保問題。微軟2023年總碳排放比2020年高30%左右,人工智能浪潮下氣候目標或難以維繫。包括中國在內,各國都應以人為本,從人類命運共同體的角度考慮人工智能的發展,共同探索負責任的前進道路。

本文來自微信公眾號「Internet Law Review」,作者:互聯網法律評論,36氪經授權發佈。