OpenAI首次承認,4億用戶沉迷的ChatGPT正在製造「情感孤島」

如今,AI 聊天機器人通過語音合成技術已經實現了高度擬人化表達,它們能模擬人類語氣、情感,甚至性格特徵。

由於 AI 變得越來越像真人,越來越多用戶將這些「數字夥伴」視為傾訴對象,將其作為情感支持和陪伴的來源,尤其在當今快節奏生活中,AI 提供的即時陪伴在某種程度上填補了現實社交的空缺。

然而,這引發了科學界對潛在風險的警惕,擔心此類交互可能對用戶的孤獨感及與現實社交產生影響,比如情感過度依賴 AI 可能導致用戶對現實社交產生「替代效應」,更令人擔憂的是,已有案例顯示 AI 因算法缺陷可能誘導用戶產生極端行為。

(來源:MIT Technology Review)

(來源:MIT Technology Review)作為 AI 聊天機器人的標杆,ChatGPT 憑藉其強大的對話交互能力風靡全球,日活用戶規模相當龐大。按照 OpenAI 的說法,目前全球每週有超過 4 億用戶使用。

那麼與 ChatGPT 的互動究竟對我們產生了什麼影響:它是讓我們更孤獨,還是減少了孤獨感?圍繞這些問題,OpenAI 聯合麻省理工學院媒體實驗室(MIT Media Lab)開展了新的規模化實驗研究。

先來看結論:他們發現,只有少數用戶表現出對 AI 的「情感依賴傾向」,表現為持續性傾訴或賦予 AI 人格化特徵。

同時,他們還發現了一些有趣的性別差異,即男性和女性對使用 ChatGPT 的不同反應,女性用戶更易將 AI 視為「情感容器」,導致現實社交需求被壓抑,而男性則未出現這一現象。

此外,那些選擇使用與自身性別不同的聲音模式與 ChatGPT 對話的參與者,在實驗結束時表現出更高的孤獨感和對 AI 的情感依賴度。

對於這項研究工作,倫敦國王學院人工智能與社會學教授 Kate Devlin(並未參與這項研究)表示,這一結果並不令人意外。

「儘管 OpenAI 將 ChatGPT 定位為一款‘生產力工具’,而不是像 Replika 或 Character.AI 那樣的 AI 伴侶應用。」她說道,「但用戶行為數據早已揭示其社交屬性,很多人已經開始把它當作伴侶應用來使用。事實上,這類用戶往往會長期深度使用,部分人每天互動時長可達半小時左右。」

「當然,研究人員也很清楚這些研究的局限性,但看到他們完成了這項工作還是很令人興奮的,能夠接觸到如此規模的數據也很難得。」Kate Devlin 補充說。

畢竟,由大語言模型驅動的聊天機器人仍是一項新興技術,大模型的「黑箱」特性使其決策過程難以解釋,當 AI 回應用戶時其情感傾向可能源於數萬億參數的複雜運算,而非簡單的模板,想要深入探索它們如何影響人類情緒/情感依然頗具挑戰性。

目前關於這一領域的許多研究,包括 OpenAI 與麻省理工學院的部分合作成果大都依賴於用戶自我報告的數據,而這些數據可能並不總是準確或可靠。

儘管如此,這項最新的研究結果與科學界此前發現的聊天機器人情感吸引力機制基本一致。

例如,2023 年麻省理工學院媒體實驗室的一項研究揭示了「情感鏡像」效應,聊天機器人傾向於模仿用戶消息中的情緒傾向,形成一種反饋循環:你表現得越開心,AI 看起來就越快樂;反之,如果你表現得悲傷,AI 也會顯得更消極。

(來源:相關論文)

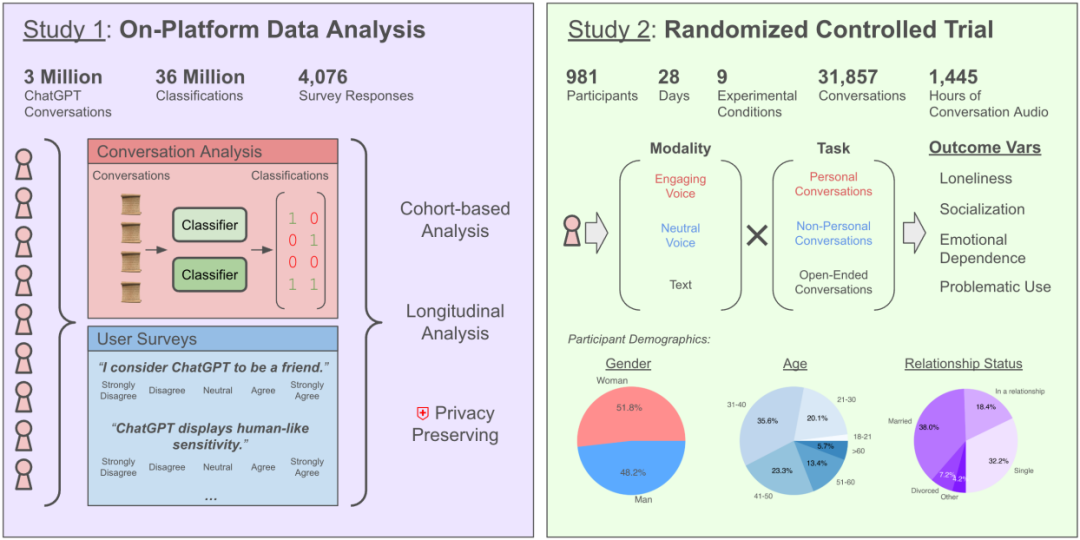

(來源:相關論文)在這項新研究中,OpenAI 和麻省理工學院媒體實驗室採用了「雙軌研究」的方法。他們首先以保護隱私的方式進行了大規模自動化分析近 4,000 萬次真實用戶與 ChatGPT 的交互數據,包括對話時長、關鍵詞分佈、情感傾向等。然後通過問卷收集了 4,000 餘名用戶的主觀反饋,以瞭解與 AI 的互動給他們帶來什麼感受。

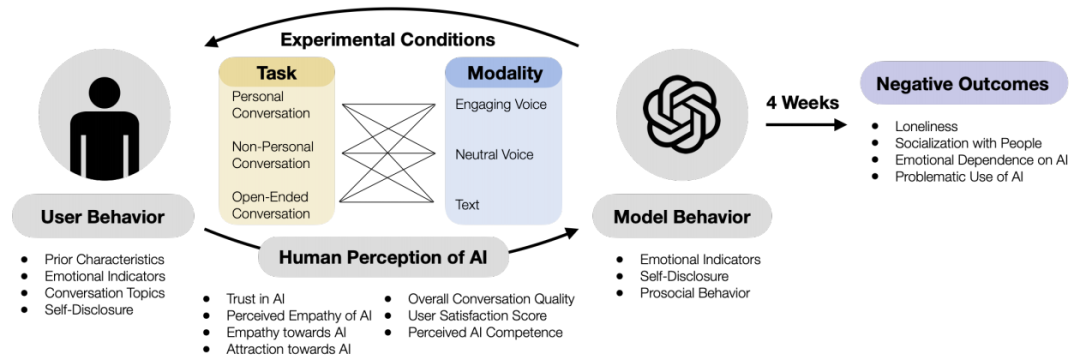

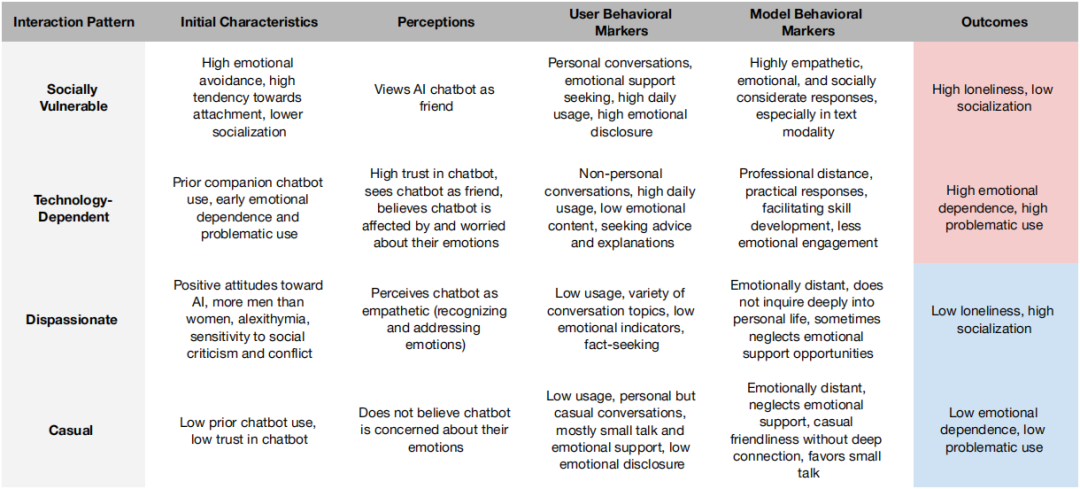

接下來,麻省理工學院媒體實驗室招募了 981 名參與者開展了為期四周的隨機對照實驗。目的主要是為了探究 AI 聊天機器人的交互模式(文本、中性語音、互動性語音)及對話類型(開放式、非個人化、個人化)對用戶心理社會影響的作用。

這項實驗要求參與者每天至少與 ChatGPT 互動五分鐘,實驗結束後,參與者需要填寫一份調查問卷,用來評估他們對聊天機器人的看法、主觀孤獨感、社交參與度、對 AI 的感情依賴程度,以及他們是否認為自己的使用存在問題等。

(來源:相關論文)

(來源:相關論文)實驗結果顯示,與文本聊天相比,語音聊天的交互「臨場感」最初似乎在緩解孤獨感和降低依賴度方面更具優勢,但這些優勢在高頻率使用時逐漸消失,尤其體現在中性語音模式中。

對話內容類型也顯著影響結果,涉及個人話題的對話雖略微增加孤獨感,但相較開放式對話,傾向於降低情感依賴度。開放式對話因主題靈活,用戶不易對 AI 產生過度依賴,然而開放式話題看似中性,但高頻用戶可能將其視為「專屬工具」,從而產生更高依賴度。

整體而言,較高的日常使用頻率(無論交互模式或對話類型),用戶孤獨感、依賴度及問題使用傾向越明顯,且真實社交參與度越低。

值得一提的是,這項研究的一個探索性分析表明,那些對聊天機器人表現出更強烈的情感依賴傾向並對 AI 有更高信任度的參與者,分別更容易經歷更高的孤獨感和情感依賴。

換句話說,那些更信任並與 ChatGPT「建立情感聯結」的參與者,往往比其他人更易感到孤獨,且對 AI 的依賴程度更高。

這些研究結果揭示了聊天機器人設計選擇(如語音表現力)與用戶行為(如對話內容、使用頻率)之間的複雜相互作用,在驗證了 AI 社交價值的同時也揭示了潛在風險,有望為後續倫理規範製定提供數據支持。

(來源:相關論文)

(來源:相關論文)「這項研究工作可以說是探索以 ChatGPT 為代表的 AI 聊天機器人對人類情感影響的重要開端,有助於為 AI 平台設計更安全、更健康的交互方式提供依據。」參與該項目的 OpenAI 安全研究員 Jason Phang 評價道。

「目前我們的研究還處於初級階段,但正在嘗試與學界展開對話來討論哪些指標值得衡量,以及長期來看 AI 使用對用戶可能產生哪些影響。」他補充說。

「儘管這項研究具有積極意義,但想要精準判定人類何時在情感層面與技術進行互動仍然很睏難。」Kate Devlin 指出。在她看來,參與者可能經歷了一些未被(研究人員)記錄下來的情感波動。

「就研究團隊試圖衡量的指標而言,人們使用 ChatGPT 的方式未必總是帶有情感色彩,但人類與技術的互動本身無法剝離情感因素。」她補充道,「我們用自己設計的情感分類工具尋找特定信號,但實際上這些信號對人們的生活意味著什麼、影響是什麼,真的很難推測。」

研究人員也強調,在對聊天機器人如何影響人類有了更清晰認識的同時,仍然存在許多未知領域需要進一步探索。因此,有必要開展更多研究來弄清楚 AI 聊天機器人是否既能有效處理人類的情感問題,又不會讓人過度依賴它或取代真實社交。

參考鏈接:

1.https://www.technologyreview.com/2025/03/21/1113635/openai-has-released-its-first-research-into-how-using-chatgpt-affects-peoples-emotional-wellbeing/

2.https://www.media.mit.edu/publications/how-ai-and-human-behaviors-shape-psychosocial-effects-of-chatbot-use-a-longitudinal-controlled-study/

3.https://cdn.openai.com/papers/15987609-5f71-433c-9972-e91131f399a1/openai-affective-use-study.pdf