造機器人為何要指望手機廠商?

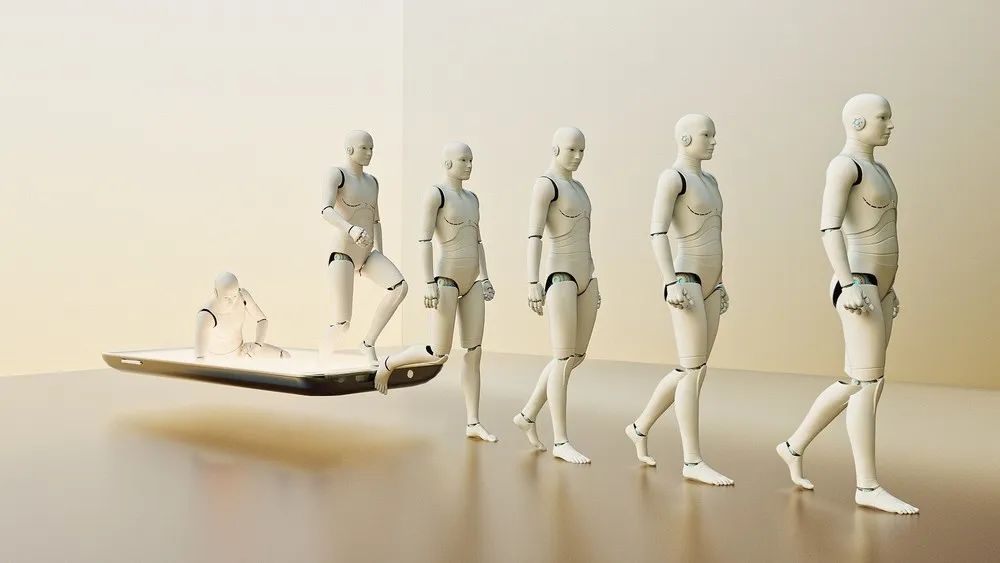

題圖|視覺中國

題圖|視覺中國這世界上已經沒有什麼是手機廠商不能幹的了。

3月25日,在今年的博鼇亞洲論壇上,vivo執行副總裁、首席運營官、中央研究院院長胡柏山宣佈vivo「成立了機器人Lab,佈局機器人賽道」。這家蟬聯四年中國市場手機份額第一的廠商,不僅要把AI代表的數字世界和機器人代表的物理世界連接起來,而且還把機器人放到了「手機的未來」這樣重要的戰略地位。

但是等一下。機器人,手機,未來?這有點兒遠了吧。

誠然,手機確實是當下最智能的生產力工具。機器人也承載了人們對於未來生產力發展的想像。不過,在造手機和造機器人之間,似乎並沒有什麼必然聯繫。

造手機的為什麼要造機器人?甚至,手機廠商能造好機器人嗎?

然而,胡柏山卻認為手機廠商在機器人領域有巨大的發揮空間。甚至,讓機器人引爆市場,成為消費級產品的關鍵就在手機廠商手中。

尷尬:紅利與瓶頸同時到來

按照胡柏山的觀點,人工智能代表數字世界,機器人代表物理世界,這兩個世界之間有巨大的鴻溝。打個比方來說,就是要把《流浪地球》里的MOSS,具象化變成《終結者》里的T800,還有很長的路要走。當然,我們就算離MOSS也還很遠。

這確實是當下機器人產業的尷尬之處。

目前的機器人,更像是一具靈活的軀體。無論是工業還是服務業,機器人產品對外部世界的感知仍然受限於特定的工作環境,需要人的頻繁調教。實際上,即便是當下炙手可熱的機器人,也僅處於小腦剛發育,大腦不成熟的階段。

一言以蔽之,現階段的機器人們,最大的問題是「不太通人性」。具體表現有二:

一是人話聽不懂,情緒價值也給不到。

比如,在商場和機場這些嘈雜環境中,服務機器人語音識別準確率會下降至75%以下,而老年用戶因口音或方言導致的識別失敗率高達40%。在新聞報導中,用戶花了重金購回機器人,卻因為口音問題無法交流的例子比比皆是。

即便過了「語言關」,無法理解「把咖啡送到三樓會議室2號桌」這樣的連續目的性句子也是家常便飯。用這樣的識別精度去辨認人類感情就更難了。比如,日本軟銀Pepper機器人雖宣稱支持情感交互,但實際的表情識別準確率僅65%。一些大學的實驗室準確度或許在80%以上,但實測成績也會打較大折扣。

二是環境複雜了會「犯迷糊」。

工業機器人領域的情況要好些。因為工業機器人的位置普遍固定,物料也是按照規範擺放。但是,如果遇到物料散亂的場景,識別準確率也會大幅下降到60%到70%。

服務機器人這邊就不容樂觀了。因為要進入的環境不可控因素太多,人流或者複雜地形(即便對人類來說並不複雜)都會頻繁導致動作規劃偏差,嘈雜的環境會降低語音識別度,遮擋或者光線變換會降低視覺識別度。拜此所賜,我們能看到大量的機器人翻車搞笑影片,這情緒價值倒是拉滿了。

所以有人說,目前的人形機器人還是「大玩具」也有一定道理。

求解:機器人究竟卡在哪兒了?

可以說,現在的機器人處於「能看」的階段,距離「能用」還有較大的距離,遑論滿足人們的期待了。

那機器人究竟卡在哪兒了?原因有很多,但最關鍵的是多模態感知技術的瓶頸。

須知,機器人與人類在感知方面幾乎是在兩個完全不同的世界。如果把看、聽、摸這些都算是「信號」的話。從單項能力來看,機器人通過傳感器能感知的比人類神經和細胞感知的要快得多,遠得多,廣得多。激光雷達能掃瞄200米遠,MEME馬克風能接收的聲波範圍是人類的5倍,電容式傳感器的微小壓力精度是人類的10倍。

同時,不幸(或許也是萬幸)的是,機器人即便能感知信號,也沒有神經網絡。因此,在整合信號形成認知,然後再根據認知做出決策方面,機器人的能力與人類大腦相去甚遠。因此,即便有的機器人已經能唱跳武打,卻仍然需要配一個人類「保姆」外加遙控器。

而把這些所有的信號整合在一起的能力,就是多模態感知能力。

因此,機器人總看起來一副憨憨的樣子。而為了能讓機器人更像人類,包括OpenAI、DeepSeek、三星、蘋果和vivo,都開始研究提升機器人的多模態感知能力。可以說,這是一道機器人產業發展的必答題。

問題是,找到題目後,人們發現也不是「干就完了」那麼簡單。因為,機器人本身是研發與製造業,現在又涉及了AI、感知技術和消費者需求洞察,不是純文也不是純理,而是一個「大綜合」。

「拔劍四顧心茫然」,能湊齊上面所有技術能力的企業,好像也只有手機廠商了。

爭位:手機廠商的優勢水到渠成

在今年的博鼇論壇上,vivo在宣佈進軍機器人行業的同時,提出了「成為橋樑」的理念。

vivo執行副總裁、首席運營官、中央研究院院長胡柏山

vivo執行副總裁、首席運營官、中央研究院院長胡柏山什麼是「成為橋樑」?事實上,vivo已經在手機領域演示過一次。作為當今智能化程度最高的生產力工具,手機本身就是數字世界和物理世界最大的橋樑。vivo是手機品牌中當之無愧的第一梯隊,連續四年蟬聯中國手機市場佔有率第一的品牌。在登頂手機市場的過程中,vivo已經形成了一套理解需求,技術突破,滿足場景的成熟方法論。

如今,在機器人領域,只需將方法論平移即可。

從技術實力上看,vivo是目前少有的精於感知技術,還有AI能力,又深耕製造業的廠商。而這些技術恰是機器人領域所需要的:

一是感知技術,也就是混合現實能力。vivo研發的vivo看見、vivo聽說等功能,已經成功讓視障和聽障患者借助手機感知到世界真實的樣子。而在vivo的武器庫中,還有更多的技術儲備。

比如VCS仿生光譜技術能夠模仿人眼的光譜響應曲線,1英吋超大底傳感器能夠實現毫米級環境建模精度。而SLAM空間計算技術則能以每秒30幀的速度,以低於2%的低誤差實時生成三維地圖。有了這些技術,機器人看世界就能儘量像人眼一樣看色彩,辨方位。

二是AI能力。vivo藍心大模型高達92%的多模態識別準確率也是機器人所需要的。更重要的是,藍心大模型的AI訓練數據直接來源於5億用戶的真實交互場景,涵蓋了方言指令、嘈雜環境下的語音樣本以及家庭場景的視覺數據。謝天謝地,用戶不需要再過「語言關」了。

不僅如此,手機廠商的AI直接嵌入手機應用的各種場景,是直接服務用戶的AI,自然也最懂消費者。這使得vivo擁有讓機器人精準執行複雜指令的能力。比如「先點杯咖啡再送到三樓」。甚至,因為擁有眾多場景,還可以預判用戶的需求,先問一句「coffee or tea?」

上面的兩大能力結合,已經基本保證vivo出手的機器人會擁有發育健全的大腦。擁有比較高的技術上限。

在此之外,手機廠的供應鏈話語權優勢不可小覷。這意味著更精密的組裝,更快速地落地,更大規模的製造。同時,vivo強調,自己要聚焦於機器人的「眼睛和大腦」,主攻消費級市場,研發個人和家庭場景的機器人產品,回歸場景,解決痛點,迭代產品,而身子、手臂則是交給合作夥伴來完成。這也體現了vivo作為產業鏈鏈主企業的格局。

而所有這一切,都推向一個結果:手機廠商是把機器人產業帶入消費級產品時代的最佳選擇。

尾聲:未來還有多遠?

或許,3~5年後,我們會看到能力完全超越現有機器人的原型機。並且,在這個過程中,應該也會不斷有新的驚喜出現。

當然,這個過程註定不會過於順利,但卻值得我們為之期待。

而我們期待的,或許是繼手機和電腦之後的終極效率機器;或許是來自矽基世界的智能夥伴;又或許只是對科學幻想的印證……只要想到前方或許又是一個人類科技史上的「iPhone」時刻,這期待本身就已足夠有趣。

特別策劃