史丹福2025 AI Index報告來了:DeepSeek在全文中被提到45次

機器之心報導

編輯:蛋醬、+0

剛剛,史丹福大學正式發佈了《2025 AI Index》報告。

在過去的一段時間里,人工智能領域經歷了一場蓬勃的發展,但與此同時,也有人說「人工智能是一個泡沫」。其他的討論話題包括但不限於:人工智能的現有技術和架構將不斷取得突破;人工智能走在一條不可持續的道路上;人工智能將取代你的工作;人工智能最擅長的就是把你的家庭照片變成吉卜力工作室風格的動畫圖像……

每一年的史丹福 AI Index 報告都會對領域的發展進行系統的梳理,今年也是如此。《2025 AI Index》報告總共 400 多頁,涵蓋了研發、技術性能、負責任的人工智能、經濟影響、科學和醫學、政策、教育和公眾輿論等主題的圖表和數據。

報告地址:https://hai.stanford.edu/ai-index/2025-ai-index-report

目錄如下:

除了Google、OpenAI 之外,中國公司 DeepSeek 也成為報告關注的焦點,在 PDF 全文中被提到了 45 次。

關於今年 AI Index 報告的核心內容,我們通過 12 張圖片來瞭解:

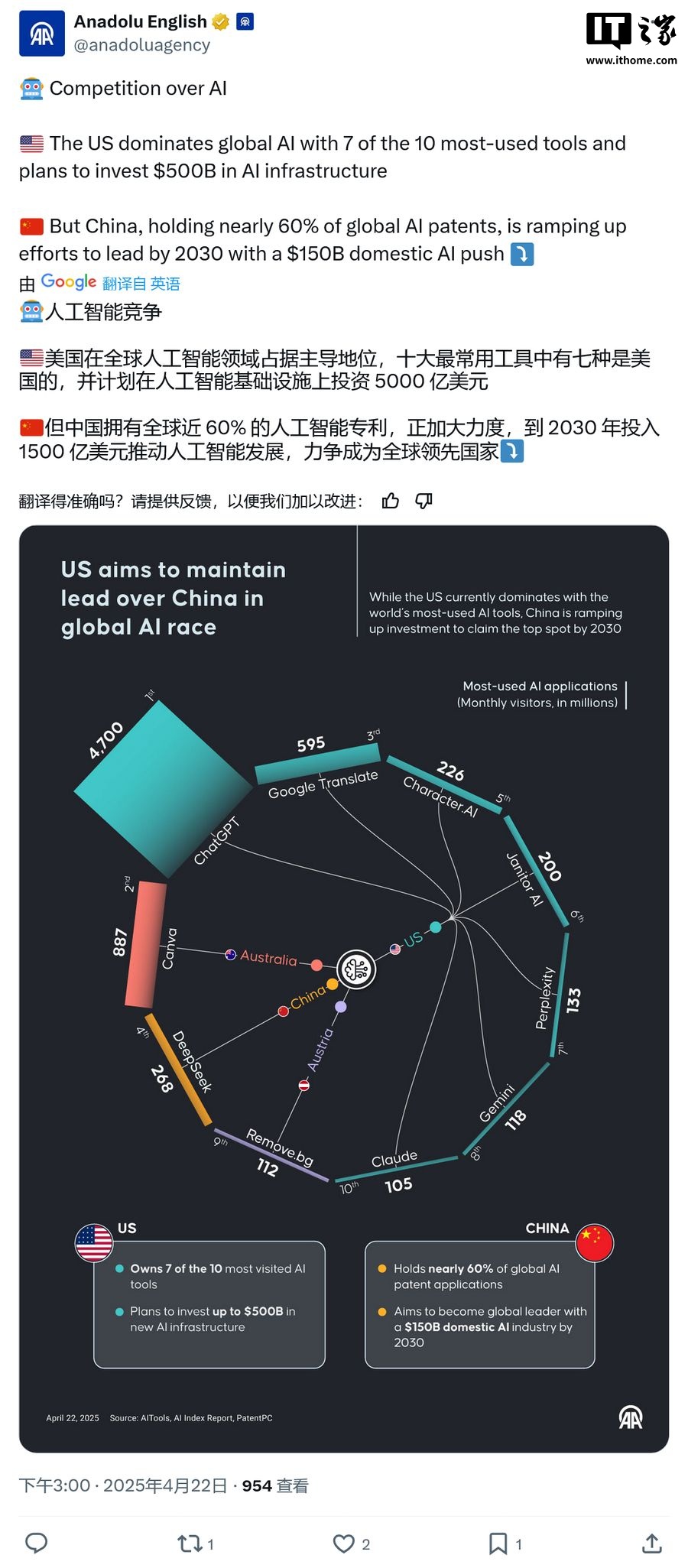

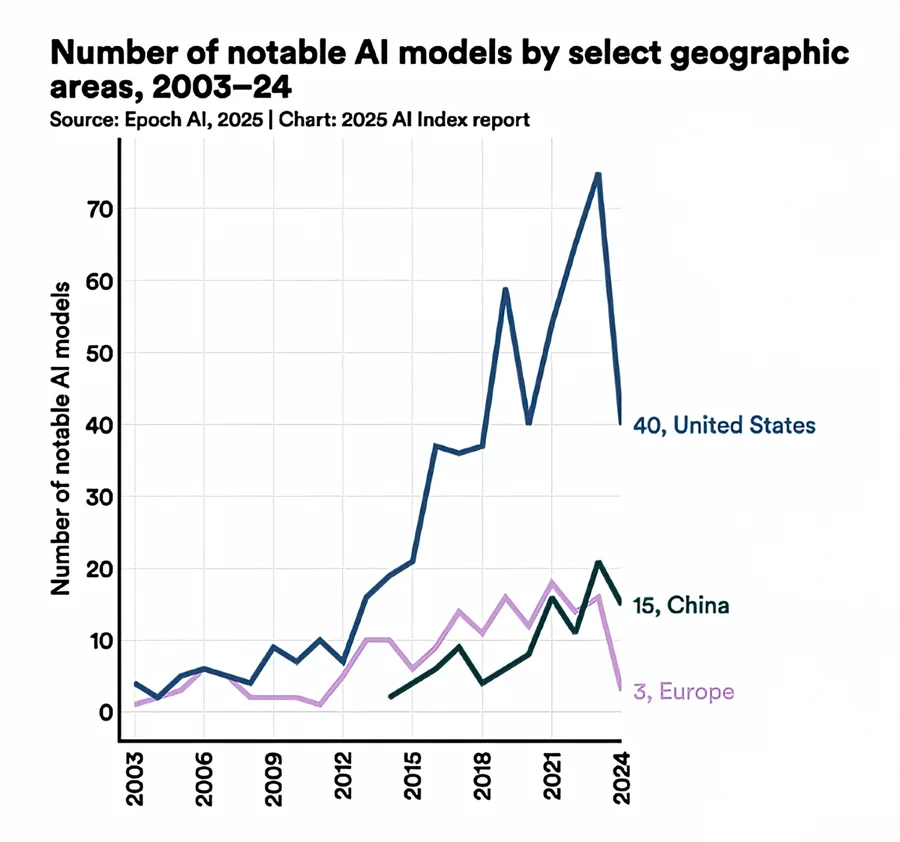

美國公司的遙遙領先

雖然衡量國家在人工智能競賽中「領先」的方式多種多樣(如期刊文章發表或引用數量、專利授權等),但一個直觀的評估指標是觀察哪些國家發佈了具有影響力的模型。研究機構 Epoch AI 擁有一個從 1950 年至今的重要人工智能模型數據庫,AI Index 從中提取了相關數據進行分析。

數據顯示,去年美國發佈了 40 個知名模型,中國發佈了 15 個,歐洲僅有 3 個(均來自法國)。另有數據表明,2024 年發佈的這些模型幾乎全部來自產業界,而非學術界或政府部門。關於 2023 年至 2024 年知名模型發佈數量減少的現象,AI Index 認為可能是由於技術複雜度提高和訓練成本持續攀升所致。

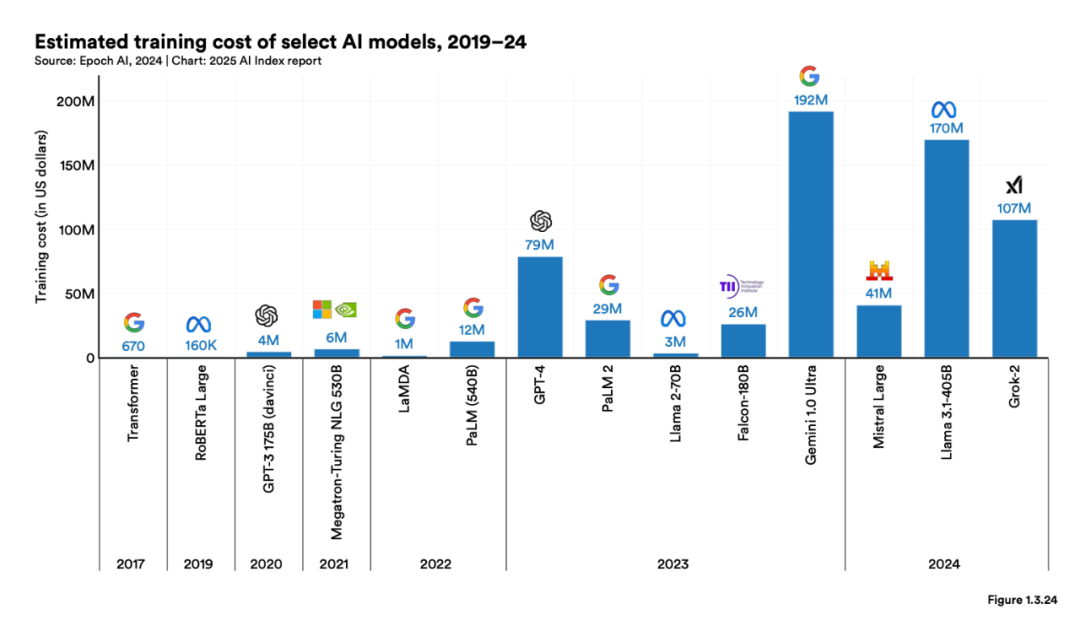

說到訓練成本……

在這方面,AI Index 缺乏精確數據,因為許多領先的人工智能公司已停止公開其訓練過程信息。史丹福研究人員與 Epoch AI 合作,基於訓練時長、硬件類型和數量等詳細信息,估算了部分模型的成本。在可評估的模型中,最昂貴的是Google的 Gemini 1.0 Ultra,訓練成本約達 1.92 億美元。訓練成本的全面上漲與報告中的其他發現相符:模型在參數數量、訓練時間和訓練數據量等方面持續規模化擴張。

值得注意的是,DeepSeek 並未包含在這一分析中。這家公司在 2025 年 1 月聲稱僅用 600 萬美元訓練出了 DeepSeek-R1,引發金融市場震動,雖然部分行業專家對此說法持懷疑態度。

AI Index 指導委員會聯合主任 Yolanda Gil 在接受 IEEE Spectrum 採訪時表示,她認為 DeepSeek「非常令人印象深刻」,並指出計算機科學歷史上充滿了早期低效技術被更優雅解決方案取代的案例。她補充道:「我不是唯一一個相信某個時點會出現更高效版本大語言模型的人。我們只是不知道誰會構建它以及如何構建。」

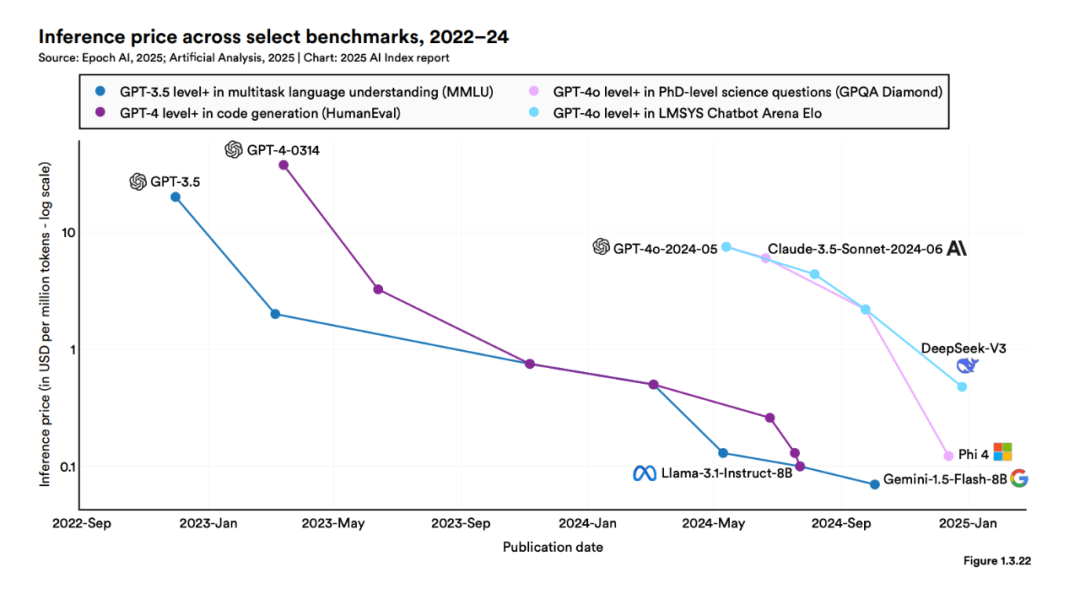

使用人工智能的成本正在下降

儘管大多數 AI 模型的訓練成本持續攀升,但報告中強調了幾個積極趨勢:硬件成本降低、硬件性能提升及能源效率提高。

這使得推理成本(即查詢已訓練模型的費用)正在急劇下降。這張使用對數比例的圖表展示了 AI 性能每美元的發展趨勢。報告指出,藍線表明每百萬 tokens 的成本從 20 美元降至 0.07 美元;粉線則顯示在不到一年時間內,成本從 15 美元降至 0.12 美元。

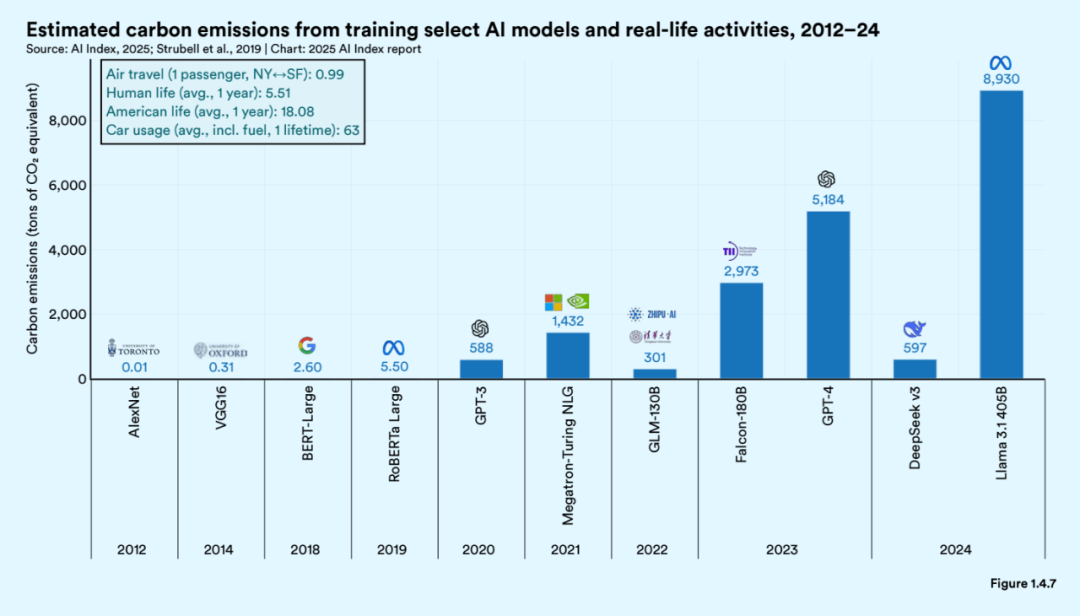

人工智能的顯著碳足跡

雖然能源效率提高是一個積極的趨勢,但存在一個不容忽視的問題:儘管效率有所提升,整體能耗仍在增長,這意味著處於人工智能熱潮中心的數據中心留下了巨大的碳足跡。AI Index 基於訓練硬件、雲服務提供商和地理位置等因素,估算了特定 AI 模型的碳排放,發現前沿人工智能模型的訓練碳排放量呈穩步增長趨勢 —— 其中 DeepSeek 模型是個例外。

數據顯示,最大的排放源是 Meta 的 Llama 3.1 模型,估計產生了 8930 噸二氧化碳排放,相當於約 496 個美國人一年的生活碳排放量。這一顯著的環境影響解釋了為何人工智能公司正積極採用核能作為可靠的零碳能源來源。

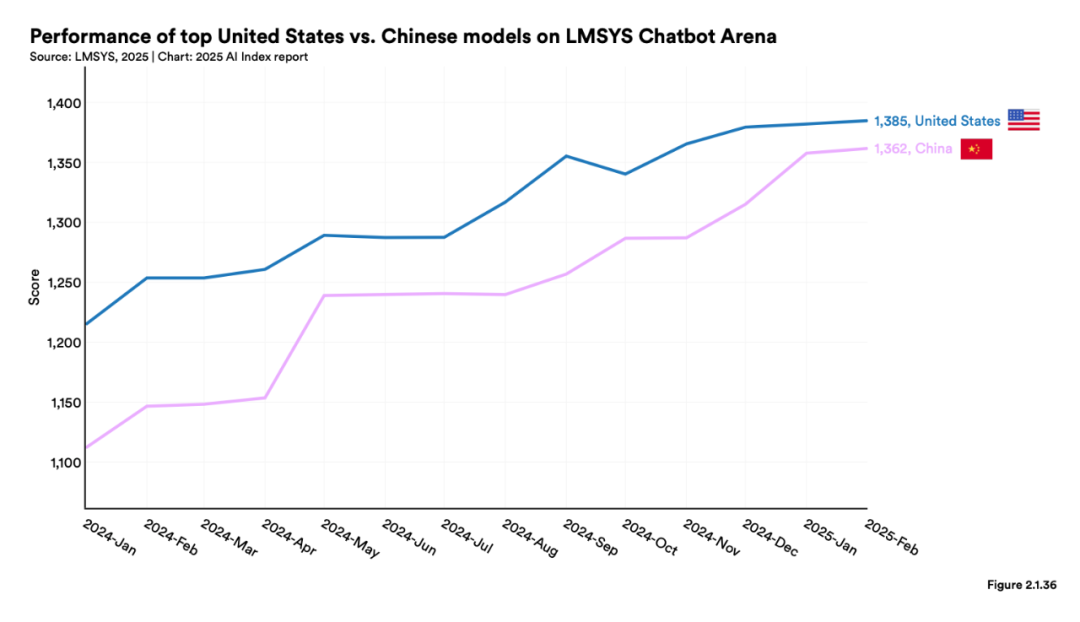

人工智能模型性能差距持續縮小

美國在已發佈的知名模型數量上仍然保持領先地位,但中國模型在質量方面正在迅速趕上。數據顯示,在聊天機器人基準測試上的性能差距正在不斷縮小。2024 年 1 月,頂尖美國模型的表現比最優中國模型高出 9.26%;到 2025 年 2 月,這一差距已縮小至僅 1.70%。報告在推理、數學和編程等其他基準測試中也發現了類似趨勢。

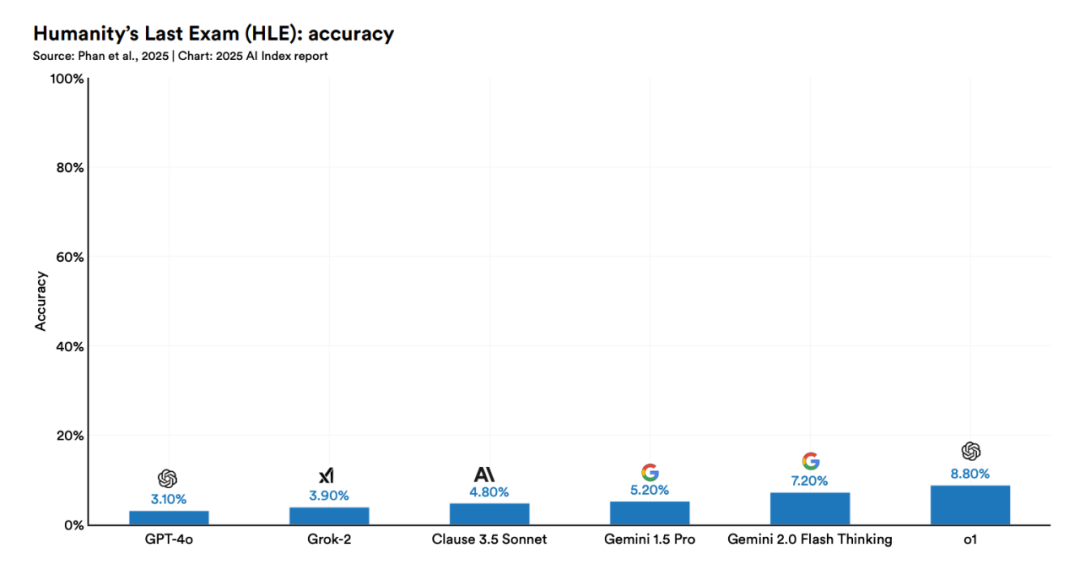

人類最後的考試

今年的報告指出了一個不可忽視的事實:用於評估人工智能系統能力的眾多基準測試已經「飽和」—— 人工智能系統在這些測試上獲得的分數如此之高,以至於它們不再具有區分價值。這種現像已在多個領域出現:通用知識、圖像推理、數學、編程等。

Gil 表示,她驚訝地目睹一個又一個基準測試逐漸失去參考意義。她指出:「我一直認為性能會趨於平穩,會達到一個需要新技術或根本不同架構才能繼續取得進展的臨界點。但事實並非如此。」

面對這種局面,執著的研究人員不斷設計新的基準測試,以期挑戰人工智能系統。其中一項是「人類的最後考試」,它由來自全球 500 個機構的專業領域專家貢獻的極具挑戰性問題組成。到目前為止,即使對最頂尖的人工智能系統而言,這項測試仍然難以攻克:OpenAI 的推理模型 o1 目前以 8.8% 的正確答案率位居榜首。業界正密切關注這種局面能持續多久。

公共數據面臨的威脅

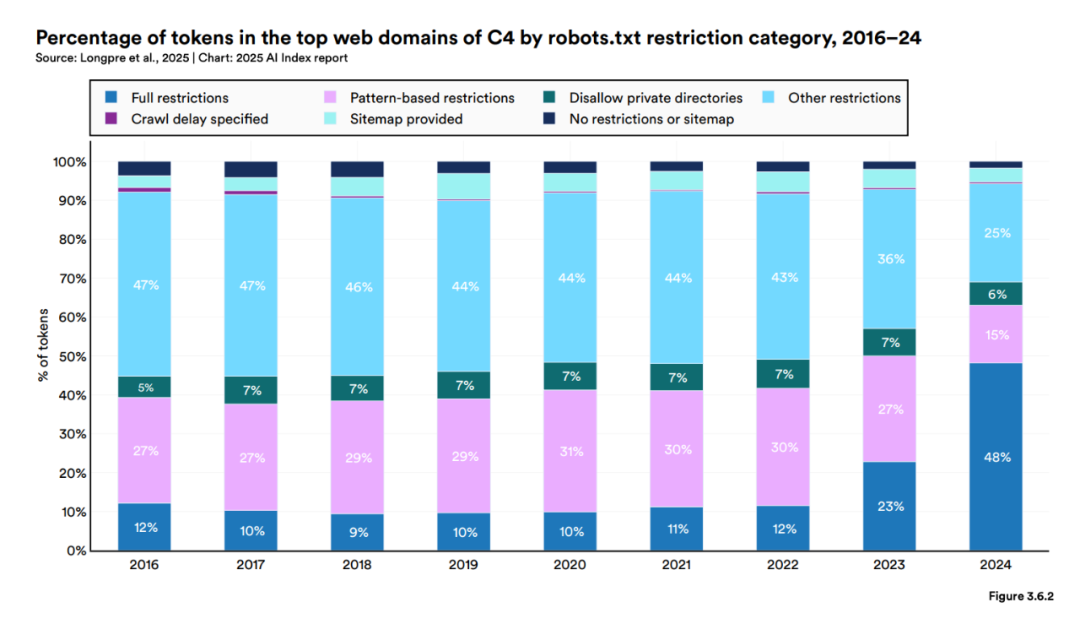

當今生成式 AI 系統通過訓練海量從互聯網抓取的數據獲得智能,這導致了一個經常被提及的觀點:「數據是 AI 經濟的新石油」。隨著人工智能公司不斷挑戰可輸入模型的數據量極限,業界開始擔憂「數據峰值」問題,以及何時會耗盡這種關鍵資源。一個問題是,越來越多的網站正在限制機器人爬取並抓取其數據(可能是因為擔憂人工智能公司從其數據中獲利,同時破壞其商業模式)。網站通過機器可讀的 robots.txt 文件聲明這些限制。

數據顯示,頂級網絡域名中 48% 的數據現已被完全限制訪問。然而,Gil 指出,人工智能領域可能會出現新方法,終結對龐大數據集的依賴。她認為:「預計在某些時候,數據量將不再如此關鍵。」

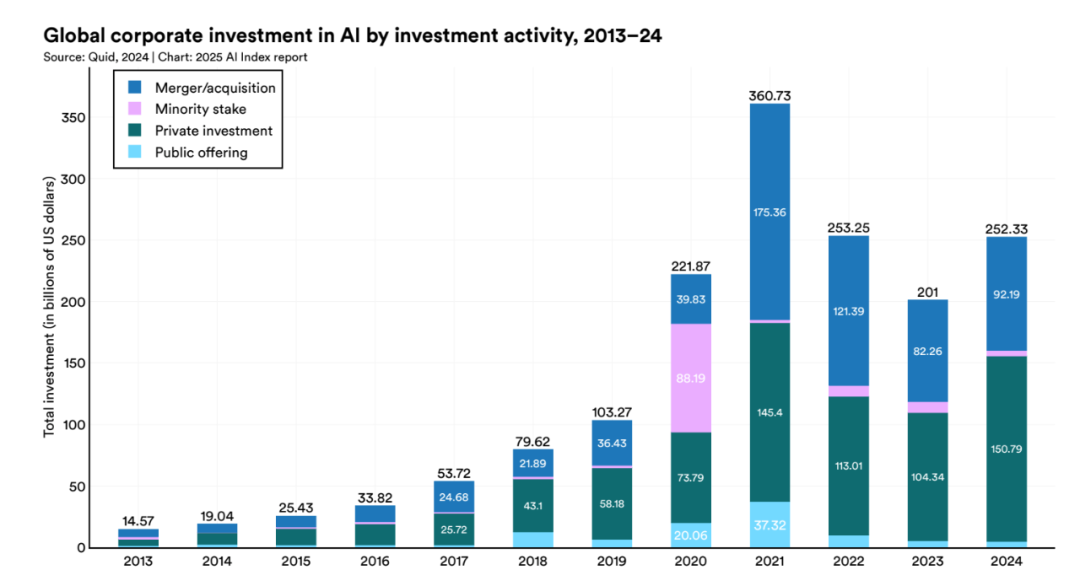

企業資金持續湧入人工智能領域

過去五年,企業界已為人工智能投資敞開了資金閘門。雖然 2024 年的全球總體投資未能達到 2021 年的瘋狂高峰,但值得注意的是,私人投資規模達到了前所未有的水平。在 2024 年 1500 億美元的私人投資中,相關指數的另一項數據表明,約 330 億美元流向了生成式 AI 領域。

企業等待人工智能投資的巨大回報

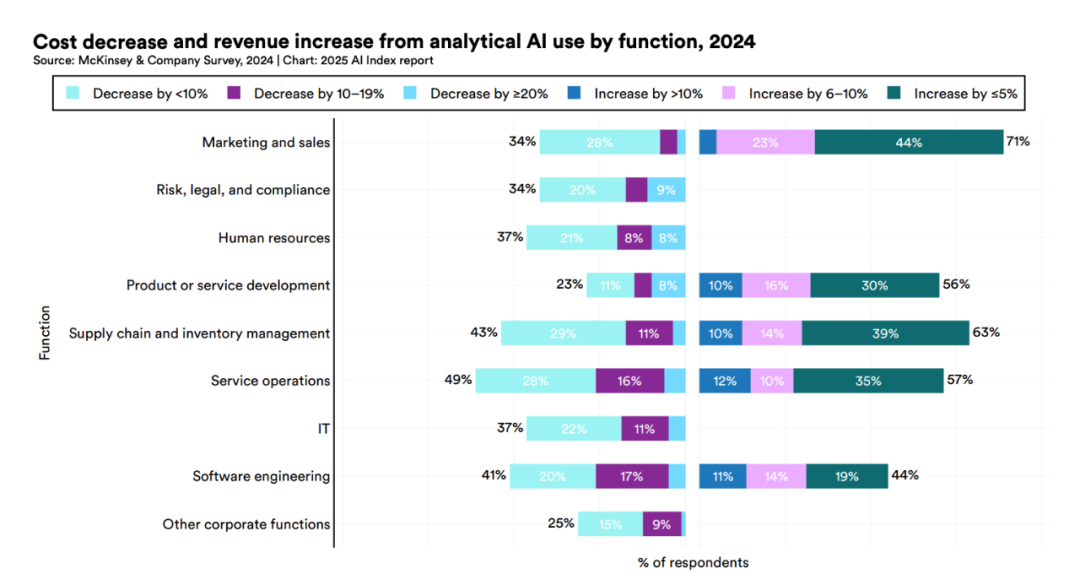

理論上,企業投資人工智能是因為期望獲得可觀的投資回報。在這個話題上,人們常以激昂語氣討論人工智能的變革性本質和前所未有的生產力提升。然而,企業尚未見到能帶來顯著成本節省或實質性新收益的轉變。

麥肯錫調查數據顯示,在報告成本降低的企業中,大多數節省幅度不足 10%;在因人工智能獲得收入增長的企業中,大多數報告的增長幅度不到 5%。巨大的回報可能仍在路上,從投資數據來看,眾多企業正在押注於此,但目前尚未實現。

AI 醫生或將很快接診

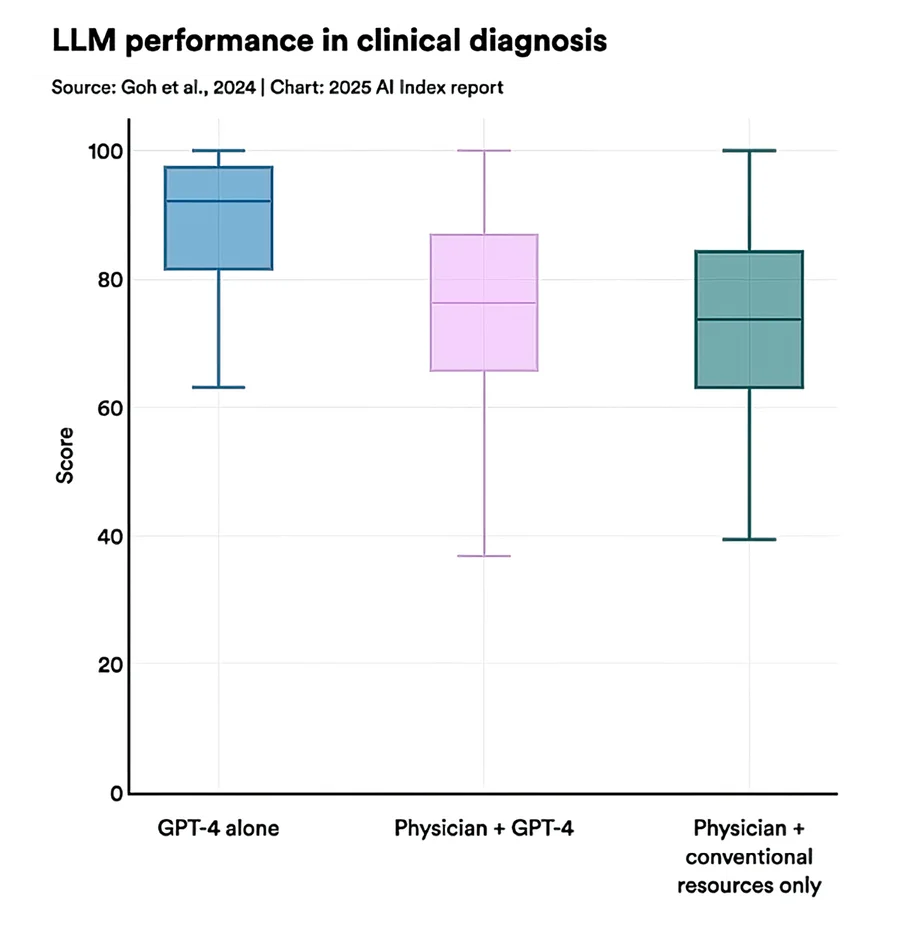

科學與醫療領域的人工智能應用是人工智能浪潮中的一個重要分支。報告列舉了多個新發佈的基礎模型,這些模型旨在協助材料科學、天氣預報和量子計算等領域的研究人員。眾多公司正嘗試將人工智能的預測和生成能力轉化為盈利性藥物研發。OpenAI 的 o1 推理模型最近在醫學執照考試問題集 MedQA 的基準測試中取得了 96% 的得分。

然而,這似乎仍是一個潛力巨大但尚未轉化為顯著實際影響的領域 —— 部分原因可能是人類尚未完全掌握如何有效使用這項技術。2024 年的一項研究測試了醫生在使用 GPT-4 作為常規資源補充時是否能做出更準確的診斷。結果表明,這既未提高診斷準確性,也未加快診斷速度。值得注意的是,單獨使用的 GPT-4 表現卻優於人機團隊和單獨的人類醫生。

美國的人工智能政策行動轉向州級層面

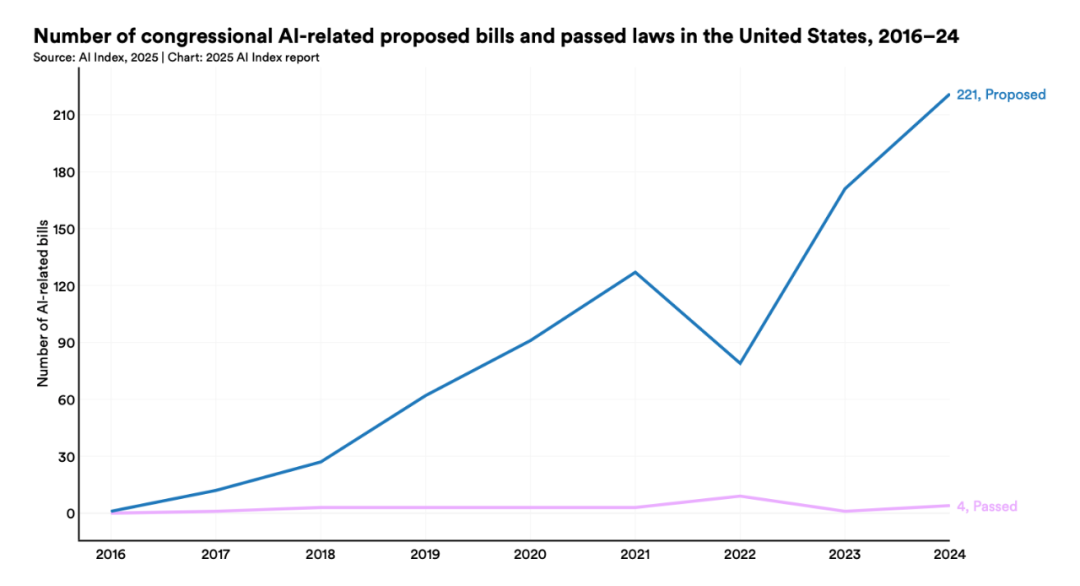

這張圖表顯示,美國國會雖有大量關於人工智能的討論,但實際行動寥寥無幾。報告指出,美國的政策製定已轉移至州級層面,2024 年共有 131 項法案在各州獲得通過。其中 56 項與深度偽造(deepfake)相關,禁止在選舉中使用深度偽造技術或借此傳播未經同意的私密圖像。

美國之外,歐洲已通過《人工智能法案》(AI Act),該法案要求開發被認定為高風險的人工智能系統的公司承擔新的責任義務。然而,全球主要趨勢是各國聯合發表關於人工智能應在世界上扮演何種角色的全面但無約束力的聲明。因此,實質性監管行動相對有限,而討論卻十分廣泛。

人類是樂觀主義者

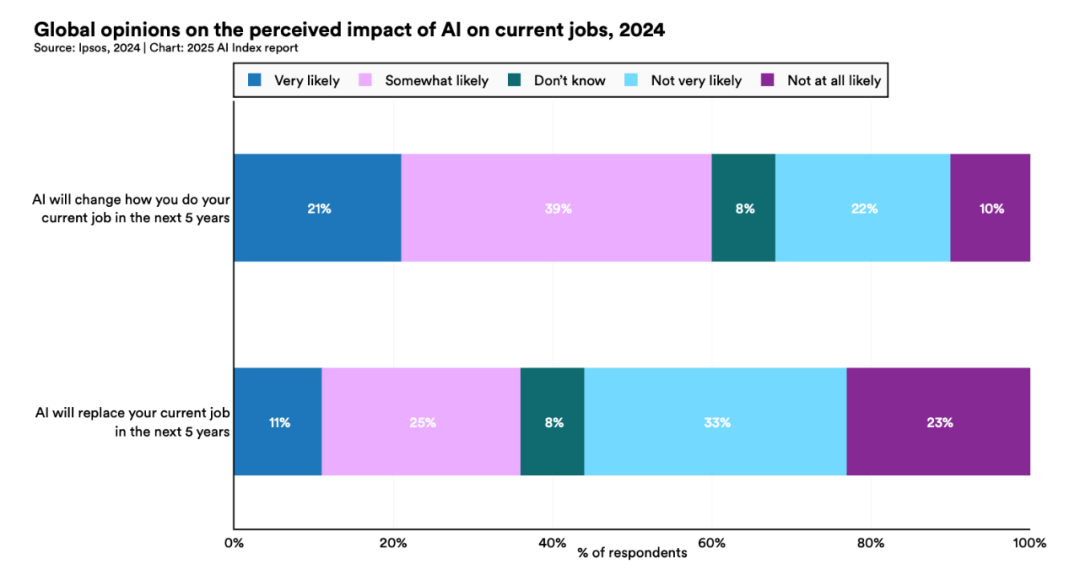

無論你是股票攝影師、營銷經理還是卡車司機,關於人工智能是否以及何時會取代你的工作,社會上已有廣泛討論。然而,最近一項關於人工智能態度的全球調查顯示,大多數人並不感到受到人工智能的威脅。

來自 32 個國家的 60% 受訪者認為人工智能將改變他們的工作方式,但僅有 36% 的人預期會被替代。「這些調查結果確實讓我感到驚訝,」Gil 表示,「人們認為『人工智能將改變我的工作,但我仍將創造價值』,這種觀點非常令人鼓舞。」讓我們拭目以待,看看我們能否都通過管理人工智能團隊來持續創造價值。

更多細節,可參考報告原文。