初創公司用AI實時檢測Deepfake,能甄別影片通話中的換臉騙子

在 AI 技術快速發展的今天,實時影片深度偽造(deepfake)技術正成為一個日益嚴峻的全球性問題,給個人、企業和政府帶來前所未有的安全威脅。

前不久,香港警方破獲了一起利用 AI 技術的大規模詐騙案,犯罪分子利用 AI 換臉技術在網上交友平台上偽裝成女性,詐騙受害者總計 4600 萬美元。

這個案例凸顯了 deepfake 技術在犯罪領域的濫用。詐騙團夥不僅使用 AI 生成的照片,還在影片通話中使用 deepfake 技術,將詐騙者變成迷人的女性,以贏得受害者的信任。

隨著使用 deepfake 技術的門檻越來越低,人們迫切需要一種有效的檢測手段。

為了應對這個問題,一家名為 Reality Defender 的美國初創公司推出了一種 AI 檢測工具,可以實時檢測影片通話中的其他人有沒有使用 deepfake。

該公司的產品經理祖斯迪斯·任(Christopher Ren)為媒體展示了其 AI 檢測工具的潛力。

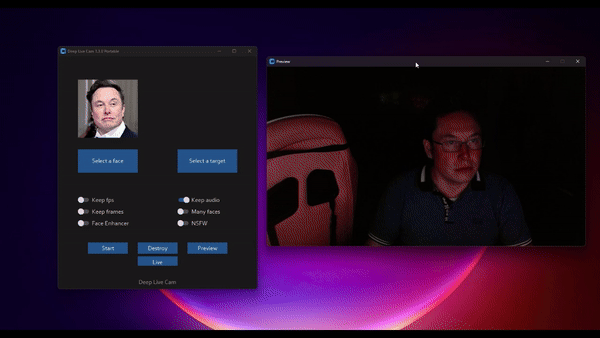

他利用 GitHub 上的一些代碼和一張照片,生成特斯拉和 SpaceX 的創始人埃隆·馬斯克(Elon Musk)deepfake 影片,並將其映射到自己的臉上。

圖 | 今年 8 月,Deep-Live-Cam 開發人員製作了一段演示影片,展示了自己與馬斯克換臉(來源:Deep-Live-Cam)

在影片通話過程中,Reality Defender 的定製模型會通過接收靜態幀的方式實時分析影片通話畫面。

並且,通過屏幕上的小工具提醒用戶,他們面對的可能是 AI 生成的 deepfake 影片,而不是真實的馬斯克。

Reality Defender 的 CEO 兼聯合創始人本·高文(Ben Colman)對媒體表示:「可能只需要幾個月的時間,我們就會看到 deepfake 影片和‘影片通話’欺詐的爆炸性增長。」他強調,在高風險情況下的影片通話中,眼見不一定為實。

在現實應用場景中,Reality Defender 選擇將檢測工具打包成一個 Zoom 插件,可以實時預測影片通話中的其他參與者是否是真人或 AI 扮演的冒牌貨。

目前,該公司正在對這一工具進行基準測試,以確定其最終的準確性。

高文強調,儘管其專注於與商業和政府客戶合作以打擊 AI 驅動的 deepfake,但他們並不反對 AI 技術的廣泛發展。

他說:「我們非常支持 AI。我們認為 99.999% 的 AI 用例對醫學、生產力和創造力而言都是變革性的,但在這些非常不起眼的用例中,風險卻不成比例地高。」

除了 Reality Defender,其他科技公司和研究人員也在探索不同的方法,來應對這種特殊的威脅。

2022 年,英特爾推出了深度偽造檢測工具 FakeCatcher,該工具通過分析面部血流的變化來判斷影片參與者是否真實。

美國紐約大學計算機科學博士生戈文德·米塔爾(Govind Mittal)及其所在團隊則提出了一種基於測試的方法,要求參與者在加入影片通話前通過一種影片驗證碼測試。

米塔爾指出:「現在創建 deepfake 變得如此簡單,我們需要的數據越來越少。如果我在 Instagram 上傳了 10 張照片,有人拿著社交媒體的照片就可以假冒我。」

最近,聯合國毒品和犯罪問題辦公室發佈的一份報告也強調,有些組織犯罪集團在技術方面具有進步,其特別提到了 deepfake 技術在欺詐中的日益普遍使用。

日漸增多的 deepfake 詐騙案件提醒我們,實時的 deepfake 目標不再僅限於億萬富翁和公眾人物。

該機構在東南亞地區的某社交平台上,發現了超過 10 家向犯罪集團出售 deepfake 軟件服務的帳號,顯示出這項技術正在被犯罪分子廣泛使用。

然而,開發有效的檢測工具面臨著重大挑戰。高文對媒體表示,獲取更多數據是一個大難題,這也是當前 AI 創業公司普遍面臨的問題。

他希望通過更多的合作夥伴關係來填補這些空白,並暗示 2025 年可能會有多項新的合作協議。

例如,在 ElevenLabs 被曝與美國總統拜登的 deepfake 語音通話有關後,這家 AI 音頻初創公司就與 Reality Defender 達成了合作意向,以減少潛在的濫用。

儘管這些技術解決方案正在不斷髮展,但專家們警告說,人們不應過分自信地認為自己能夠識別影片深度偽造。

高文指出:「我不會要求我 80 歲的母親學習如何識別釣魚郵件,因為她年紀太大了,而且也不是計算機專家。」

他認為,未來如果 AI 檢測技術繼續改進並被證明是可靠的,實時影片檢測可能會像電子郵件收件箱中默默運行的惡意軟件掃瞄器一樣普遍。

不過,在這些技術並不完善且沒有普及的今天,為了保護自己和家人免受影片通話詐騙的侵害,我們不得不提高警惕,不要輕易相信影片通話中看到的內容,並始終提醒自己:眼見不一定為實。

參考資料:

https://arstechnica.com/security/2024/10/startup-can-catch-identify-deepfake-video-in-realtime/

https://www.realitydefender.com/blog/real-time-video-deepfake-detection-now-on-reality-defender

https://arstechnica.com/ai/2024/10/deepfake-lovers-swindle-victims-out-of-46m-in-hong-kong-ai-scam/

運營/排版:何晨龍