中關村聲音|對標Sora 首個國產自研影片大模型Vidu發佈

新京報貝殼財經訊(記者羅亦丹)4月27日,在中關村論壇未來人工智能先鋒論壇上,清華大學教授、生數科技首席科學家朱軍發佈了中國首個長時長、高一致性、高動態性影片大模型——Vidu。

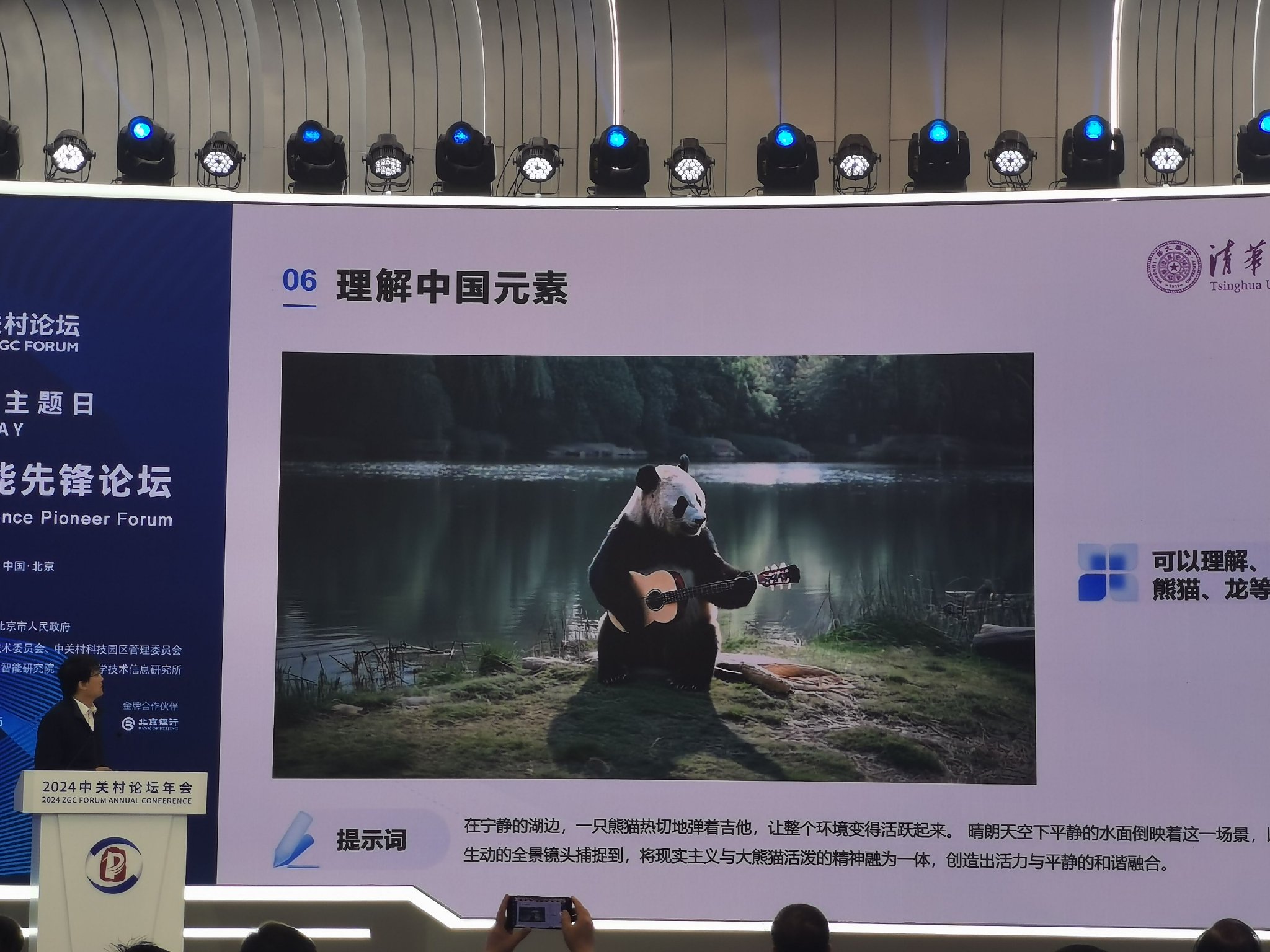

在論壇現場,朱軍向觀眾展示了Vidu生成的影片,包括戴珍珠耳環的貓、彈吉他的熊貓以及摩登女郎等。與此前震撼業界的Sora一致,Vidu能夠根據提供的文本描述直接生成高質量影片。

朱軍在中關村論壇現場作報告。 新京報貝殼財經記者羅亦丹/攝

朱軍在中關村論壇現場作報告。 新京報貝殼財經記者羅亦丹/攝朱軍表示,除了在時長方面的突破外,Vidu在影片效果方面實現顯著提升,主要體現在幾個方面,包括能夠生成細節複雜的場景,且符合真實的物理規律;能夠生成真實世界不存在的虛構畫面,創造出具有深度和複雜性的超現實主義內容;能夠生成複雜的動態鏡頭,不再局限於簡單的推、拉、移等固定鏡頭,而是能夠圍繞統一主體在一段畫面里就實現遠景、近景、中景、特寫等不同鏡頭的切換;在16秒的時長上保持連貫流暢,隨著鏡頭的移動,人物和場景在時間、空間中能夠保持一致;能夠生成特有的中國元素,例如熊貓、龍等。

朱軍表示,之所以Vidu能夠達到這樣的效果,是因為其團隊的技術路線正好與Sora高度一致。

Vidu由生數科技與清華大學聯合推出。朱軍稱,Vidu的快速突破源於團隊在貝葉斯機器學習和多模態大模型的長期積累和多項原創性成果。其核心技術U-ViT架構由團隊於2022年9月提出,早於Sora採用的DiT架構,是全球首個Diffusion與Transformer(均為模型名稱)融合的架構,完全由團隊自主研發。

朱軍表示,自今年2月Sora發佈推出後,團隊基於對U-ViT架構的深入理解以及長期積累的工程與數據經驗,在短短兩個月進一步突破長影片表示與處理關鍵技術,研發推出Vidu影片大模型,顯著提升影片的連貫性與動態性。從圖文任務的統一到融合影片能力,作為通用視覺模型,Vidu能夠支持生成更加多樣化、更長時長的影片內容,同時面向未來,靈活架構也將能夠兼容更廣泛的模態,進一步拓展多模態通用能力的邊界。

「我們也希望和在座各位以及國內優質單位一起合作,共同推進技術進步,誠邀產業鏈上下遊企業、研究機構加入,共同構建合作生態。」朱軍說。

編輯 陶野

校對 趙琳